应用回归分析整理课后习题参考答案概要.docx

《应用回归分析整理课后习题参考答案概要.docx》由会员分享,可在线阅读,更多相关《应用回归分析整理课后习题参考答案概要.docx(16页珍藏版)》请在冰豆网上搜索。

应用回归分析整理课后习题参考答案概要

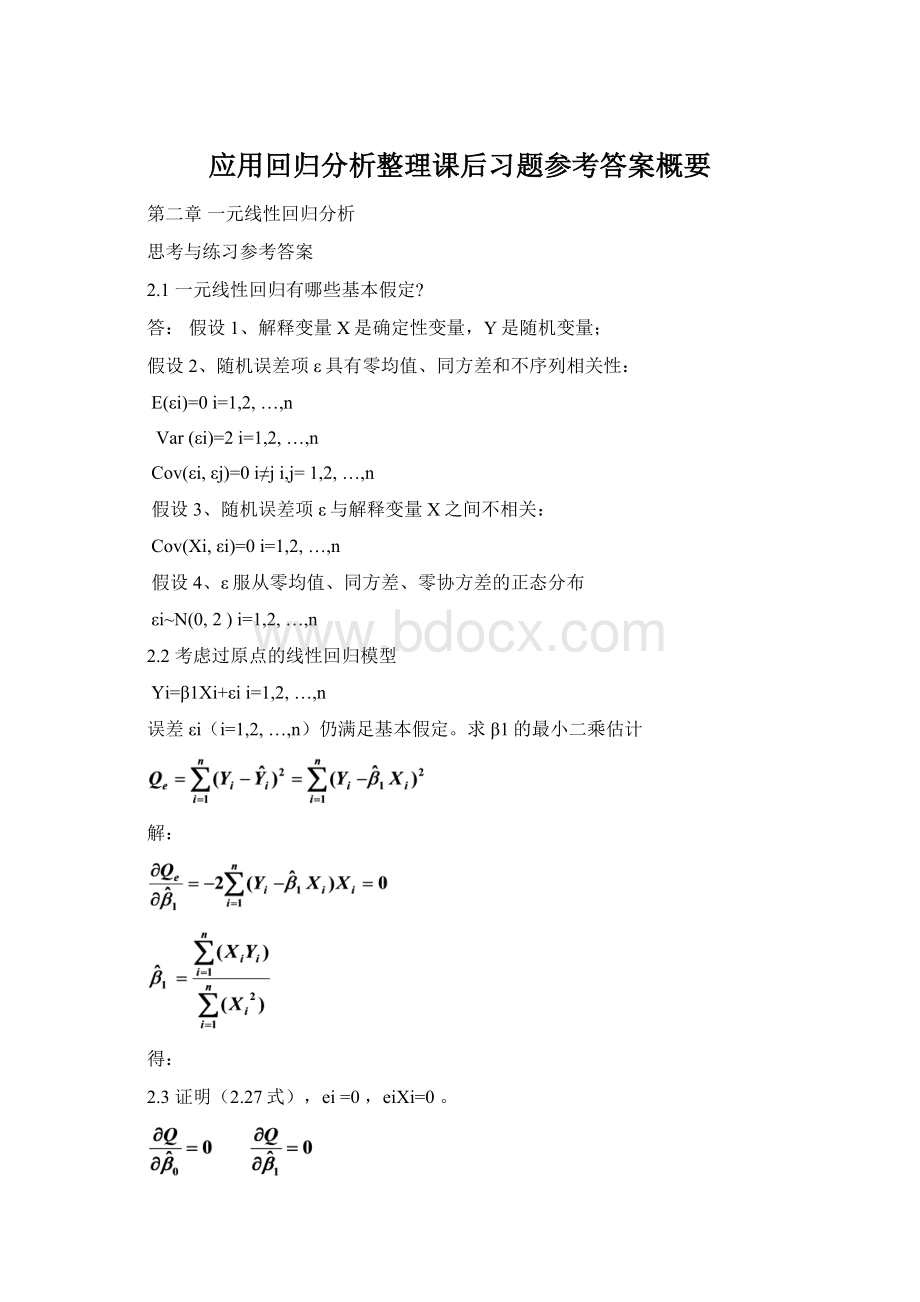

第二章一元线性回归分析

思考与练习参考答案

2.1一元线性回归有哪些基本假定?

答:

假设1、解释变量X是确定性变量,Y是随机变量;

假设2、随机误差项ε具有零均值、同方差和不序列相关性:

E(εi)=0i=1,2,…,n

Var(εi)=2i=1,2,…,n

Cov(εi,εj)=0i≠ji,j=1,2,…,n

假设3、随机误差项ε与解释变量X之间不相关:

Cov(Xi,εi)=0i=1,2,…,n

假设4、ε服从零均值、同方差、零协方差的正态分布

εi~N(0,2)i=1,2,…,n

2.2考虑过原点的线性回归模型

Yi=β1Xi+εii=1,2,…,n

误差εi(i=1,2,…,n)仍满足基本假定。

求β1的最小二乘估计

解:

得:

2.3证明(2.27式),ei=0,eiXi=0。

证明:

其中:

即:

ei=0,eiXi=0

2.4回归方程E(Y)=β0+β1X的参数β0,β1的最小二乘估计与最大似然估计在什么条件下等价?

给出证明。

答:

由于εi~N(0,2)i=1,2,…,n

所以Yi=β0+β1Xi+εi~N(β0+β1Xi,2)

最大似然函数:

使得Ln(L)最大的

,

就是β0,β1的最大似然估计值。

同时发现使得Ln(L)最大就是使得下式最小,

上式恰好就是最小二乘估计的目标函数相同。

值得注意的是:

最大似然估计是在εi~N(0,2)的假设下求得,最小二乘估计则不要求分布假设。

所以在εi~N(0,2)的条件下,参数β0,β1的最小二乘估计与最大似然估计等价。

2.5证明

是β0的无偏估计。

证明:

2.6证明

证明:

2.7证明平方和分解公式:

SST=SSE+SSR

证明:

2.8验证三种检验的关系,即验证:

(1)

;

(2)

证明:

(1)

(2)

2.9验证(2.63)式:

证明:

其中:

2.10用第9题证明

是2的无偏估计量

证明:

2.14为了调查某广告对销售收入的影响,某商店记录了5个月的销售收入y(万元)和广告费用x(万元),数据见表2.6,要求用手工计算:

表2.6

月份

1

2

3

4

5

X

1

2

3

4

5

Y

10

10

20

20

40

(1)画散点图(略)

(2)X与Y是否大致呈线性关系?

答:

从散点图看,X与Y大致呈线性关系。

(3)用最小二乘法估计求出回归方程。

计算表

X

Y

1

10

4

100

20

6

(-14)2

(-4)2

2

10

1

100

10

13

(-7)2

(3)2

3

20

0

0

0

20

0

0

4

20

1

0

0

27

72

72

5

40

4

400

40

34

142

(-6)2

和15

100

和Lxx=10

Lyy=600

和Lxy=70

和100

SSR=490

SSE=110

均3

均20

均20

回归方程为:

(4)求回归标准误差

先求SSR(Qe)见计算表。

所以

第三章

3.3证明随机误差项ε的方差2的无偏估计。

证明:

3.4一个回归方程的复相关系数R=0.99,样本决定系数R2=0.9801,我们能判断这个回归方程就很理想吗?

答:

不能断定这个回归方程理想。

因为:

1.在样本容量较少,变量个数较大时,决定系数的值容易接近1,而此时可能F检验或者关于回归系数的t检验,所建立的回归方程都没能通过。

2.样本决定系数和复相关系数接近于1只能说明Y与自变量X1,X2,…,Xp整体上的线性关系成立,而不能判断回归方程和每个自变量是显著的,还需进行F检验和t检验。

3.

在应用过程中发现,在样本容量一定的情况下,如果在模型中增加解释变量必定使得自由度减少,使得R2往往增大,因此增加解释变量(尤其是不显著的解释变量)个数引起的R2的增大与拟合好坏无关。

3.7验证

证明:

多元线性回归方程模型的一般形式为:

其经验回归方程式为

,

又

,

故

,

中心化后,则有

,

左右同时除以

,

令

,

样本数据标准化的公式为

,

则上式可以记为

则有

3.11研究货运总量y(万吨)与工业总产值x1(亿元)、农业总产值x2(亿元)、居民非商品支出x3(亿元)的关系。

数据见表3.9(略)。

(1)计算出y,x1,x2,x3的相关系数矩阵。

SPSS输出如下:

则相关系数矩阵为:

(2)求出y与x1,x2,x3的三元回归方程。

对数据利用SPSS做线性回归,得到回归方程为

(3)对所求的方程作拟合优度检验。

由上表可知,调整后的决定系数为0.708,说明回归方程对样本观测值的拟合程度较好。

(4)对回归方程作显著性检验;

原假设:

F统计量服从自由度为(3,6)的F分布,给定显著性水平

=0.05,查表得

由方查分析表得,F值=8.283>4.76,p值=0.015,拒绝原假设

,由方差分析表可以得到

,说明在置信水平为95%下,回归方程显著。

(5)对每一个回归系数作显著性检验;

做t检验:

设原假设为

,

统计量服从自由度为n-p-1=6的t分布,给定显著性水平0.05,查得单侧检验临界值为1.943,X1的t值=1.942<1.943,处在否定域边缘。

X2的t值=2.465>1.943。

拒绝原假设。

由上表可得,在显著性水平

时,只有

的P值<0.05,通过检验,即只有

的回归系数较为显著;其余自变量的P值均大于0.05,即x1,x2的系数均不显著。

第四章

4.3简述用加权最小二乘法消除一元线性回归中异方差性的思想与方法。

答:

普通最小二乘估计就是寻找参数的估计值使离差平方和达极小。

其中每个平方项的权数相同,是普通最小二乘回归参数估计方法。

在误差项等方差不相关的条件下,普通最小二乘估计是回归参数的最小方差线性无偏估计。

然而在异方差的条件下,平方和中的每一项的地位是不相同的,误差项的方差大的项,在残差平方和中的取值就偏大,作用就大,因而普通最小二乘估计的回归线就被拉向方差大的项,方差大的项的拟合程度就好,而方差小的项的拟合程度就差。

由OLS求出的仍然是的无偏估计,但不再是最小方差线性无偏估计。

所以就是:

对较大的残差平方赋予较小的权数,对较小的残差平方赋予较大的权数。

这样对残差所提供信息的重要程度作一番校正,以提高参数估计的精度。

加权最小二乘法的方法:

4.4简述用加权最小二乘法消除多元线性回归中异方差性的思想与方法。

答:

运用加权最小二乘法消除多元线性回归中异方差性的思想与一元线性回归的类似。

多元线性回归加权最小二乘法是在平方和中加入一个适当的权数

,以调整各项在平方和中的作用,加权最小二乘的离差平方和为:

(2)

加权最小二乘估计就是寻找参数

的估计值

使式

(2)的离差平方和

达极小。

所得加权最小二乘经验回归方程记做

(3)

多元回归模型加权最小二乘法的方法:

首先找到权数

,理论上最优的权数

为误差项方差

的倒数,即

(4)

误差项方差大的项接受小的权数,以降低其在式

(2)平方和中的作用;误差项方差小的项接受大的权数,以提高其在平方和中的作用。

由

(2)式求出的加权最小二乘估计

就是参数

的最小方差线性无偏估计。

一个需要解决的问题是误差项的方差

是未知的,因此无法真正按照式(4)选取权数。

在实际问题中误差项方差

通常与自变量的水平有关(如误差项方差

随着自变量的增大而增大),可以利用这种关系确定权数。

例如

与第j个自变量取值的平方成比例时,即

=k

时,这时取权数为

(5)

更一般的情况是误差项方差

与某个自变量

(与|ei|的等级相关系数最大的自变量)取值的幂函数

成比例,即

=k

其中m是待定的未知参数。

此时权数为

(6)

这时确定权数

的问题转化为确定幂参数m的问题,可以借助SPSS软件解决。

4.5(4.5)式一元加权最小二乘回归系数估计公式。

证明:

4.6验证(4.8)式多元加权最小二乘回归系数估计公式。

证明:

对于多元线性回归模型

(1)

,即存在异方差。

设

,

用

左乘

(1)式两边,得到一个新的的模型:

,即

。

因为

,

故新的模型具有同方差性,故可以用广义最小二乘法估计该模型,得

原式得证。

4.7有同学认为当数据存在异方差时,加权最小二乘回归方程与普通最小二乘回归方程之间必然有很大的差异,异方差越严重,两者之间的差异就越大。

你是否同意这位同学的观点?

说明原因。

答:

不同意。

当回归模型存在异方差时,加权最小二乘估计(WLS)只是普通最小二乘估计(OLS)的改进,这种改进可能是细微的,不能理解为WLS一定会得到与OLS截然不同的方程来,或者大幅度的改进。

实际上可以构造这样的数据,回归模型存在很强的异方差,但WLS与OLS的结果一样。

加权最小二乘法不会消除异方差,只是消除异方差的不良影响,从而对模型进行一点改进。

第五章

5.4试述前进法的思想方法。

答:

前进法的基本思想方法是:

首先因变量Y对全部的自变量x1,x2,...,xm建立m个一元线性回归方程,并计算F检验值,选择偏回归平方和显著的变量(F值最大且大于临界值)进入回归方程。

每一步只引入一个变量,同时建立m-1个二元线性回归方程,计算它们的F检验值,选择偏回归平方和显著的两变量变量(F值最大且大于临界值)进入回归方程。

在确定引入的两个自变量以后,再引入一个变量,建立m-2个三元线性回归方程,计算它们的F检验值,选择偏回归平方和显著的三个变量(F值最大)进入回归方程。

不断重复这一过程,直到无法再引入新的自变量时,即所有未被引入的自变量的F检验值均小于F检验临界值Fα(1,n-p-1),回归过程结束。

5.5试述后退法的思想方法。

答:

后退法的基本思想是:

首先因变量Y对全部的自变量x1,x2,...,xm建立一个m元线性回归方程,并计算t检验值和F检验值,选择最不显著(P值最大且大于临界值)的偏回归系数的自变量剔除出回归方程。

每一步只剔除一个变量,再建立m-1元线性回归方程,计算t检验值和F检验值,剔除偏回归系数的t检验值最小(P值最大)的自变量,再建立新的回归方程。

不断重复这一过程,直到无法剔除自变量时,即所有剩余p个自变量的F检验值均大于F检验临界值Fα(1,n-p-1),回归过程结束。

5.6前进法、后退法各有哪些优缺点?

答:

前进法的优点是能够将对因变量有影响的自变量按显著性一一选入,计算量小。

前进法的缺点是不能反映引进新变量后的变化,而且选入的变量就算不显著也不能删除。

后退法的优点是是能够将对因变量没有显著影响的自变量按不显著性一一剔除,保留的自变量都是显著的。

后退法的缺点是开始计算量大,当减少一个自变量时,它再也没机会进入了。

如果碰到自变量间有相关关系时,前进法和后退法所作的回归方程均会出现不同程度的问题。

5.7试述逐步回归法的思想方法。

答:

逐步回归的基本思想是有进有出。

具体做法是将变量一个一个的引入,当每引入一个自变