CCD和CMOS图像传感器.docx

《CCD和CMOS图像传感器.docx》由会员分享,可在线阅读,更多相关《CCD和CMOS图像传感器.docx(13页珍藏版)》请在冰豆网上搜索。

CCD和CMOS图像传感器

CCD和CMOS图像传感器

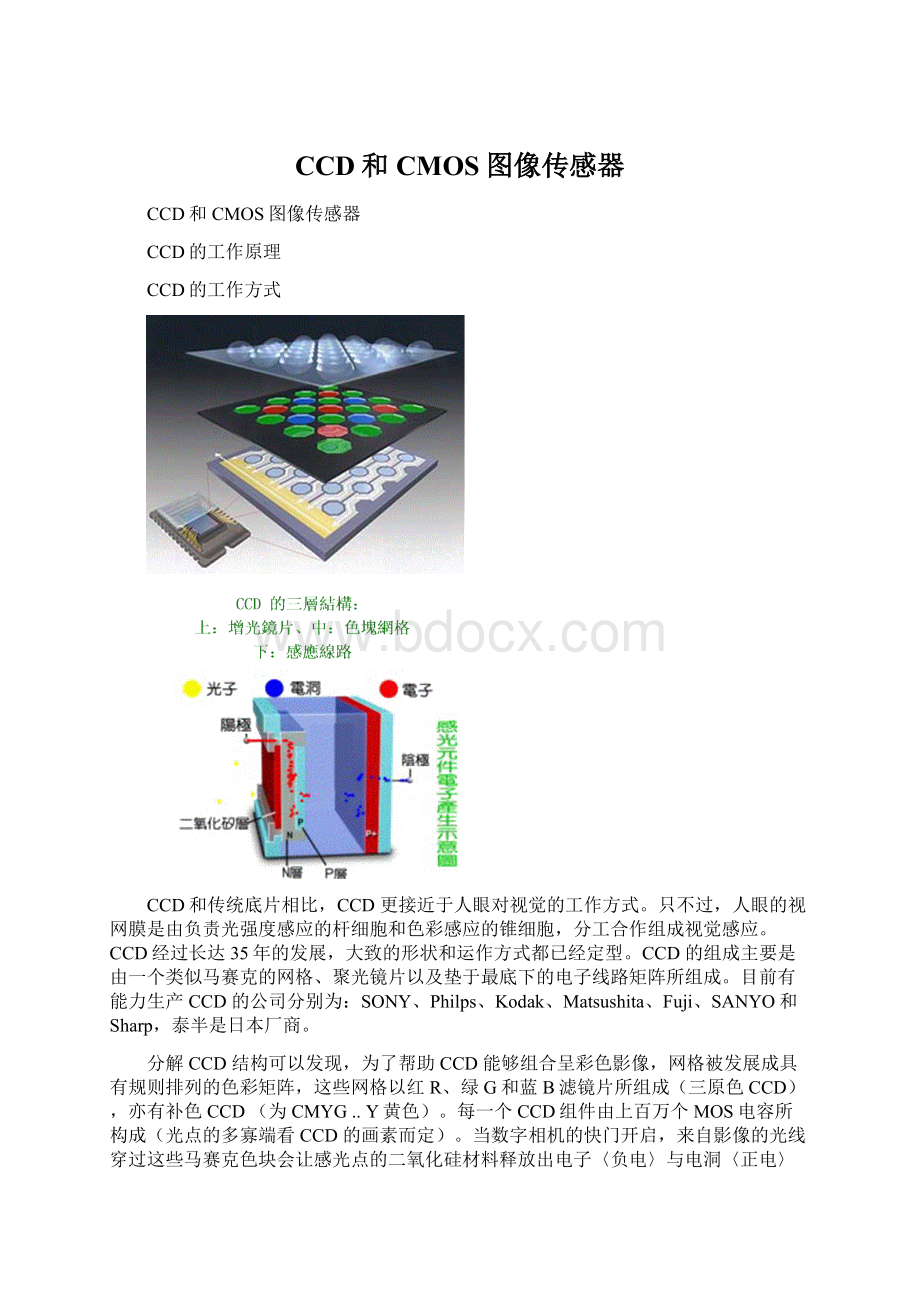

CCD的工作原理

CCD的工作方式

CCD和传统底片相比,CCD更接近于人眼对视觉的工作方式。

只不过,人眼的视网膜是由负责光强度感应的杆细胞和色彩感应的锥细胞,分工合作组成视觉感应。

CCD经过长达35年的发展,大致的形状和运作方式都已经定型。

CCD的组成主要是由一个类似马赛克的网格、聚光镜片以及垫于最底下的电子线路矩阵所组成。

目前有能力生产CCD的公司分别为:

SONY、Philps、Kodak、Matsushita、Fuji、SANYO和Sharp,泰半是日本厂商。

分解CCD结构可以发现,为了帮助CCD能够组合呈彩色影像,网格被发展成具有规则排列的色彩矩阵,这些网格以红R、绿G和蓝B滤镜片所组成(三原色CCD),亦有补色CCD(为CMYG..Y黄色)。

每一个CCD组件由上百万个MOS电容所构成(光点的多寡端看CCD的画素而定)。

当数字相机的快门开启,来自影像的光线穿过这些马赛克色块会让感光点的二氧化硅材料释放出电子〈负电〉与电洞〈正电〉。

经由外部加入电压,这些电子和电洞会被转移到不同极性的另一个硅层暂存起来。

电子数的多寡和曝光过程光点所接收的光量成正比。

在一个影像最明亮的部位,可能有超过10万个电子被积存起来。

以市面上常见的IL型CCD为例,曝光之后所有产生的电荷都会被转移到邻近的移位缓存器中,并且逐次逐行的转换成信号流从矩阵中读取出来。

这些强弱不一的讯号,会被送入一个DSP也就是数字影像处理单元。

在这个单元之中有一个A/D模拟数字讯号转换器。

这个转换器能将信号的连续范围配合色块码赛克的分布,转换成一个2D的平面表示系列,它让每个画素都有一个色调值,应用这个方法,再由点组成网格,每一个点(画素)现在都有用以表示它所接受的光量的二进制数据,可以显

示强弱大小,最终再整合影像输出。

四种类型的CCD

因应不同种类的工作需求,业界发展出四种不同类型的CCD:

Linear线性、Interline扫瞄、全景Full-Frame和Frame-Transfer全传。

线型CCD是以一维感光点构成,透过步进马达扫瞄图像,由于照片是一行行组成,所以速度较使用2维CCD的数字相机来得慢。

这型CCD大多用于平台式扫描仪之上。

Interline扫瞄型CCD的曝光步骤(STEP1.-见左图)和前面介绍的相同,所不同处在于读取电荷的方式。

InterlineCCD透过垂直传送带(STEP2.)从暂存矩阵中读出讯号,再向下转移至底部水平转换记录器(STEP3.),然后电荷在搬到放大器中(橘色圆圈),之后在到DSP里读出水平光电位置行列,最后产生电子信号代表一张完整的数字影像。

清空缓存器后,再重新设定光电位置以便接收下一张影像。

IL型CCD的优点在于曝光后即可将电荷储存于缓存器中,组件可以继续拍摄下一张照片,因此速度较快,目前的反应速度以已经可达每秒15张以上。

但IL的缺点则是暂存区占据了感光点的面积,因此动态范围(DynamicRange-系统最亮与最暗之间差距所能表现的程度)较小。

不过,由于其速度快、成本较低,因此市面上超过86%以上的数字相机都以IL型CCD为感光组件。

Full-Frame全像CCD是一种架构更简单的感光设计。

有鉴于IL的缺点,FF改良可以利用整个感光区域(没有暂存区的设计),有效增大感光范围,同时也适用长时间曝光。

其曝光过程和Interline相同,不过感光和电荷输出过程是分开。

因此,使用FFCCD的数字相机在传送电荷信息时必须完全关闭快门,以隔离镜头入射的光线,防止干扰。

这也意味着FF必须使用机械快门(无法使用IL的电子CLOCK快门),同时也限制了FFCCD的连续拍摄能力。

Full-FrameCCD大多被用在顶级的数位机背上。

富士SUPERCCD蜂窝技术

从上述的文章中我们可以了解,CCD的感光点排列是影响CCD感光范围和动态能力的关键。

早期的CCD都是井然有序的『耕田』状。

当CCD技术到了日本富士手中,工程师开始省思CCD一定要这样排列吗?

为了兼具IL的低成本设计,又要能兼顾FF的大感光面积,富士提出了一个跌破专家眼镜的折衷方案SuperCCD。

SuperCCD是目前市面上唯一使用蜂巢式结构的CCD,其藉助八边形几何构造和间断排列,以IL的方式为基本,争取最大限度的CCD有效面积利用率。

但,早先的技术让通道过于拥挤,产生了不良的噪声,时至今日SUPERCCD已经发展进入第三代,几乎所有不良的缺点都已经改进。

BIT与BITE

在上一讲中,我们了解了CCD的运作方式,这一讲我们将更深入的来研究A/D转换器是如何来处理CCD感光所传来的讯号。

这个部分有点类似计算机概论的课程,数字影像和传统影像不同,数字影像必须将传统影像中的银盐分子化作数字信号来表示。

网友可以试着用WORDPAD或记事本这类的小软件直接阅读JPG影像档案,你们会发现这些档案的背后都是由数字(机械码)所构成的,没有适合的解读软件搭配,例如:

ACDSEE5.0这些数字对同学们来说是没有意义的。

读图软件可以透过计算机来编译这些数字和排列,才能真正在屏幕上的正确位置,显示出正确的色彩和强弱。

那数字相机是如何将光转化成每一张计算机可阅读的数字照片?

事实上数字照片都是由画素构成的,每个画素能够记录BIT(位)的范围取决于A/D转换器的设计。

如果它仅提供一个3BIT的色阶深度,那对于每个画素来说,就有来自8个不同灰阶等级(2的3次方)中一个的数据,可以被记录下来。

但事实上,这样的变化还是太小,在连续色调影像中需要更多的色阶分色,才能更逼真的表达真实影像。

过去,普遍的网络和标准级数位相机,都具有至少8BIT(256灰阶-2的8次方)的处理器,这是大多数计算机屏幕所能显示的范围。

而消费和专业级的数字相机,需要更高的解像力,因此每个红、绿和蓝色输出至少要达到10BIT以上(1024灰阶)才行,而四百万画素以上的数字相机,大多以配置到12Bit的A/D处理器(例如:

MinoltaDiMAGEF100/7Hi)。

更高阶的处理器如:

14BIT的数位相机,已有Panasonic、SONY等,厂家推出。

计算机阅读图文件的限制

很遗憾,不是A/D转换器的BIT数越多,显示的影像就成等比例的精确。

尽管高BIT的A/D转换器对画质的改善确有帮助。

但实际上在计算机屏幕上的显示,却受限于后来的数字影像加工处理过程,不得不被减少、处理或压缩多余的BIT数据,以产生可被计算机一般模式下所接受的影像格式。

一般的计算机都可以显示24BIT的全彩JPEG档案。

换言之,就是R、G、B三原色各使用8BIT的色彩频道,这样JPEG的色彩组成可达1677万色之谱,达到人眼范围的极限。

也就是说,数字相机只要配置8BIT的A/D转换器,就足敷所需。

可是既然计算机只能接受8BIT的色彩数据,为何数字相机要开发到14BIT以上的转换器呢?

关键有二:

一是配合数字相机厂商开发了自己的档案格式,例如:

RAW档案,RAW可以充份的纪录下这款数字相机在拍摄这张照片时所有的原始数据,由于并没有统一的RAW档格式,各家厂商可以依据自身数字相机的设计,摆脱JPEG规格的束缚,让色彩和画质表现达到完美。

二是增加合并数字影像计算时的参考数据,部分数字相机的DSP程序中具有增强的解像力的功能,这个程序主要是参照取样画素之邻近画素之表现,做一统计而成。

因此,BIT的越高的A/D转换器就具有更多的取样参数,相对的合并计算出的24BITJPEG档案的表现,要比单纯的JPEG档来得好。

绿色视觉和红外线干扰

另一个可能困扰网友的问题是,为什么在四色色块马赛克中,除了三原色RGB外,要有两个绿色呢?

这是因为,大多数的人类视觉都集中在绿色前后的光谱波段上面。

相对于CCD或CMOS由于对光子的反应较为敏感,因此可以感应到红外、紫外这两个人眼所看不到的波长。

特别是红外线,会影像拍摄品质的表现。

因此,大多数的CCD都覆盖上了一层MASK以抵挡过量的红外线。

CCDISO感光能力

使用CCD作为感光组件的数字相机,无法像传统相机一样选择底片来换成较高(ISO1600)或较低(ISO50)的感光能力。

一般消费级数位相机通常具有相当于ISO100~120左右的感光能力。

新技术的进步,让CCD可以拥有媲美高感度底片之ISO1600的感光能力。

CCD提高ISO的能力通常分为韧体和软件处理上的设计,例如:

简化来自特定区域CCD上的画素信号来提高ISO表现(因为CCD无法在物理上增大感光面积,只好联合矩阵在处理上『模拟』大感光面积的方式,所以ISO越高就必须相对的降低分辨率-见下图),但这也相对的降低了影像的色调范围。

而软件处理则是根据数据运算,取得合理的曝光表现,但通常也会伴随着噪声的产生。

同样,数字相机最大的ISO值主要是取决于最低的可接受的信噪比(S/N)。

克服S/N的最大关键乃是位于CCD组件中的『电极暗电流-Blacklevel』电荷。

暗电流是指在没有入射光的情况下CCD所仍具有之电荷量,理想的CCD其暗电流应该是零,但部分游离电荷会残存在电极之间,导致没有光线下CCD还是『感应』到些许的『电荷』存在,形成了『看到了』的杂像!

S/N的强度还会随温度增高而增加(每增加10℃,S/N可能增加1倍)。

因此,在连续使用数字相机过久的情况下,机体温度过热会导致画面的噪声增加。

另一方面,曝光过度也会使景物较为明亮区域的CCD带有过量电子。

一般来说CCD会忠实的反应其结果,就是曝光过度的白光!

。

不过,在极端情况下,CCD的电子会渗进邻近的电极当中,导致数字影像拖出长白光迹或变色光影。

CCD色调范围与时脉运行

在准确地曝光下,CCD将比正片更能捕捉到宽广的影像色调范围。

一个普通的CCD可以记录250:

1(8级光圈)左右的高反差场景。

高档的FFCCD系统则可处理近1000:

1的色调范围。

不过,最终输出在相纸上的影像大约仅能再现出32:

1或5级光圈的色调范围。

除了CCD色调处理范围外,时脉运行也是控制CCD一个很重要的环节。

我们本篇文章的(上)集中提过,CCD的三种运作原理,在IL系列的CCD中电荷必须透过缓存器的转移,才能运送至放大器重新计算这些电荷信息,变成实际的数字影像。

这个过程主要是透过CCD的时脉(Cloxking)运行控制,主流设计大致分为三种:

4、3、2相位(Phase)。

当光线照射CCD产生电子和电洞(如2.),并在上层的导电闸施以正电+V后,电子会集中在SiO2和Si之间。

施电压后储存电子会进行排列,(如3.),当L1被施以正电压时,L2和L3为零电压时,电子会集中在Gate闸下。

当扫瞄(Scan)讯号到达L2时,L1仍保持Vg,L3仍为零,此时电子平均分布在n/pGate之间。

之后,重设讯号(Reset)到达,使L1恢复为零,电子就集中在pGate下方。

直到扫瞄讯号到达L3,pGate下的电子由左至右经由传导,抵达输出端。

在扫瞄讯号到达L3后,下一轮的重设讯号又会将L3恢复为零,新周期又重新开始。

此为「三阶段法」(three-phase),电子要到达输出端必须要经过三阶段:

L1=Vg,L2=0,L3=0 /L1=Vg,L2=Vg,L3=0/L1=0,L2=Vg,L3=0。

同样的二阶段和四阶段法,作用大致相同。

CMOS图像传感器的工作原理及研究

52RD.com 2005年5月28日 佚名 评论:

2条 查看 我来说两句

摘要:

介绍了CMOS图像传感器的工作原理,比较了CCD图像传感器与CMOS图像传感器的优缺点,指出了CMOS图像传感器的技术问题和解决途径,综述了CMOS图像传感器的现状和发展趋势。

1 引言

自从上世纪60年代末期,美国贝尔实验室提出固态成像器件概念后,固体图像传感器便得到了迅速发展,成为传感技术中的一个重要分支,它是PC机多媒体不可缺少的外设,也是监控中的核心器件。

互补金属氧化物半导体(CMOS)图像传感 器与电荷耦合器件(CCD)图像传感器的研究几乎是同时起步,但由于受当时工艺水平的限制,CMOS图像传感器图像质量差、分辨率低、噪声降不下来和光照灵敏度不够,因而没有得到重视和发展。

而CCD器件因为有光照灵敏度高、噪音低、像素少等优点一直主宰着图像传感器市场。

由于集成电路设计技术和工艺水平的提高,CMOS图像传感器过去存在的缺点,现在都可以找到办法克服,而且它固有的优点更是CCD器件所无法比拟的,因而它再次成为研究的热点。

70年代初CMOS传感器在NASA的Jet Pro_pul_sion Laboratory(JPL)制造成功,80年代末,英国爱丁堡大学成功试制出了世界第一块单片CMOS型 图像传感器件,1995年像元数为(128×128)的高性能CMOS有源像素图像传感器由喷气推进实验室首先研制成功[1],1997年英国爱丁堡VLSI Ver_sion公司首次实现了CMOS图像传感器的商品化,就在这一年,实用CMOS技术的特征尺寸已达到0.35mm,东芝研制成功了光敏二极管型APS,其像元尺寸为5.6mm×5.6mm,具有彩色滤色膜和微透镜阵列,2000年日本东芝公司和美国斯坦福大学采用0.35mm技术开发的CMOS-APS已成为开发超微型CMOS摄像机的主流产品。

2 技术原理

CCD型和CMOS型固态图像传感器在光检测方面都利用了硅的光电效应原理,不同点在于像素光生电荷的读出方式。

CMOS图像传感器芯片的结构 [2]如图1所示。

典型的CMOS像素阵列[3],是一个二维可编址传感器阵列。

传感器的每一列与一个位线相连,行允许线允许所选择的行内每一个敏感单元输出信号送入它所对应的位线上(图2),位线末端是多路选择器,按照各列独立的列编址进行选择。

根据像素的不同结构[4],CMOS图像传感器可以分为无源像素被动式传感器(PPS)和有源像素 主动式传感器(APS)。

根据光生电荷的不同产生方式APS又分为光敏二极管型、光栅型和对数响应型,现在又提出了DPS(digital pixel sensor)概念。

PPS[4,5]出现得最早,结构也最简单,使得CMOS图像传感器走向实用化,其结构原理如图3所示。

每一个像素包含一个光敏二极管和一个开关管TX。

当TX选通时,光敏二极管中由于光照产生的电荷传送到了列线col,列线下端的积分放大器将该信号转化为电压输出,光敏二极管中产生的电荷与光信号成一定的比例关系。

无源像素具有单元结构简单、寻址简单、填充系数高、量子效率高等优点,但它灵敏度低、读出噪声大。

因此PPS不利于向大型阵列发展,所以限制了应用,很快被APS代替

光敏二极管像素单元[6]如图4所示。

它是由光敏二极管,复位管M4,源跟随器M1和行选通开关管M2组成,此外还有电荷溢出门管M3,M3的作用是增加电路的灵敏度,用一个较小的电容就能够检测到整个光敏二极管的n+扩散区所产生的全部光生电荷,它的栅极接约1V的恒定电压,在分析器件工作原理时可以忽略将其看成短路。

电荷敏感扩散电容用做收集光生电荷。

复位管M4对光敏二极管和电容复位,同时作为横向溢出门控制光生电荷的积累和转移。

源跟随器M1的作用是实现对信号的放大和缓冲,改善APS的噪声问题。

源跟随器还可加快总线电容的充放电,因而允许总线长度增加和像素规模增大。

因此,APS比PPS具有低读出噪声和高读出速率等优点,但像素单元结构复杂,填充系数降低,填充系数一般只有20%到30%。

它的工作过程是:

首先进入“复位状态”,M1打开,对光敏二极管复位;然后进入“取样状态”,M1关闭,光照射到光敏二极管上产生光生载流子,并通过源跟随器M2放大输出;最后进入“读出状态”,这时行选通管M3打开,信号通过列总线输出。

光栅型APS[7,8]是由美国喷气推进实验室(JPL)首先推出的,其像素单元和读出电路如图5所示。

其中感光结构由光栅PG 和传输门TX构成。

光栅输出端为漂移扩散端FD,它与光栅PG被传输门TX隔开。

像素单元还包括一个复位晶体管M1,一个源跟随器M2和一个行选通晶体管M3。

当光照射在像素单元时,在光栅PG处产生电荷;与此同时,复位管M1打开,对势阱复位;然后复位管关闭,行选通管M3打开,复位后的电信号由此通路被读出并暂存起来,之后传输门TX打开,光照产生的电信号通过势阱并被读出,前后两次的信号差就是真正的图像信号。

对数响应型CMOS-APS[9]拥有很高的动态范围,其像素单元结构如图6所示。

它由光敏二极管、负载管M1、源跟随器M2和行选通管M3组成,负载管栅极是一恒定偏置电压(不一定要是电源电压),该像素单元输出信号与入射光信号成对数关系,它的工作特点是光线被连续地转化为信号电压,而不像一般APS那样存在复位和积分过程。

但是,对数响应型CMOS-APS的一个致命缺陷就是对器件参数相当敏感,特别是阈值电压。

PPS和APS都是在像素外进行模/数(A/D)转换的,而DPS[3]将模/数(A/D)转换集成在每一个像素单元里,每一个像素单元输出的是数字信号,工作速度更快,功耗更低。

这种传感器还处于研究阶段。

3 主要特点

表1给出CCD与CMOS图像传感器的性能比较,与CCD图像传感器相比,CMOS图像传感器具有明显的优势。

CCD存储的电荷信息,需在同步信号控制下一位一位地实施转移后读取,电荷信息转移和读取输出需要有时钟控制电路和三组不同的电源相配合,整个电路较为复杂,速度较慢。

CMOS光电传感器[10,11] 经光电转换后直接产生电压信号,信号读取十分简单,还能同时处理各单元的图像信息,速度比CCD快得多。

CCD与CMOS两种传感器在“内部结构”和“外部结构”上都是不同的[12]。

CCD器件的成像点为X-Y纵横矩阵排列,每个成像点由一个光电二极管和其控制的一个电荷存储区组成;CCD仅能输出模拟电信号,输出的电信号还需经后续地址译码器、模数转换器、图像信号处理器处理,并且还需提供三相不同电压的电源和同步时钟控制电路。

CMOS器件的集成度高、体积小、重量轻,

CMOS最大的优势是具有高度系统整合的条件,因为采用数字——模拟信号混合设计,从理论上讲,图像传感器所需的所有功能,如垂直位移、水平位移暂存器、传感器阵列驱动与控制系统(CDS)、模数转换器(ADC)接口电路等完全可以集成在一起,实现单芯片成像,避免使用外部芯片和设备,极大地减小了器件的体积和重量。

安捷伦科技[13]采用一种新型的业内标准——32针CLCC(陶瓷无引线芯片载体)研制出应用CMOS图像传感器的数码相机原型产品,只有30mm×30mm×2.5mm大小,非常适合工程监控和工厂自动化等领域。

从功耗和兼容性来看[14],CCD需要外部控制 信号和时钟信号来获得满意的电荷转移效率,还需要多个电源和电压调节器,因此功耗大;而CMOS-APS使用单一工作电压,功耗低,仅相当于CCD的1/10-1/100,还可以与其他电路兼容,具有功耗低、兼容性好的特点。

CCD传感器需要特殊工艺,使用专用生产流程,成本高;而CMOS传感器使用与制造半导体器件90%的相同基本技术和工艺,且成品率高,制造成本低,目前用于摄像的50万像素的CMOS传感器不到10美元。

CCD使用电荷移位寄存器,当寄存器溢出时就会向相邻的像素泄漏电荷,导致亮光弥散,在图像上产生不需要的条纹。

而CMOS-APS中光探测部件和输出放大器都是每个像素的一部分,积分电荷在像素内就被转为电压信号,通过X-Y输出线输出,这种行列编址方式使窗口操作成为可能,可以进行在片平移、旋转和缩放,没有拖影、光晕等假信号,图像质量高。

高速性是CMOS电路的固有特性,CMOS图像传感器可以极快地驱动成像阵列的列总线,并且ADC在片内工作具有极快的速率,对输出信号和外部接口干扰具有低敏感性,有利于与下一级处理器连接。

CMOS图像传感器具有很强的灵活性,可以对局部像素图像进行随机访问,增加了工作灵活性。

4 问题及其解决途径

暗电流[15]是CMOS图像传感器的难题之一。

迄今为止,CMOS成像器件均具有较大的像素尺寸,因此,在正常范围内也会产生一定的暗电流。

通过改进CMOS工艺,压缩结面积可降低暗电流的发生率,也可通过提高帧速率(frame rate)来缩短暗电流的汇集时间,从而减弱暗电流的影响。

噪声的大小直接影响CMOS图像传感器对信号的采集和处理,因此如何提高信噪比是CMOS图像传感器的关键技术之一[16-19]。

噪声主要包括散粒噪声、热噪声、1/f噪声、非均匀噪声和固定图像噪声。

其中散粒噪声和热噪声是由载流子引起的,1/f噪声和非均匀噪声是由材料的缺陷和不均匀性引起的,固定图像噪声是因为工艺的误差使相邻输出信号的源跟随器不匹配引起的。

采取以下措施可抑制噪声和提高灵敏度:

(1)采用减少失调的独特电路,使用制造更加稳定的晶体管专用工艺;

(2)每个像元内含一个对各种变化灵敏度相对较低的放大器;(3)借鉴CCD图像传感器的制备技术,采用相关双取样电路(CDS)技术和微透镜阵列技术;(4)光敏二极管设计成针形结构或掩埋形结构。

为了提高CMOS-APS的填充系数,近几年国外开发的CMOS-APS均具有微透镜阵列结构,在整个CMOS-APS像元上放置一个微透镜将光集中到有效面积上,可以大幅度提高灵敏度和填充系数。

动态范围是反映图像传感器性能的主要指标之一[6],目前CMOS图像传感器的动态范围还稍逊于CCD,虽然对数响应型CMOS图像传感器的动态范围可达120dB,但同时也增加了图像噪声,影响了图像质量。

提高动态范围的方法之一就是利用PECVD超高真空系统以及专用集成电路(ASIC)薄膜技术,改进光电二极管的材料组合,提高低灰度部位的感光度,同时在像素电路的结构及驱动方法上下功夫,实现低灰度时自动转换到线形输出,高灰度时自动转换到对数压缩输出。

5 研究进展

视频便携式摄像机、掌上电脑、PDA和保安设备的巨大需求推动了CMOS图像传感器的广泛应用。

其中以APS发展最为迅速,过去工艺中各种 不易解决的技术问题现在都能找到相应的解决办法,图像质量得到大大改善,像素规模已由最初的几万像素发展到现在的几百万上千万像素。

CDS电路,技术彩色滤波器阵列技术,数字信号处理(DSP)技术,噪声抑制技术不断有新突破,目前CMOS传感器大都采用0.35mm或0.5mm的CMOS制造工艺,CMOS单元面积上的像素数已与CCD相当,因此可基本达到CCD器件的高分辨率。

为了适应技术发展和市场的需要,业界近年主要致力于深亚微米(主要是0.25mm和0.18mm)技术的开发。

2000年9月美国Foveon和国家半导体公司采 用0.18mm CMOS工艺开发出1600万像素(4096×4096)CMOS图像传感器,是目前最大的数字-模拟混合芯片。

其像素是以前发表的照相机CMOS图像传感器的3倍,是当今低档消费数码相机中普遍使用CMOS图像传感器的50倍,其芯片内的晶体管数为7000万个,芯片尺寸为22mm×22mm,这是迄今为止全球集成度最高的器件,这种图像传感器在分辨率和图像质量方面取得了重大突破,标志着CMOS图像传感器在分辨率和质量两方面的飞跃。

CMOS传感器芯片已广泛用于数码相机