最新KNIME使用说明Word下载.docx

《最新KNIME使用说明Word下载.docx》由会员分享,可在线阅读,更多相关《最新KNIME使用说明Word下载.docx(12页珍藏版)》请在冰豆网上搜索。

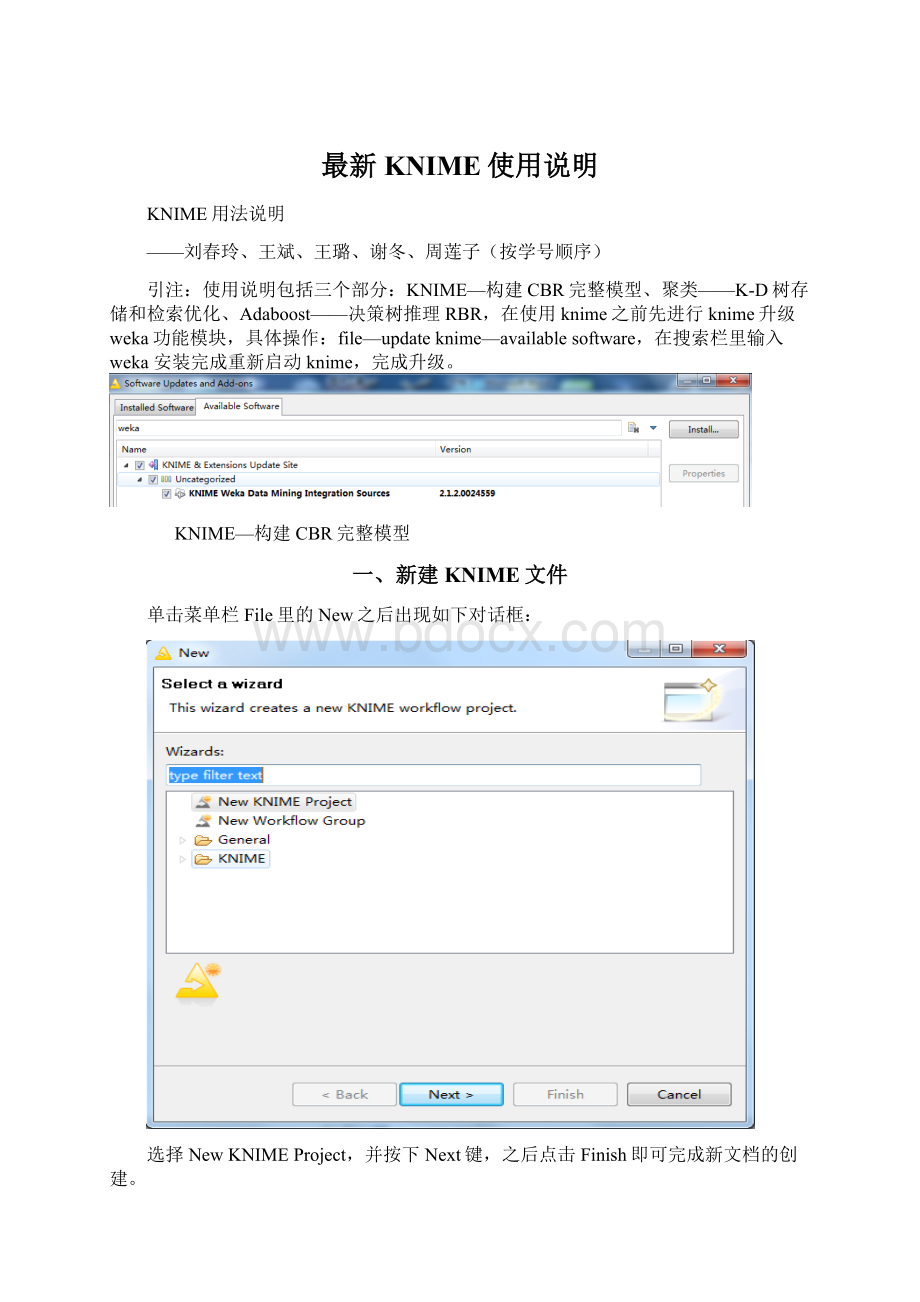

单击菜单栏File里的New之后出现如下对话框:

选择NewKNIMEProject,并按下Next键,之后点击Finish即可完成新文档的创建。

二、K-D树的生成与准确度判断

1.布局

1)查找filereader,其结果如下图所示:

2)分别拖两个filereader出来。

3)将IBK拖出来。

并将其中的一个filereader与IBK连接起来。

4)拖一个WekaPredictor出来并与IBK和另一个filereader连接起来。

5)将Scorer与WekaPredictor连接起来。

其具体的布局和连接情况如下图所示:

2.导入数据

右击第一个FileReader,选择Configure(或直接双击进入),在ValidURL处选择要导入的数据的文件。

之后点击OK就完成了数据的导入。

3.生成K-D树

右击IBK,点击Configure,可以改变KNN的数值,从而改变精度。

改distanceweighting(距离权重)的值为weightby1-distance,之后点击nearestneighbourSearchAlgorithm后面的choose,选择KDTree,点击OK。

4.导入新的数据

其方法与参照步骤2中导入数据的过程

5.模型运行与验证

1)将来自FileReader2的数据和来自IBK的K-D树模型输入到WekaPredictor中。

注:

当发现设置完的结点没有变成绿灯时要及时按下按钮

来执行所有的结点。

2)设置scorer的属性

右击后点击Configure,firstcolumn选择要预测的属性;

secondcolumn选择winner.

6.查看结果

右击后点击accuracystatistics来查看预测的结果。

聚类——K-D树存储和检索优化

1.布局与数据导入

1)先打开knime,再新建(new)一个工程(project)。

2)先拖一个filereader到工作区,右击选择configure,设置成下图形式:

3)再拖入一个k-means(依次mining—clustering---k-means),filereader连接k-means

4)拖入一个interactivetable(data—views—interactivetable),k-means连接interactivetable。

5)再拖入一个filereader,右击选择configure,设置成下图形式:

6)再拖入一个聚类器clusterassigner(三个下拉菜单里存在聚类器,这里选择mining—clustering---clusterassigner)

7)最终使工作区变成如下形式:

2、模型测试与运行

1)点击

,运行,观察各node的运行结果。

2)右击k-means,选择“0labeledinput”,可观察到如下结果:

3)、右击k-means,选择“view:

clusterview”,可观察到如下结果

在interactivetable的“view:

clusterview”中也可观察到相应结果,结果如下图

4、再右击clusterassigner,选择“0assigneddata”,可得到如下结果:

Adaboost——决策树推理RBR

用Adaboost对数据进行训练并得到规则,并用此规则对新数据进行预测

1.布局与数据导入

1)数据源的选取

先查找到FileReader,然后将其拖出。

共拖两个,分别代表用来进行训练的数据和用来预测的数据。

2)找出Adaboost,将其拖出

3)将Wekapredictor和Scorer,Interactivetable拖出,形成如下图所示。

4)开始进行设置。

在第一个FileReader上点击右键,选择Configure,出现如下图所示:

点击“Browse…”,选择数据源。

本例中是选取经过粗糙集处理的241例病例的数据。

5)同理,将第二个FileReader的数据源设置为经过粗糙集处理的61例病例的数据。

如下图:

2.参数设置

1)对Adaboost进行设置,在Adaboost上点击右键,选择Configure,出现如下图所示

其中,numIterations一项指的是将多少个分类器累加,即迭代多少次。

不同的迭代次数会使最后的准确度不同,次数过少会训练不足,次数太多会训练过度,都不会得到最好的结果,需要多次试数。

使最后的准确度最高的迭代次数,就是最合理的迭代次数。

2)对Scorer进行设置,在Scorer上点击右键,选择Configure,出现如下图所示

将进行比较的两列设为如图所示。

即为,将患者实际的是否患病的情况(class)与用训练出的规则预测的情况(winner)进行比较,在Wekapreictor上点击右键,选择0ClassifiedTestData,即可观察比较情况:

如上图,若判断情况相同,则准确度高;

反之,则准确度低。

3.运行与测试

设置完成,即可开始运行

如上图,点击最上面一行的

即可运行,当所有控件下部都显示绿灯时,运行即结束。

如下图所示

4、观察预测结果与分析

在Scorer上点击右键,选择0Confusionmatrix或1AccuracyStatistics,即可观察预测结果(或在InteractiveTable中也能观察),如下图所示

图中数据意为:

实际为Yes的案例一共有20个,但预测结果是11个No,9个Yes;

实际为No的案例一共有41个,但实际预测结果是39个No,2个Yes

如上图所示,规则预测准确率为78.7%,这是在迭代次数为55时的结果。

大家也可以试试变化迭代次数后准确率是否会提高。

5.模型验证——回归检验

上例中,如果将第二个FileReader的数据也换成241例的数据,则会发现最后结果准确率非常高。

这是因为规则就是用这241的数据训练出来的,反过来用这个规则来预测自己本身,自然准确率就会很高。

如下图所示: