信息论期末总结.docx

《信息论期末总结.docx》由会员分享,可在线阅读,更多相关《信息论期末总结.docx(8页珍藏版)》请在冰豆网上搜索。

信息论期末总结

信息论期末总结

消息中包含信息,消息是信息的载体.

信息:

信息是对事物运动状态或存在方

式的不确定性的描述.

通信的过程就是消除不确定性的过程.

信息与概率的关系:

事件发生的概率越大,该事件包含的信息量

越小;

如果一个事件发生的概率为1,那么它包含的信息量为0;

两个相互独立事件所提供的信息量应等于它们各自提供的信息量之和.

1

某个消息的不确定性(含有的信息里,可以‘)

表示为:

q

信源的平均不确定性:

.(x')l09p(xi)

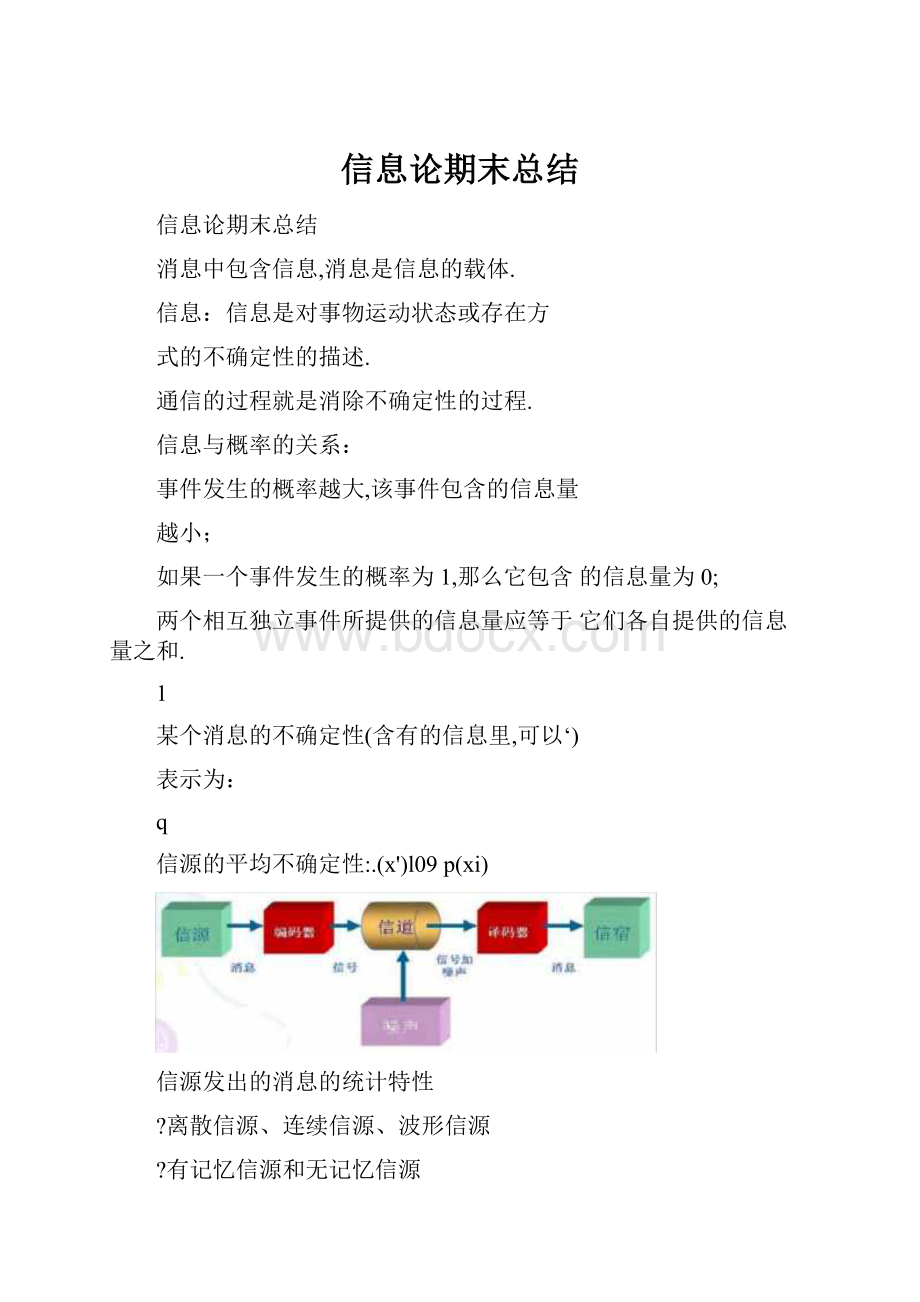

信源发出的消息的统计特性

?

离散信源、连续信源、波形信源

?

有记忆信源和无记忆信源

?

平稳信源和非平稳信源

编码器的功能:

将消息变成适合信道传输的

信号

编码器包括:

〔1〕信源编码器〔2〕信道编

码器〔3〕调制器

信源编码器:

去除信源消息中的冗余度,提

高传输的有效性

信道编码器:

将信源编码后的符号加上冗余符号,提升传输的可靠性.

调制器:

功能:

将信道编码后的符号变成适合信道传输的

信号

目的:

提升传输效率

信道的统计特性

无噪声信道、有噪声信道

离散信道、连续信道、波形信道

有记忆信道和无记忆信道

恒参信道〔平稳信道〕和随参信道〔非平稳信道〕单用户信道和多用户信道

信道传输信息的最高速率:

信道容量

译码器的功能:

从接收到的信号中恢复消

广

/d、o

包括:

(1)解调器

(2)信道译码器(3)信源译码器

提升有效性:

(数据压缩)

信源编码:

无失真信源编码和限失真信源编码提升可靠性:

(可靠传输)

信道编码

香农第一定理:

如果编码后的信源序列的编码信息率不小于信源的燧,那么一定存在一种无失真信源编码方法;否那么,不存在这样的一种无失真信源编码方法.

香农第二定理:

如果信道的信息传输率小于信道容量,那么总可以找到一种编码方式,使得当编码序列足够长时传输过失任意小;否那么,不存在使过失任意小的信道编码方式.

香农第三定理D:

0对而任意的失真度dD,只要码字足够长,那么总可以找到一种编码方法,使编码后的编码信息率,而码的平均失真

度.

公理性条件:

(1)如果p(x1)I(x2),I(xi)

是p(xi)的单调递减函数;

⑵如果p(xi)=0,那么I(xi)-00;如果p(xi)=1,那么I(xi)=0;

(3)由两个相对独立的事件所提供的信息量,应等于它们分别提供的信息量之和:

I(xiyj)=I(xi)+I(yj)自信息可以从两个方面来理解:

自信息是事件发生前,事件发生的不确定性.

自信息表示事件发生后,事件所包含的信息量.

先验概率:

信源发出潸鱼的概率.后验概率:

信宿收到消息x后推测信瘴爰出的概率,即条件概率.

I(x「yj)I(xi)I(xjyj)

10gp(x)10gp(x|yj)(i1,2,,n;j1,2,,m)

10gg2p(X)

互信息有两方面的含义:

?

表示事件由现前后关手事件的不确

定性减少的量;

?

事件由现以后信宿获彳急的关于事件

的信息量.

观察者站在输出端

I(xi;yj)=logp(xi|yj)-logp(xi)=I(xi)

T(xi|yj)

?

观察者站在输入端

I(yj;xi)=logp(yj|xi)4ogp(yj)=I(yj)一

I(yjIxi)

当后验概率大于先验概率时,互信息为正当后验概率小于先验概率时,互信息为负.

当后验概率与先验概率相等时,互信息为零.

任何两个事件之间的互信息不可能大于其中

任一事件的自信息

例6:

居住某地区的女孩中有25%是大学生,在女大学生中有75%是身高1.6m以上的,而女孩中身高1.6m以上的占总数一半.假如我们得知身高1.6m以上的某女孩是大学

生〞的消息,问获得多少信息量?

此消息在二进制对称信道上

传输,信道传输特性为

求互信寞里1abb和.

自信息是一个随机变量:

自信息是指信源发出的某一消息所含有的信息量.不同的消息,它们所含有的信息量也就不同平热碗舄儒踞<』oJ卿商/香农嫡/无条件嫡/嫡函数/嫡)

例2:

一信源有6种输出符号,概率分别为P(A)=O.5,P(B)=0.25,P(C)=0.125,P(D)=P(E)=0.05,

P(F)=0.025o

1)计算H(X)O

2)求符号序列ABABBA和FDDFDF的信息量,并将之与6位符号的信息量期望值相比拟.

递增性h速推性Pn),qi,q2,L,qm)

qiq2,qm、

H(Pi,P2,L,Pn)PnH(,—L,)

PnPnPnnm

其中:

Pi1,qjPni1j1

例4:

利用递推性计算嫡函数H(1/3,1/3,

1/6,1/6)的值

极值性(最大离散嫡定理)

冷理:

离散无记忆信裾辄用lognn个不同的信息

in

符号,当且仅当各个符号出现概率相等时

(即),嫡最大,即

定义2.4随机变量X和Y的联合分布为p(xiyj),那么这两个随机变量的联合嫡定义为:

nm

H(XY)p(Xiyj)10gp(Xiyj)

i1j1

联合嫡表示对于二维随机变量的平均不确定性.

定义2.5随机变量X和Y的条件嫡定义为:

H(X|Y)p(xyj)10gp(Xi|yj)

H(Y|X)p(Xjyj)10gp(yj|为)

ij

条件燧表示一个随机变量时,对另一个随机变量的平均不确定性.

例6:

联合概率分布如下,求:

H(XY),H(X),H(Y),H(Y|X),H(X|Y).

%y2y3y?

X10.25000

x20.100.30000.25

X300.050.1000.40

X4000.050.100.15

X5000.0500.15

0.05

0.350.350.200.10

各种嫡之间的关系

?

H(XY)=H(X)+H(Y|X)=H(Y)+H(X|Y)

?

H(X|Y)H(X),H(Y|X)H(Y)

?

H(XY)H(X)+H(Y)

假设X与Y统计独立,那么H(XY)=H(X)+H(Y)

I(X^Y)土牛(X信息的概念

H(Y)H(Y|X)

H(X)H(Y)H(XY)

平均互信息和各类嫡的关系

I(X;Y)=H(X)-H(X|Y)=H(Y)H(Y|X)=H(X)+H(Y)H(XY)

X,Y互相独立时

定义2:

随机变量序列中,对前N个随机变量的联合燧求平均称为平均符号燧

1

Hn(X)1H(X1X2LXN)

N

如果当N1mH牌工式极限存在,那么

被称为燧率,或极限燧,记为

HN'mHn(X)

离散平稳无记忆信源的N次扩展信源的嫡

等于离散单符号信源嫡的N倍:

H(X)H(Xn)NH(X)

1

H3H(X1X2)H(X)

对于马氏链符号间相关性越大,嫡越小嫡的相对H率

信道的数学模型为{X,P(Y|X),Y}

二元对称信道输入符号集A={0,1},输出符号

集8={0,1},r=s=2.传递概率:

p(0|0)pp(0|1)p

ppppp

p(1|0)p

p(1|1)p

二元删除信道输入符号集A={0,1},符号输出

集8={0,?

1},r=2,s=3

平均互信患X;Y)H(X)H(X|Y)

例3:

求二元螂限信道的1Y〕和I〔X;Y〕

信道容蛰I〔X;Y〕比特/符号

例4以二元对称信道.p信源的概率空间为

pr

信道矩阵为求信道容量?

一个输入对应〞f出嘴H〔X〕logr一个输出对拉籁饰输大需H〔Y〕logs

定义1:

假设信道矩阵P中每行都是第一行的排列,那么称此信道是行对称信道.

定义2:

假设信道矩阵中每行都是第一行的排列,并且每列都是第一列的排列,那么称之为对

称信道.

定义3:

虽然不是对称信道,但是信道矩阵可以按列分为一些对称的子阵,那么称之为准对称信道.

定义4:

假设r=s,且对于每一个输入符号,正确传输概率都相等,且错误传输概率p均

匀地分配到r-1个符号,那么称此信道为强对称信道或均匀信道.