机器学习整理.docx

《机器学习整理.docx》由会员分享,可在线阅读,更多相关《机器学习整理.docx(28页珍藏版)》请在冰豆网上搜索。

机器学习整理

机器学习整理资料

1、学习方法:

二分类:

每个分类器只能把样本分为两类。

瓦普尼克95年提出来基础的支持向量机就是个二分类的分类器,这个分类器学习过 程就是解一个基于正负二分类推导而来的一个最优规划问题(对偶问题),要解决多分类问题 就要用决策树把二分类的分类器级联,VC维的概念就是说的这事的复杂度。

多分类问题:

针对不同的属性训练几个不同的弱分类器,然后将它们集成为一个强分类器。

层次聚类:

创建一个层次等级以分解给定的数据集。

此方法分为自上而下(分解)和自下而上(合并)两种操作方式。

K-中心点聚类:

挑选实际对象来代表簇,每个簇使用一个代表对象。

它是围绕中心点划分的一种规则

回归分析:

处理变量之间具有相关性的一种统计方法

结构分析:

结构分析法是在统计分组的基础上,计算各组成部分所占比重,进而分析某一总体现象的内部结构特征、总体的性质、总体内部结构依时间推移而表现出的变化规律性的统计方法。

结构分析法的基本表现形式,就是计算结构标。

2、监督学习算法:

决策树、朴素贝叶斯、逻辑回归、KNN、SVM、神经网络、随机森林、AdaBoost、遗传算法

无监督学习算法:

聚类、关联规则、训练/学习、预测、K-Means、BIRCH、Apriori

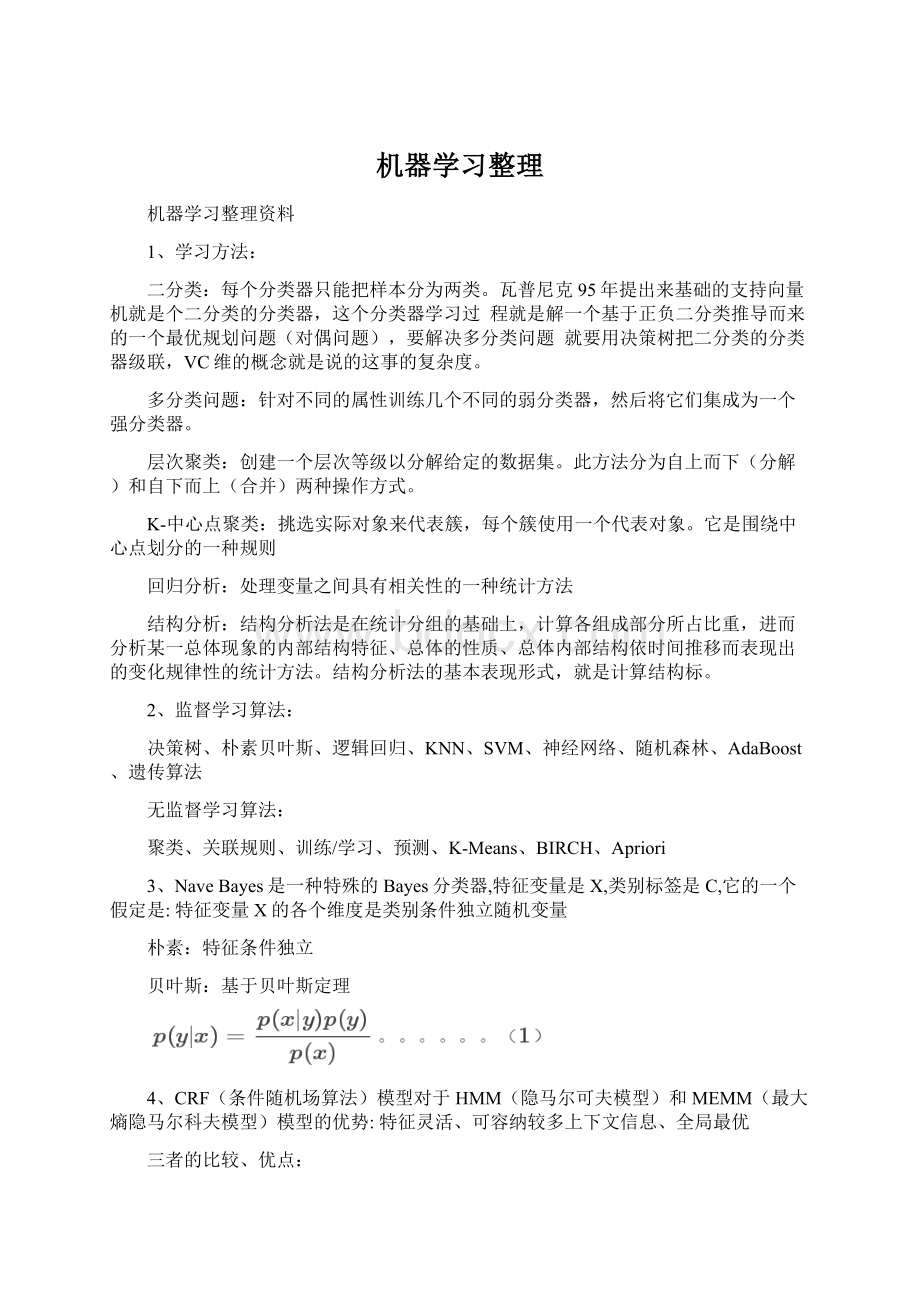

3、NaveBayes是一种特殊的Bayes分类器,特征变量是X,类别标签是C,它的一个假定是:

特征变量X的各个维度是类别条件独立随机变量

朴素:

特征条件独立

贝叶斯:

基于贝叶斯定理

4、CRF(条件随机场算法)模型对于HMM(隐马尔可夫模型)和MEMM(最大熵隐马尔科夫模型)模型的优势:

特征灵活、可容纳较多上下文信息、全局最优

三者的比较、优点:

(1)CRF没有HMM那样严格的独立性假设条件,因而可以容纳任意的上下文信息。

特征设计灵活(与ME一样) ————与HMM比较

(2)同时,由于CRF计算全局最优输出节点的条件概率,它还克服了最大熵马尔可夫模型标记偏置(Label-bias)的缺点。

————与MEMM比较

(3)CRF是在给定需要标记的观察序列的条件下,计算整个标记序列的联合概率分布,而不是在给定当前状态条件下,定义下一个状态的状态分布。

————与ME比较

缺点:

训练代价大、复杂度高

5、KNN算法:

K-NN算法通过计算新数据与训练数据特征值之间的距离,然后选取K(K>=1)个距离最近的邻居进行分类或者回归.如果K=1,那么新数据将被分配给其近邻的类

k-NN最近邻方法在样本较少但典型性好的情况下效果较好.

6、在HMM中,如果已知观察序列和产生观察序列的状态序列,极大似然估计方法直接进行参数估计。

EM算法:

只有观测序列,无状态序列时来学习模型参数,即Baum-Welch算法

维特比算法:

用动态规划解决HMM的预测问题,不是参数估计

前向后向:

用来算概率

极大似然估计:

即观测序列和相应的状态序列都存在时的监督学习算法,用来估计参数

7、常见的判别模型有:

支持向量机传统的神经网络

线性判别分析线性回归逻辑回归最近邻

CRFBoosting

产生式模型常见的主要有:

高斯朴素贝叶斯混合多项式

混合高斯模型专家的混合物

隐马尔可夫模型马尔可夫的随机场

HMMsSigmoidalBeliefNetworks,

BayesianNetworksMarkovRandomFieldsLatentDirichletAllocation

8、已知一组数据的协方差矩阵P,

1、主分量分析的最佳准则是对一组数据进行按一组正交基分解,在只取相同数量分量的条件下,以均方误差计算截尾误差最小

2、在经主分量分解后,协方差矩阵成为对角矩阵

3、主分量是通过求协方差矩阵的特征值得到

4、K-L变换与PCA变换是不同的概念,PCA的变换矩阵是协方差矩阵,K-L变换的变换矩阵可以有很多种(二阶矩阵、协方差矩阵、总类内离散度矩阵等等)。

当K-L变换矩阵为协方差矩阵时,等同于PCA。

9、假定某同学使用NaiveBayesian(NB)分类模型时,不小心将训练数据的两个维度搞重复了,1、模型效果相比无重复特征的情况下精确度会降低2、当两列特征高度相关时,无法用两列特征相同时所得到的结论来分析问题

10、SVM是这样一个分类器,他寻找具有最小边缘的超平面,因此它也经常被称为最小边缘分类器(minimalmarginclassifier)

在聚类分析当中,簇内的相似性越大,簇间的差别越大,聚类的效果就越差。

在决策树中,随着树中结点数变得太大,即使模型的训练误差还在继续减低,但是检验误差开始增大,这是出现了模型拟合不足的问题。

11、SPSS(统计产品与服务解决方案”软件)中,数据整理的功能主要集中在(数据、转换)等菜单中

12、数据清理中,处理缺失值的方法有两种:

删除法:

1)删除观察样本

2)删除变量:

当某个变量缺失值较多且对研究目标影响不大时,可以将整个变量整体删除

3)使用完整原始数据分析:

当数据存在较多缺失而其原始数据完整时,可以使用原始数据替代现有数据进行分析

4)改变权重:

当删除缺失数据会改变数据结构时,通过对完整数据按照不同的权重进行加权,可以降低删除缺失数据带来的偏差

查补法:

均值插补、回归插补、抽样填补等

成对删除与改变权重为一类;估算与查补法为一类

13、卡方检验是用途非常广的一种假设检验方法,它在分类资料统计推断中的应用,包括:

两个率或两个构成比比较的卡方检验;多个率或多个构成比比较的卡方检验以及分类资料的相关分析等。

14、规则化是结构风险最小化策略的实现,是在经验风险上加一个正则化项(regularizer)或惩罚项(penaltyterm)。

1、L1范数和L0范数可以实现稀疏,L1因具有比L0更好的优化求解特性而被广泛应用。

L1正则化偏向于稀疏,它会自动进行特征选择,去掉一些没用的特征,也就是将这些特征对应的权重置为0.

2、使用L2可以得到平滑的权值.

L2主要功能是为了防止过拟合,当要求参数越小时,说明模型越简单,而模型越简单则,越趋向于平滑,从而防止过拟合。

L2范数:

||W||2,因为它的强大功效是改善机器学习里面一个非常重要的问题:

过拟合。

通过L2范数,我们可以实现了对模型空间的限制,从而在一定程度上避免了过拟合。

线性分类器有三大类:

感知器准则函数、SVM、Fisher准则,而贝叶斯分类器不是线性分类器。

15、感知器准则函数:

代价函数J=-(W*X+w0),分类的准则是最小化代价函数。

感知器是神经网络(NN)的基础,

SVM:

支持向量机也是很经典的算法,优化目标是最大化间隔(margin),又称最大间隔分类器,是一种典型的线性分类器。

(使用核函数可解决非线性问题)

Fisher准则:

更广泛的称呼是线性判别分析(LDA),将所有样本投影到一条远点出发的直线,使得同类样本距离尽可能小,不同类样本距离尽可能大,具体为最大化“广义瑞利商”。

贝叶斯分类器:

一种基于统计方法的分类器,要求先了解样本的分布特点(高斯、指数等),所以使用起来限制很多。

在满足一些特定条件下,其优化目标与线性分类器有相同结构(同方差高斯分布等),其余条件下不是线性分类。

线性分类器三种最优准则:

Fisher准则:

根据两类样本一般类内密集,类间分离的特点,寻找线性分类器最佳的法线

向量方向,使两类样本在该方向上的投影满足类内尽可能密集,类间尽可能分开。

这种度量通过类内离散矩阵Sw和类间离散矩阵Sb实现。

感知准则函数:

准则函数以使错分类样本到分界面距离之和最小为原则。

其优点是通过错分类样本提供的信息对分类器函数进行修正,这种准则是人工神经元

网络多层感知器的基础。

支持向量机:

基本思想是在两类线性可分条件下,所设计的分类器界面使两类之间的

间隔为最大,它的基本出发点是使期望泛化风险尽可能小。

16、INDEX:

函数返回表格或区域中的值或值的引用.

MATCH:

在范围单元格中搜索特定的项,然后返回该项在此区域中的相对位置.

VLOOKUP&HLOOKUP:

在表格的首行或数值数组中搜索值,然后返回表格或数组中指定行的所在列中的值.当比较值位于数据表格的首行时,如果要向下查看指定的行数,则可使用HLOOKUP;当比较值位于所需查找的数据的左边一列时,则可使用VLOOKUP.

FIND:

返回一个字符串在另一个字符串中出现的起始位置(区分大小写).

IF:

可以对值和期待值进行逻辑比较.

LIKE:

可用Like运算符自定义字符比较函数之类的,应该是VBA的函数.

17、统计模式分类问题中,当先验概率未知时,可以使用1、最小最大损失准则2、N-P判决

A.最小最大损失准则考虑p(wi)变化的条件下,是风险最小

B.最小误判概率准则,就是判断p(w1|x)和p(w2|x)哪个大,x为特征向量,w1和w2为两分类,根据贝叶斯公式,需要用到先验知识

C.最小损失准则,在B的基础之上,还要求出p(w1|x)和p(w2|x)的期望损失,因为B需要先验概率,所以C也需要先验概率

D.N-P判决,即限定一类错误率条件下使另一类错误率为最小的两类别决策,即在一类错误率固定的条件下,求另一类错误率的极小值的问题,直接计算p(x|w1)和p(x|w2)的比值,不需要用到贝叶斯公式

18、隐马尔可夫模型三个基本问题以及相应的算法说法1、评估—前向后向算法2、解码—维特比算法3、学习—Baum-Welch算法

19、聚类的目标是使同一类对象的相似度尽可能地大;不同类对象之间的相似度尽可能地小。

目前聚类的方法很多,根据基本思想的不同,大致可以将聚类算法分为五大类:

层次聚类算法、分割聚类算法、基于约束的聚类算法、机器学习中的聚类算法和用于高维度的聚类算法

1、层次聚类算法

1.1聚合聚类

1.1.1相似度依据距离不同:

Single-Link:

最近距离、Complete-Link:

最远距离、Average-Link:

平均距离

1.1.2最具代表性算法

1)CURE算法

特点:

固定数目有代表性的点共同代表类

优点:

识别形状复杂,大小不一的聚类,过滤孤立点

2)ROCK算法

特点:

对CURE算法的改进

优点:

同上,并适用于类别属性的数据

3)CHAMELEON算法

特点:

利用了动态建模技术

1.2分解聚类

1.3优缺点

优点:

适用于任意形状和任意属性的数据集;灵活控制不同层次的聚类粒度,强聚类能力

缺点:

大大延长了算法的执行时间,不能回溯处理

2、分割聚类算法

2.1基于密度的聚类

2.1.1特点

将密度足够大的相邻区域连接,能有效处理异常数据,主要用于对空间数据的聚类

2.1.2典型算法

1)DBSCAN:

不断生长足够高密度的区域

2)DENCLUE:

根据数据点在属性空间中的密度进行聚类,密度和网格与处理的结合

3)OPTICS、DBCLASD、CURD:

均针对数据在空间中呈现的不同密度分不对DBSCAN作了改进

2.2基于网格的聚类

2.2.1特点

利用属性空间的多维网格数据结构,将空间划分为有限数目的单元以构成网格结构;

1)优点:

处理时间与数据对象的数目无关,与数据的输入顺序无关,可以处理任意类型的数据

2)缺点:

处理时间与每维空间所划分的单元数相关,一定程度上降低了聚类的质量和准确性

2.2.2典型算法

1)STING:

基于网格多分辨率,将空间划分为方形单元,对应不同分辨率

2)STING+:

改进STING,用于处理动态进化的空间数据

3)CLIQUE:

结合网格和密度聚类的思想,能处理大规模高维度数据

4)WaveCluster:

以信号处理思想为基础

2