Feng笔记SPSS操作中的各种检验统计量和判别准则完整手册10天完成Word下载.docx

《Feng笔记SPSS操作中的各种检验统计量和判别准则完整手册10天完成Word下载.docx》由会员分享,可在线阅读,更多相关《Feng笔记SPSS操作中的各种检验统计量和判别准则完整手册10天完成Word下载.docx(51页珍藏版)》请在冰豆网上搜索。

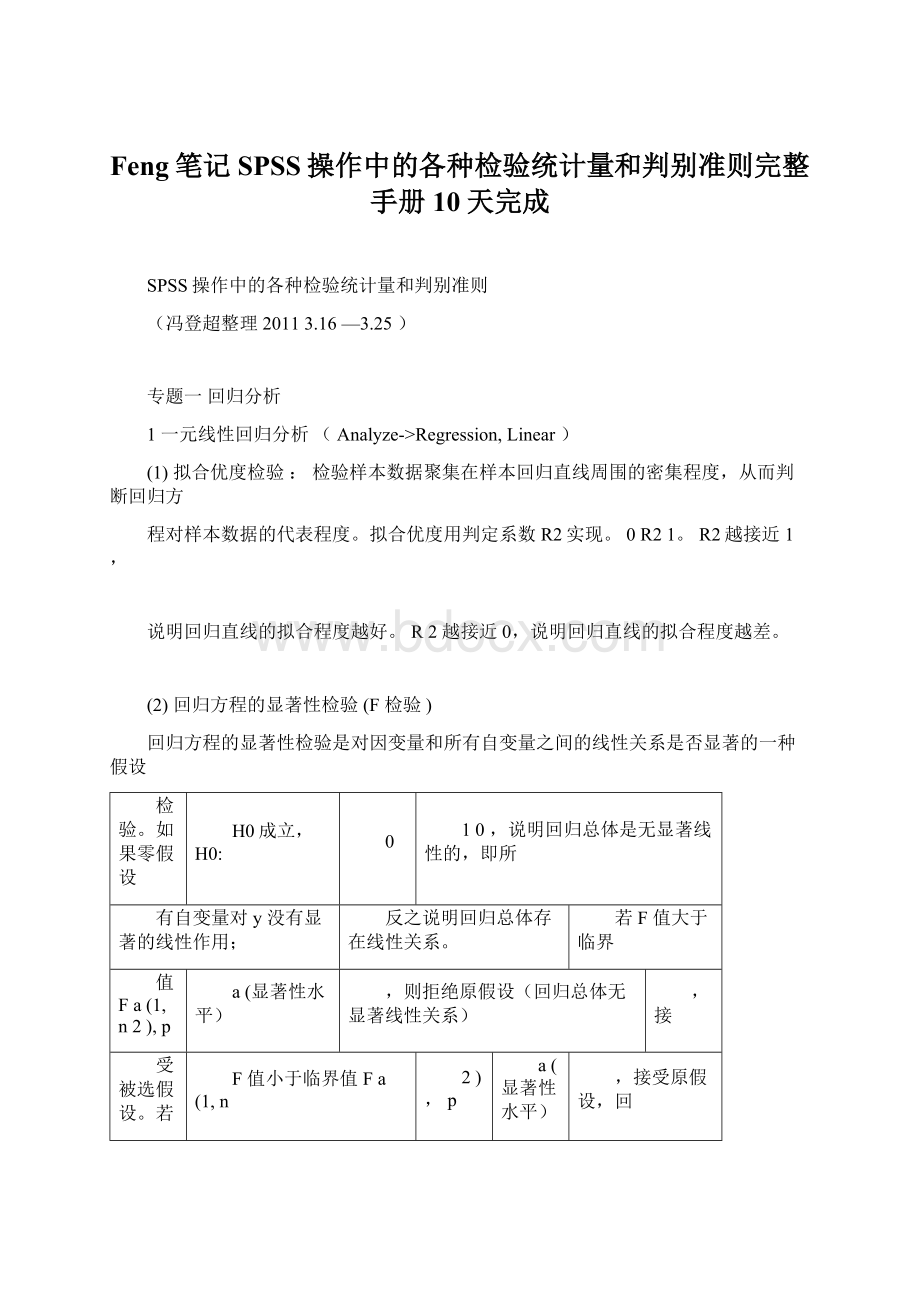

如果双侧t检验中,t的绝对值大于临界值(或

者(p<

a),则拒绝原假设,接受被选假设,说明x对y有显著影响;

若t的绝对值小于临

界值的绝对值(p>

a),则接受原假设,说明x对y没有显著影响。

在一元线性回归分析

中,回归方程的显著性检验可以代替回归系数的显著性检验,并且F=t2。

但是,在一般

的多元回归条件下两种检验要说明的问题不同,作用不同,不能相互替代。

在Coefficients表中,t为回归系数检验统计量,Sig为相伴概率值p。

若p<

0.05,说明回归系数和0有显著差别,说明该回归方程有意义。

在UseprobalitityofF:

当一个自变量的F统计量的相伴概率值Sig<

=0.05时,拒绝H0,

认为该变量对因变量影响是显著的,应该引入回归方程;

若一个自变量的F统计量的

Sig>

=0.10时,不能拒绝Ho,认为该变量对因变量的影响是不显著的,应从回归方程中剔除。

在UseFvalue中,表示以回归系数显著性检验中的各自变量的F统计量作为自变量进

入模型或从模型剔除的准则。

在变量的选择/剔除中,Entry(默认值3.84),表示当一个变量

的F值》=3.84时,该变量被选入模型;

Removal(默认值2.71),表示当一个变量的F值<

=2.71时,该变量从模型中被剔除。

2.多元线性回归分析

研究两个或两个以上自变量对一个因变量的数量变化关系。

(1)拟合优度检验

0R2

2

越接近1,说明回归平面的拟合程度越好。

1,R

R越接近0,说明回

归平面的拟合程度越差。

修正的

R

考虑的是平均的残差平方和,

在线性回归分析中,

越

大越好。

(2)回归方程的显著性检验(F检验)

若F值较大,说明自变量造成的因变量的变动远远大于随机因素对因变量造成的影响。

此外,F统计量也能反映回归方程的拟合优度。

若回归方程的拟合优度高,F统计量越显著;

F统计量越显著;

回归方程的拟合优度越高。

F检验中,

H0

假设是,设各个系数

i

=0,即

各个自变量与因变量无线性关系。

F

Fa(k,n

k1)或

p

a(

显著性水平)

,则拒绝

原假设H0,认为所有回归系数同时与零有显著差异,自变量与因变量之间存在显著的线性

关系,自变量的变化确实能反映因变量的线性变化,回归方程显著。

若

FFa(k,n

k1)或p

,接受原假设

H0,认为所有回归系数同时与零

无显著差异,自变量和因变量之间不存在显著的线性关系,线性变化,回归方程不显著。

自变量的变化无法反映因变量的

回归系数的显著性检验是检验各个自变量

xk

对因变量y的影响是否显著,从而找出哪些

自变量对y的影响是重要的,哪些是不重要的。

H0假设为:

0,i1,2,...,k。

若零

假设成立,说明xk

对y没有显著影响,即

自变量与因变量的线性关系不明显,反之,

说明xk对因变量y具有显著的影响。

采用t检验。

若|t|ta

(n

k1)或者p<

a,拒绝

原假设H0,认为该回归系数与零有显著差异,该自变量与因变量之间存在显著的线性

关系,它的变化确实

能较好地反映因变量的线性变化,应该保留在回归方程中

。

|t|ta(nk1)或者p>

a,接受原假设

H0,认为该回归系数与零无显著差异,该自变

量与因变量之间不存在显著的线性关系,它的变化无法反映因变量的线性变化,应该剔除出回归方程中。

Analyze->

Regression->

LinearRegression,在Correlations表中,可以分析各个变量之间的相关系数。

相关系数越大,说明各变量越相关。

ModelSummary表中,分析R,Rsquare,利用该值看样本回归效果。

该值越大,说明样本数据和回归方程的拟合度越高。

即分析样本的回归效果。

Anova表,(方差分析表),利用统计量F和相伴概率Sig,同时分析多个自变量和因变量之间是否存在线性回归关系。

Coefficients回归系数表,利用t分布的Sig值分析全部自变量和因变量之间是否存

在显著线性关系。

ResidualsStatistics表,分析各个残差结果。

3.非线性回归分析

研究在非线性相关条件下,自变量对因变量的数量变化关系。

其中,多项式模型在非

线性回归分析中占据重要地位。

当因变量和自变量之间的关系未知时,可以用适当幂次的多项式近似反映。

(1)在Graphs菜单中的Correlate中选择Scatter命令,->

SimpleScatterplot,观察散点图,初步决定是哪些曲线比较合适。

(2)进一步判断筛选后的这些曲线中,

哪种与样本观察值的拟合优度更高。

利用

R2分析

各个曲线的拟合优度,该值越大,说明该值对应的曲线拟合优度更高。

曲线预测值的曲线图,观察各类型曲线的拟合效果。

最终,确定一种曲线方程。

最后,再观察几种

4.曲线估计

当不知道该选择哪种函数模型更接近样本数据时,采用曲线拟合。

方法:

先根据实际问题,同时选择多种模型。

(2)计算R2、F检验值、相伴概率Sig。

(3)选

择具有R2统计量值最大的模型作为此问题的回归模型,并作些预测。

CurveEstimation,观察CurveFit

表中的

R2值,分析比较后,选

择该值最大的曲线模型最合适。

再观察其观察值和各种函数模型条件下预测值的对比图,

分析各种曲线,看看哪种曲线对观测值的拟合优度更好。

然后,在输出的FIT_1(选取曲线

1时的预测结果值)、Err_1(曲线

限和上限。

别的曲线类似。

在

1下的残差)、LCL_1UCL_1为预测值95%的可信区间的下

DisplayANOVA表中,做回归方程的显著性检验,观察t分

布下对用的Sig值。

若Sig<

0.05,说明显著相关。

5时间序列的曲线估计

时间序列曲线估计是分析社会和经济现象中常用的一种曲线估计。

通常把时间设为自

变量,代表具体的经济或社会现象的变量设为因变量。

CurveEstimation,将应变量Y选入Dependent中,其他选入

Independent中,同时选中Time项。

再选中多种曲线模型,分析CurveFit表中的R2,取得R2值最大的曲线(说明该曲线

的拟合优度最好)。

同时,得到FIT_1,FIT_2等值(不同曲线函数对应的回归分析结果的预测值)。

再输出曲线预测值的对比图。

6.含虚拟自变量的回归分析

对于非数量型变量,如性别、季节等,回归模型的参数不再是固定不变的。

计算时,先

对定性变量做数量化处理,如1-男,0-女。

举例1,对于自变量只有一个定性变量,且定

性变量只有两种特征时,回归模型y01x12D;

自变量中含有多个定性变量

时,同时考虑定性变量及其之间的交互影响。

y

1D1

2D2

3D1D2

4x1

5x2

Linear,

y选入

Dependent

中,其它选入

Independent

中,在

Model

Summary

中,观察

R2值,该值越大,说明样本回归方程代表性越强。

ANOVA

表中,

观察F值和Sig值。

若Sig<

0.05,说明自变量和因变量有线性回归关系。

表,观察t分布的相伴系数Sig。

.若Sig值<

0.05,说明回归系数和

最后,观察Coefficients

0有明显差别,回归方程

有意义。

7.逻辑回归分析

实际情况中,因变量是定性变量时。

如:

某人是否购买汽车。

处理定性因变量的方法

有判别分析、Probit分析,Logistics分析、对数分析。

其中,Logistics分析是最多应用的。

模型参数估计后,进行检验的统计量

(1)-2对数似然值(-2loglikelihood,-2LL),用于检验Logistics回归中的显著性,反

映了在模型中包括了所有自变量后的误差,用于处理因变量无法解释的变动部分

的显著性水平。

当-2LL的实际显著性水平大于给定显著性水平a时,因变量

的变动中无法解释的部分是不显著的,意味着回归方程的拟合程度是最好的。

(2)拟合优度(GoodnessofFit)统计量,反映拟合效果。

(3)Cox&

SnellR-Square。

它是在似然值基础上模拟线性回归模型的R2解释LOGISTIC回归模型,一般小于1.该值越趋于1,回归效果越好。

(4)NagelkerkeR-Square,它与R2接近,但小于1.

(5)HosmerandLemeshow’sGoodnessofFitTestStatistic拟合优度检验统计量。

根据卡方分布,计算Sig值,若p<

a(显著性水平),拒绝因变量的观测值和模型观测值不

存在差异的零假设,表明模型的预测值和观测值存在显著差异。

若p>

a,接受零

假设,说明在可接受的水平上的估计拟合了数据。

(6)Wald统计量:

用于判别一个变量是否应该包含着模型中。

Wald统计量大者(或

Sig值小)显著性高,也就更重要。

因此,Wald可以考察每个自变量在回归方程

中的重要性。

Analyze-regression->

BinaryLogistics,

IterationHistory

表中,得到-

2LL

的数值。

在ClassificationTable中,可以得出定性因变量的分类的准确性百分比;

在Model

Summary中,列出了-2LL,COX&

SnellRsquare和NagelkerkeRSquare统计结果。

HosmerandLemeshowTest表中,若Sig>

0.05,说明在可接受的水平上的估计拟合了

数据。

Iteration

History

表格中,列出各个步骤的回归结果系数;

ClassitionTable中,可以

分析定性应变量的准确性。

在VariablesintheEquation中,可以看出Wald数据和Sig.Wald数据值越大,说明该自变量在回归方程中越重要。

CorrelationMatrix

在CasewiseList

表格中,列出各个系数和常数的相关性。

数值越大,也就越相关。

中,列出残差较大的个案,标记**,说明该个案的回归结果错误。

专题二相关分析

衡量事物之间、变量之间线性相关程度的强弱并用适当的统计指标表示,即为相关分析。

常用方法为绘制散点图(该方法不精确)

准确描述变量之间的线性相关程度-相关系数。

样本相关系数r取值范围在[1,1]

其中,

(1)若0r1,表明变量之间存在正相关关系,即两个变量的相随变动方向相同。

(2)若1r0,表明变量之间存在负相关关系,即两个变量的相随变动方向相反。

(3)若|r|1,完全相关;

|r|0,完全不相关,说明变量间无线性关系。

(4)|r|

0.8,高度相关;

0.5|r|0.8,中度相关;

0.3|r|

0.5,低度相关;

|r|

0.3,说明变量之间的相关程度极弱,可视为不相关。

为了判断样本相关系数是否能代表总体相关程度,需要对相关系数做假设检验。

(1)假设总体相关性为0,即H0为两总体无显著线性相关关系;

(2)其次,计算相应的统计量,得到对应的相伴概率值Sig。

若Sig小于等于指定的

显著性水平,则拒绝H0,认为两总体存在显著线性相关关系;

若Sig值大于指定的显著性水平,则不能拒绝H0,认为两总体不存在显著的线性相关关系。

2.1二元定距变量的相关分析

Pearson简单相关系数恒定定距变量的线性关系,其统计量是t统计量,服从n-2个自由

度的t分布。

Correlate->

Bivariate,选中双侧检验(Two-tailed),可以检验两个变量之间的

相关取向(正相关/负相关)。

在Correlations中,检查r值以及对应的Sig值。

如果Sig0.01,

说明两变量间显著相关。

若对变量间的相关程度不需要掌握的太精确,可以通过绘制变量的相关散点图直接判

断。

Graphs->

Scatter->

Simple,观察散点图,看看是否存在线性相关。

2.2二元定序变量的相关分析

定序变量又称顺序变量,它的取值大小能够表示观测对象的某种顺序。

Spearman和

Kendall’stua-b等级相关系数用以衡量定序变量之间的线性相关关系。

在Spearman等级相关系数的统计检验中,若个案数n30直接利用Spearman计算(查

Spearman等级相关统计量表,SPSS自动根据该表给出Sig),若个案数>

30,将计算Z统计量(Z近似服从正态分布),SPSS将给出正态分布表对应的相伴概率。

在Kendall’stua-b等级相关系数的统计检验,若个案数n30直接利用Spearman计

算(查Kendall’stua-b等级相关统计量表,SPSS自动根据该表给出Sig),若个案数>

30,将计

算Z统计量(Z近似服从正态分布),SPSS将给出正态分布表对应的相伴概率。

Bivariate,对于得到的NonparametricCorrelations表,观察相关系

数和Sig.若如果Sig0.01,说明两变量间显著相关。

2.3偏相关分析

单纯计算简单相关系数,无法准确反映事物之间的相关关系,而应该在剔除其他相关因素影响下计算相关系数。

偏相关分析即解决该问题。

偏相关分析-当两个变量同时和第三个变量相关时,将第三个变量的影响剔除,只分析

另外两个变量之间的相关程度的过程。

即计算偏相关系数。

Partial->

PartialCorrelations,将需要剔除的变量选入Controlling

For对话框中。

选择Two-tailed检验。

在输出的PartialCorr表中,将显示变量两两之间的

Pearson简单相关系数,然后显示便相关分析结果,包括去除剔除了变量后的二变量的偏

相关系数,Sig。

对于有多个相关变量时,简单相关系数有夸大的成分,而偏相关系数更符合实际。

如果

Sig

0.01

,说明两变量间显著相关。

2.4距离相关分析

距离相关分析是对观测量之间或变量之间相似或不相似程度的一种预测。

根据统计量不同分为不相似性测量(通过计算样本间的距离或变量间的距离)

测度(通过Pearson相关系数或Cosine相关表示)。

根据分析对象不同,分为样本间分析(样本与样本之间的距离相反分析)

、相似性

、变量间分析

(变量和变量之间的距离相反分析)。

(1)变量之间的相似性测量分析

Distances,可以选择变量之间的距离相关分析(Betweenvariable),

Measure栏中选择Similarities相似性测距,点击Measure⋯按钮,在弹出的

Distance:

SimliarityMeasure,再确定Interval(定距变量),选择Pearsoncorrelation项。

在Proximities表中,即ProximityMatrix表中,可以看到各个变量之间的相关系数

(Perason相关系数)

(2)变量之间的不相似性测量分析

correlate->

distance,Measure中选择Dissimilarities,单击Measure按钮,选Interval,并选择Euclideandistance项,不对变量做标准化处理。

在ProximityMatrix表中,看到EuclideanDistance距离值越大,说明变量间的相似性越

小。

(2)个案之间的相似性测量分析

correlate->

distance,选择betweencases,(做个案之间的距离相关分析),选择Simliarities,做相似性测量。

Measure中选择Interval中的Pearsoncorrelation。

在ProximityMatrix表中,看到Perason系数值,值越大,说明变量间的相似性越大。

(3)个案之间的不相似性测量分析

distance,选择betweencases,(做个案之间的距离相关分析),选择Dissimliarities,做相似性测量。

Measure中选择Interval中的Pearsoncorrelation.

在ProximityMatrix表中,看到EuclideanDistance距离,距离越小,说明变量间的相似性越大。

专题3方差分析

方差分析是用于两个以及两个以上样本均数差别的显著性检验。

方差分析的基本思想

是:

通过分析研究中不同变量的变异对总变异的贡献大小,确定控制变量对研究结果影响

力的大小。

通过方差分析,分析不同水平得控制变量是否对结果产生了显著影响。

如果控制

变量的不同水平对结果产生了显著影响,那么它和随机变量共同作用,必然使得结果有显著

变化;

如果控制变量的不同水平对结果没有显著的影响,那么结果的变化主要是由随机变量

起作用,和控制变量的关系不大。

根据控制变量的个数,可以将方差分析分为单因素方差分

析(只有一个控制变量)和多因素方差分析(多个控制变量)。

3.1单因素方差分析

单因素方差分析测试某个控制变量的不同水平是否给观察变量造成了显著差异。

对于

两组以上的均数比较,必须使用方差分析(当然方差分析也可以用于两组均数比较。

方差分析一个严格的前提条件:

在不同水平下,各总体均值服从方差相同的正态分布。

计算采用F统计量,进行F检验。

若控制变量的不同水平对观察变量有显著影响,那

么观察变量的组间离差平法和必然大,F值也就比较大;

若控制变量的不同水平没有对观察

变量造成显著影响,则组内离差平方和影响会比较大,F值比较小。

SPSS依据F分布表给

出相应的相伴概率值Sig。

a(显著性水平),就拒绝零假设,认为控制变量再不同水平

下各总体均值有显著差异;

反之认为无显著差异。

《判别准则》

CompareMeans->

One-wayAnova,

option

中利用

Homogeneityofvariance

test做方差相等检验。

若Sig小于或等于显著性水平a,拒绝零假设,认为各水平下总体

方差不等。

若Sig大于显著性水平a,接受零假设,认为各水平下总体方差相等。

该步骤仅

能判别出控制变量的不同水平是否对观察变量差生了显著影响。

若想进一步了解究竟是那

一组和其他组有显著的均值差别,需要在多个样本均数间两两比较。

(方差分析的前提是各个水平下的总体服从方差相等的正态分布,其中正态分布的要求不是

很严格,但是对于方差相等的要求比较严格