财务知识北京大学经济学院极大似然估计Word格式文档下载.docx

《财务知识北京大学经济学院极大似然估计Word格式文档下载.docx》由会员分享,可在线阅读,更多相关《财务知识北京大学经济学院极大似然估计Word格式文档下载.docx(8页珍藏版)》请在冰豆网上搜索。

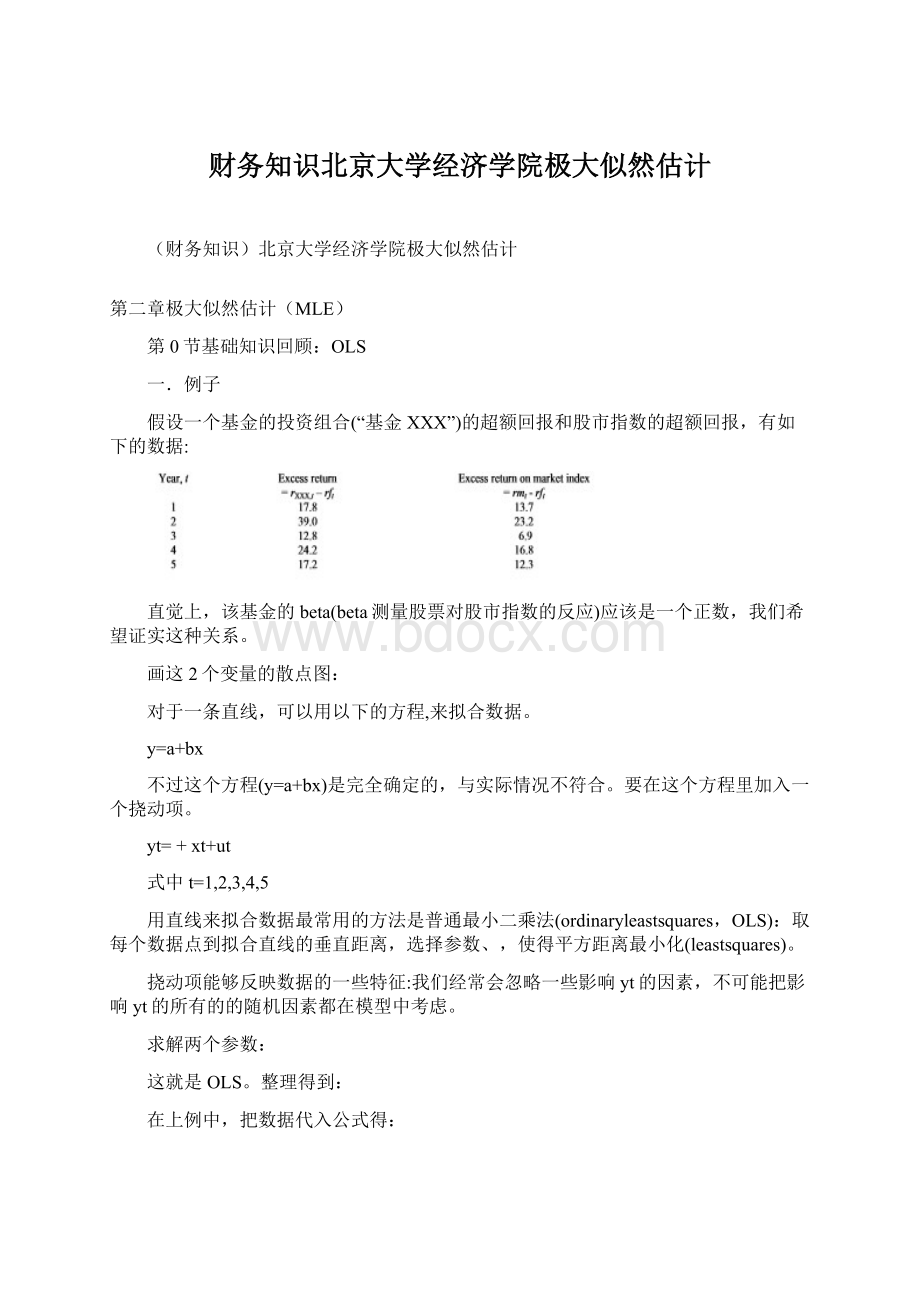

求解两个参数:

这就是OLS。

整理得到:

在上例中,把数据代入公式得:

根据这个结果,如果预期下一年的市场回报将会比无风险回报高20%,那么你预期基金XXX的回报将会是多少?

二.概念:

线性和非线性

运用OLS,要求模型对参数(和)是线性的。

“对参数线性”意味着参数之间不能乘、除、平方或n次方等。

在实际中变量之间的关系很有可能不是线性的。

某些非线性的模型可以通过变换转化为线性模型,例如指数回归模型:

令yt=lnYt及xt=lnXt

但是,很多模型从本质上讲是非线性的,例如:

三.OLS的优良性质

在OLS回归模型中,对ut(不可观测的误差项作如下假设)作如下架设:

解释

1.E(ut)=0误差项的均值为零

2.Var(ut)=2误差项的方差是常数

3.Cov(ui,uj)=0误差项相互独立的

4.Cov(ut,xt)=0误差项和解释变量不相关

以上假设成立时,OLS有如下三个良好性质。

一致性

最小二乘估计是一致的。

这意味着,当样本数趋向于无穷大时,估计值将收敛于它们的真实值(需要假设E(xtut)=0和Var(ut)=2<

)

无偏性

最小二乘估计式是无偏的,意味着估计值的期望等于真实值.

E()=andE()=

为了保持无偏性需要假设E(ut)=0和Cov(ui,uj)=0。

无偏性比一致性更强。

有效性

在所有的线性无偏的估计式中,OLS估计式的方差是最小的,即OLS估计的参数与真实值出现大的偏差的概率最小。

四.统计推断

用标准误差来度量参数估计值的可靠程度。

在假设1-4成立的条件下,估计值的标准误差可以写成

其中s是残差的标准误差。

假设utN(0,2),则OLS统计量服从正态分布:

N(,Var())

如果挠动项不服从正态分布,最小二乘的估计式还是正态分布吗?

样本数足够大时,答案是:

是的。

从估计式和构造标准正态分布:

但是,由于不知道var()和var(),我们用下面的分布加以替代。

t分布和标准正态分布之很相似。

这2种分布都是对称的,并且均值都为零。

t分布多了一个参数:

自由度(样本总观测数-2)。

当一个t分布的自由度是无穷大时,它等于标准正态分布。

用置信区间进行假设检验

在显著性检验中,下面的情况下接受零假设H0:

=*,即统计量落在非拒绝域内,

如果我们能够以5%(或者10%)的置信水平拒绝某个检验的零假设,则称这个检验在统计上是显著的.

在这个过程中,我们可能会犯2种错误:

1.当H0是正确的时候,我们拒绝了它,第一类错误.

2.当H0是错误的时候,我们没有拒绝它,第二类错误.

犯第一类错误的概率是.回忆显著性水平的含义:

当零假设是真的情况下,统计量落在拒绝域内的概率只有。

但第二类错误的概率常常不能确定。

一般而言,当我们降低第一类错误概率的同时也提高了第二类错误的概率。

第一节引言

考虑ARMA模型:

(1)

其中。

前面我们假定知道总体参数,此时利用过程

(1)进行预测。

本章我们要研究在仅能观测到序列的情况下,如何估计。

估计方法为极大似然估计。

令表示总体参数向量。

假定我们观察到一个样本量为的样本。

写出样本的联合概率密度函数:

(2)

这是观察到样本发生的概率。

使得“概率”最大的值就是最优估计——这就是极大似然估计的思想。

极大似然估计需要设定白噪声的分布。

常常假定是高斯白噪声,则得到的函数为高斯似然函数。

极大似然估计的步骤:

1)写出似然函数

(2)。

2)利用求极大值方法求使得函数值最大的值。

第2节高斯过程的似然函数

一.计算高斯过程似然函数

高斯过程的表达式为

(3)

参数为。

观察值的均值和方差分别为和。

因为,因此也是高斯分布。

其概率密度函数为

(4)

对于第二个观察值在观察到条件下的分布。

根据(3),

(5)

此时,其概率密度函数为

(6)

观察值和的联合密度函数就是(4)和(6)的乘积:

(7)

同样

(8)

(9)

一般地,

(10)

则前个观察值的联合密度为

(11)

全部样本似然函数为

(12)

进行对数变换,得到对数似然函数:

(13)

将(4)和(10)代入(13),得到

(14)

二.似然函数的矩阵表示

观察值写成向量形式为:

(15)

可以看作是为高斯分布的单个实现。

其均值为

(16)

这里。

表示成向量形式为:

其中表示(16)的右边的向量。

的方差协方差矩阵为:

(17)

其中

(18)

该矩阵中的元素对应于的自协方差。

将样本看作由分布的一个抽样,似然值可根据多元高斯密度公式直接写成:

其对数似然值为:

这本质上和(14)是相同的。

理论上,对方程(14)求导并令导数为零,就可得到参数向量。

而在实践当中,往往得到的是的非线性方程。

此时求解需要格点(grid)搜索等数值优化方法。

四.条件极大似然()函数

如果将的值看作确定性的,然后最大化以第一个值为条件的似然值,这种方法称为条件极大似然函数。

此时最大化目标为:

等价于最小化:

这与回归的结果一样。

已知参数估计值,下一步关于求导数

得到

这也是OLS估计下的残差方差。

条件极大似然估计的特点:

1.易于计算。

2.样本量足够大,则第一个观测值的影响可以忽略。

第三节高斯ARMA过程的条件似然函数

一.条件似然函数

参数向量为。

以前个观察值为条件的对数似然函数为:

求使得最大化问题转变为最小化:

非高斯时间序列的极大似然估计(拟极大似然估计)

1.如果残差过程非高斯的,使用高斯对数似然函数得到的估计为总体参数的一致估计。

2.拟极大似然估计得到的系数的标准差不正确。

二.条件似然函数

对于高斯过程

表示要估计的总体参数。

如果已知,则

其概率密度函数为:

如果已知,则:

给定观察值,则就是确定的:

于是

已知的话,可由下式求出:

通过迭代法由求出整个序列:

样本条件对数似然函数为

三.高斯过程的条件似然函数

对于过程

假设前项的全为零:

令表示向量。

条件对数似然函数为:

四.的条件似然函数

自回归过程的似然函数的近似以的初始值为条件,移动平均过程似然函数的近似以的初始值为条件。

过程以和的初始值为条件。

假设初始值和给定,则利用实现,迭代得到:

可得的序列。

则条件似然函数为:

五,选择模型的标准

1)AIC准则(Akaike信息标准)

2)BIC准则

3)HQ准则

第四节极大似然估计的统计推断

一.极大似然估计参数的标准差

如果样本量足够大,则极大似然估计近似表示为:

其中代表真实参数向量。

矩阵称为信息矩阵,其估计值为:

其中为对数似然函数。

二.似然比(LR)检验

假设原假设:

参数向量中存在个限制(例如某些系数等于零)。

分别求出无限制极大似然估计、限制情况下的极大似然估计。

明显L()>

L(),检验统计量为:

2[L()-L()]

利用显著性检验法和置信区间法可以对原假设进行检验。

标准差检验(Wald检验)需要计算无限制极大似然估计。

似然比检验既要计算有限制极大似然估计量,又要计算无限制极大似然估计量。

感谢阅读