计量经济学 全套讲义..doc

《计量经济学 全套讲义..doc》由会员分享,可在线阅读,更多相关《计量经济学 全套讲义..doc(175页珍藏版)》请在冰豆网上搜索。

浙江工商大学金融学院姚耀军讲义系列

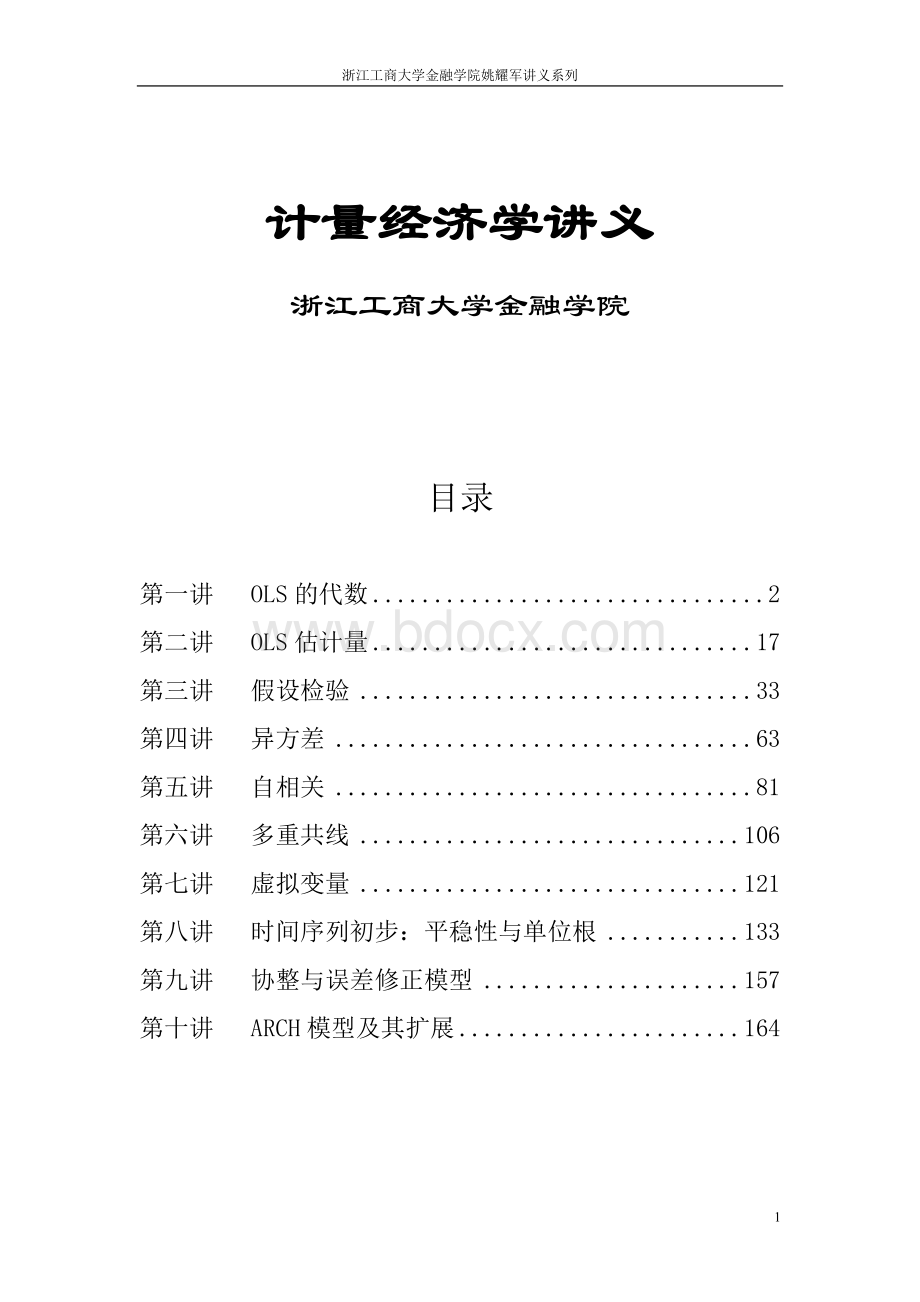

计量经济学讲义

浙江工商大学金融学院

目录

第一讲OLS的代数 2

第二讲OLS估计量 17

第三讲假设检验 33

第四讲异方差 63

第五讲自相关 81

第六讲多重共线 106

第七讲虚拟变量 121

第八讲时间序列初步:

平稳性与单位根 133

第九讲协整与误差修正模型 157

第十讲ARCH模型及其扩展 164

第一讲OLS的代数

一、问题

假定y与x具有近似的线性关系:

,其中是随机误差项。

我们对这两个参数的值一无所知。

我们的任务是利用样本去猜测的取值。

现在,我们手中就有一个样本容量为N的样本,其观测值是:

。

问题是,如何利用该样本来猜测的取值?

一个简单的办法是,对这些观察值描图,获得一个横轴x,纵轴y的散点图。

既然y与x具有近似的线性关系,那么我们就在散点图中拟合一条直线:

。

该直线是对y与x的真实关系的近似,而分别是对的猜测(估计)。

问题是,如何确定与,以使我们的猜测看起来是合理的呢?

二、OLS的两种思考方法

法一:

与是N维空间的两点,与的选择应该是这两点的距离最短。

这可以归结为求解一个数学问题:

在这里定义了残差。

法二:

给定,看起来与越近越好(最近距离是0)。

然而,当你选择拟合直线使得与是相当近的时候,与的距离也许变远了,因此,存在一个权衡。

一种简单的权衡方式是,给定,拟合直线的选择应该使与、与、...、与的距离的平均值是最小的。

距离是一个绝对值,数学处理较为麻烦,因此,我们把第二种思考方法转化求解数学问题:

由于N为常数,因此上述两个数学问题对于求解与的值是无差异的。

三、求解

定义,利用一阶条件,有:

方程

(1)与

(2)被称为正规方程。

由

(1),有:

把带入

(2),有:

关于正规方程的直觉:

无论用何种估计方法,我们都希望残差所包含的信息价值很小,如果残差还含有大量的信息价值,那么该估计方法是需要改进的!

对模型利用OLS,至少我们能保证

(1):

残差均值为零;

(2)残差与解释变量x不相关【一个变量与另一个变量相关是一个重要的信息】。

练习:

(1)利用离差之和为零的代数性质,验证:

补充:

定义y与x的样本协方差为:

;x的样本方差为,则

我们用表示总体协方差,表示总体方差。

上述定义的样本协方差及其样本方差分别是对总体协方差及其总体方差的一个有偏估计;及其

才分别是对总体协方差及其总体方差的一个无偏估计。

(2)假定,用OLS法拟合一个过原点的直线:

,求证在OLS法下有:

并验证:

笔记:

①现在只有一个正规方程,该正规方程同样表明。

②无截距回归公式的一个应用

假定y与x真实的关系是:

对(3),按照无截距回归公式,有:

(3)假定,用OLS法拟合一水平直线,即:

,求证。

四、一些基本的性质

对于简单线性回归模型:

,在OLS法下,存在如下代数性质:

(一)拟合直线过点,。

(二)由正规方程

(1)可知,残差之和为零。

注释:

只有拟合直线带有截距时才存在正规方程

(1)。

(三)由正规方程

(2)可知,残差与x的样本协方差为零,即残差与x样本不相关。

【注意:

该性质的获得也利用了性质

(二)】。

练习:

证明残差与也是样本不相关的。

(四)定义

其中TSS、ESS、RSS分别被称为总平方和、解释平方和与残差平方和。

则:

TSS=ESS+RSS。

证明:

练习:

(1)基于前述对Var(x)、Cov(x,y)的定义,验证:

其中a,b是常数本讲义一般利用Var(x)及其Cov(x,y)表示样本方差和协方差,但有时为表述方便,也用它们来表示总体方差和协方差。

但无论如何,此处的公式在两种情况下都是可用的。

。

(2)对于简单线性回归模型:

,在OLS法下,证明

提示:

(五)为了判断拟合直线对观测值的拟合程度,我们定义判定系数。

显然,,而意味着各残差都为零,即拟合直线与样本数据完全拟合。

R2也是与的样本相关系数r的平方。

证明:

练习:

(1)对于简单线性回归模型:

,在OLS法下,证明R2是y与x的样本相关系数的平方。

(2)对于模型:

,在OLS法下,证明R2=0。

一个警告!

软件包通常是利用公式,其中来计算R2。

应该注意到,我们在得到结论

时利用了的性质,而该性质只有在拟合直线带有截距时才成立,因此,如果拟合直线无截距,则上述结论并不一定成立,因此,此时我们不能保证R2为一非负值。

总而言之,在利用R2时,我们的模型一定要带有截距。

当然,还有一个前提是,我们所采用的估计方法是OLS。

五、R2、调整的R2、自由度

我们估计总体均值至少需要一个观测值,估计总体方差至少需要两个观测值,进而推之,需要估计的参数越多,那么对样本容量的要求越高。

如果在模型中增加解释变量,那么总的平方和不变,但残差平方和至少不会增加,一般是减少的。

为什么呢?

举一个例子。

假如我们用OLS法得到的模型估计结果是:

,此时,OLS法估计等价于求解最小化问题:

令最后所获得的目标函数值(也就是残差平方和)为RSS1。

现在考虑对该优化问题再施加约束:

并求解,则得到目标函数值RSS2。

比较上述两种情况,RSS1是全局最小而RSS2是局部最小。

因此,RSS1小于或等于RSS2。

应该注意到,原优化问题施加约束后对应于模型估计结果:

因此,如果单纯依据R2标准,我们应该增加解释变量以使模型拟合得更好。

增加解释变量将增加待估计的参数,在样本容量有限的情况下,这并不一定是明智之举。

这涉及到自由度问题。

什么叫自由度?

假设变量x可以自由地取N个值,那么x的自由度就是N,然而,如果施加一个约束,,a为常数,那么x的自由度就减少了,新的自由度就是N-1。

如果利用公式来估计总体方差,我们将得到的是一个有偏的估计【什么叫有偏?

?

如果我们无限次重复抽取样本容量为N的样本,针对每一个样本都可以计算一个方差的估计值。

然后,对这些方差的估计值计算平均值,如果该平均值不等于总体真实方差,那么我们所采取的估计法则是有偏的】。

而利用公式,我们将得到一个无偏的估计。

事实上,在计算样本方差时,自由度是N-1而不是N。

为什么?

这是因为存在一个约束:

【换个思路看,是因为在计算样本方差时我们先必须利用公式计算样本均值,这实际上是一个约束条件】。

再考虑残差的自由度。

对残差有多少约束?

根据正规方程

(1)

(2),有:

,因此存在两个约束。

故残差的自由度是N-2。

思考:

利用OLS,当拟合函数(样本回归函数)是:

时,残差的自由度为多少?

R2忽视了自由度问题。

我们已知道在这里与都是有偏估计,现在,我们对自由度作调整,重新定义一个指标,即所谓的调整的R2():

应该注意到,如果是针对多元线性回归模型,待估计的斜率参数有k个,也含有1个截距(即总的待估计系数参数的个数为k+1个),那么上述公式就是:

小于R2,且存在是负数的情况。

思考:

如果用增加解释变量的方法来提高R2,这一定会提高吗?

笔记:

我们已经知道,增加解释变量一般是增加R2(至少不会减少),但将减少自由度。

直观来看,自由度过少有什么问题呢?

举一个例子:

对简单线性回归模型,假定我们只有两次观测,显然,我们可以保证R2=1,即完全拟合。

但我们得到的这个拟合直线很可能与y与x的真实关系相去甚远,毕竟我们只有两次观测【与抛硬币的例子类比吧,为了说明硬币两面质量均匀,抛一两次硬币能够充分说明问题吗?

】。

事实上,此时自由度为0!

六、简单线性回归模型拓展到多元线性回归模型

考虑,各系数的估计按照OLS是求解数学问题:

因此,存在三个正规方程:

第一个方程意味着残差之和为零,也意味着及其

第二个方程意味着残差与x样本不相关;

第三个方程意味着残差与z样本不相关。

如果样本回归函数是呢?

你应该能够推广相关性质!

七、OLS的矩阵代数

(一)矩阵表示

总体多元回归模型是:

如果用矩阵来描述,首先定义下列向量与矩阵:

模型的矩阵表示:

(二)如何得到OLS估计量?

求解一个最小化问题:

,有:

而根据矩阵微分的知识(见文本框),有:

故,,则

矩阵微分

与都是标量。

重要的规则:

一个标量关于一个列向量的导数仍是列向量,并且维数保持不变。

注意,为了保证的存在,OLS具有一个假设:

X列满秩,即不存在完全共线性。

关于矩阵的秩

是矩阵,为了保证的存在,那么,基于矩阵知识点:

,因此这也要求。

是矩阵,因此X列满秩。

考虑简单线性回归模型的矩阵表示:

X列满秩意味着,其中为常数,这也意味着:

【你能证明吗?

?

】,注意到,而正是我们所要求的!

思考:

对于模型,如果我们只有2个观测值,我们能够得到吗?

第二讲OLS估计量

一、估计量与估计值

对总体参数的一种估计法则就是估计量。

例如,为了估计总体均值为u,我们可以抽取一个容量为N的样本,令Yi为第i次观测值,则u的一个很自然的估计量就是。

A、B两同学都利用了这种估计方法,但手中所掌握的样本分别是与。

A、B两同学分别计算出估计值与。

因此,在上例中,估计量

是随机的,而是该随机变量可能的取值。

估计量所服从的分布称为抽样分布。

如果真实模型是:

,其中是待估计的参数,而相应的OLS估计量就是:

我们现在的任务就是,基于一些重要的假定,来考察上述OLS估计量所具有的一些性质。

二、高斯-马尔科夫假定与高斯-马尔科夫定理

●假定一:

真实模型是:

。

有三种情况属于对该假定的违背:

(1)遗漏了相关的解释变量或者增加了无关的解释变量;

(2)y与x间的关系是非线性的;(3)并不是常数。

●假定二:

在重复抽样中,被预先固定下来,即是非随机的(进一步的阐释见附录),显然,如果解释变量含有随机的测量误差,那么该假定被违背。

还存其他的违背该假定的情况。

※假定三:

误差项期望值为0,即。

※假定四:

,即所谓的同方差假定。

※假定五:

,即所谓的序列不相关假定。

●假定六:

,在多元回归中,该假定演变为的逆存在,即各解释变量不完全共线。

笔记:

※都是关于误差项的假定,如果模型:

确实是恰当的,那么误差项应该不含有还可以利用的信息价值。

如果误差项是序列相关的,显然这表明误差项还含有可以利用的信息价值。

另外,由于假定是非随机的,所以误差项与任意xi都是不相关的。

OLS估计量作为一种线性估计量,在高斯-马尔科夫假定下,我们将证明它具有良好的统计性质。

所谓OLS估计量是线性估计量,是指它能够被表示为的线性函数。

例如,。

注意,在假定二下,ki是非随机的。

练习:

把表示成的线性函数

(一)无偏性

而;;在重要假定三:

下,

练习:

证明

(二)最小方差性——在的所有线性无偏估计量中,OLS估计量具有最小的方差。

1、关于方差

在重要假定五:

及其重要假定四:

下,,

而

因此,

练习:

证明在高斯-马尔科夫假定下:

练习:

在重要假定四与五下证明:

练习:

证明在高斯-马尔科夫假定下:

练习:

证明在高斯-马尔科夫假定下:

2、把任意一种线性估计量表示为,当时,该估计量即为的OLS估计量。

在所有无偏的的线性估计量中,OLS估计量具有最小的方差。

首先强调一个前提,即“在所有无偏的的线性估计量中”。

现在我们的任务是,在给定前提下(约束条件),证明OL