深度学习文字识别论文综述Word下载.docx

《深度学习文字识别论文综述Word下载.docx》由会员分享,可在线阅读,更多相关《深度学习文字识别论文综述Word下载.docx(13页珍藏版)》请在冰豆网上搜索。

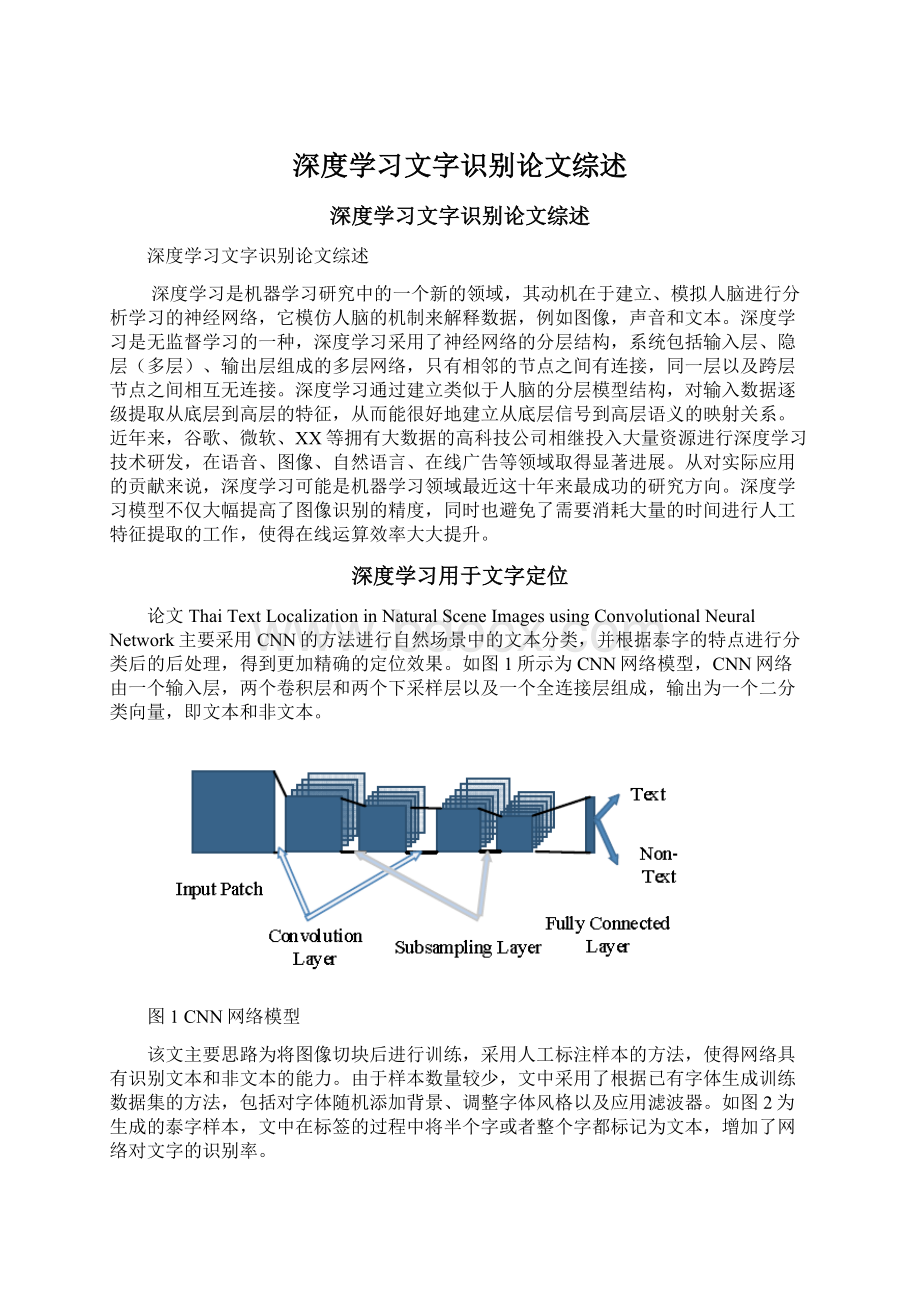

如图1所示为CNN网络模型,CNN网络由一个输入层,两个卷积层和两个下采样层以及一个全连接层组成,输出为一个二分类向量,即文本和非文本。

图1CNN网络模型

该文主要思路为将图像切块后进行训练,采用人工标注样本的方法,使得网络具有识别文本和非文本的能力。

由于样本数量较少,文中采用了根据已有字体生成训练数据集的方法,包括对字体随机添加背景、调整字体风格以及应用滤波器。

如图2为生成的泰字样本,文中在标签的过程中将半个字或者整个字都标记为文本,增加了网络对文字的识别率。

图2训练样本集

在使用生成好的网络进行文字定位的过程中,论文采用的编组方法结合了泰字的特点,如图3为对图像文字的初步定位,其中被标记的区域被网络识别为文字。

图3图像文字的初步定位

论文后期对标记的矩形小框区域进行了整合,结合了泰字本身的特点,如图图4所示为原始图像文字,图5为对识别结果进行的后处理,其中a,b,c将文字分为上、中、下三个部分。

文中指出泰字一般的最高不超过中心线b的50%,采用这个规律进行了文字编组,得到如图6的编组结果,其中白色区域为编组结果。

图4原始文本图像

图5后处理结果

图6编组结果

同时论文也考虑了泰字的其他特点,如中心线与上边界和下边界的夹角不超过45度,根据这个规律又对编组结果进行调整。

如图7所示,当超过夹角限制是进行了微调。

如图8与图9为论文的最终定位结果。

图7泰字编组调整

图8定位结果

图9定位结果

论文ReadingNumbersinNaturalSceneImageswithConvolutionalNeuralNetworks结合隐马尔可夫模型

(HiddenMarkovModel,HMM)和深度学习方法来实现对自然场景中的数字进行定位和识别。

首先采用CNN方法对原始的数字图像进行特征提取,将提取的结果输入至HMM模型进而得到数字的识别结果。

如图10为论文提出的识别方法模型。

图10文字识别模型

论文为了实现直接在原始的图像上进行识别,采用了动态窗口滑动的方法,提取一系列的图像块。

如图11为论文采用的CNN结构,包括4个卷积层,其中3个卷积层都有相邻的下采样层,每个卷积层都包含一个本地归一化,共2个全连接层。

网络的训练首先通过滑动窗口提取图像的骨架,然后采用主成分分析PCA方法进行降维,然后将得到的主要特征作为GMM-HMM模型的输入,采用Viterbi译码对GMM-HMM的输出进行处理,最后采用CNN对生成的数据进行训练,数据的标签自动生成不需要人工参与。

图11CNN网络结构模型

论文首先采用CNN对数字进行分类,其中分类数为11即数字0,1,2,3,4,5,6,7,8,9,以及标签10代表非数字,论文采用HMM模型对分类的结果进行可能性分析,如图12为HMM模型结构图。

图12HMM模型结构图

图13为论文的识别结果图,与其他方法不同的是,论文直接在原始图像实现了多个数字的识别,由于场景的复杂性和字符的多样性,存在部分的错误。

论文得到的单个数字准确率最高为91.4%。

图13实验结果图

论文ARobustHierarchicalDetectionMethodforSceneTextBasedonConvolutionalNeuralNetworks提出了一种结合卷积神经网络和随机森林统计算法对字符进行编组的算法。

该论文的主要创新点为利用了卷积神经网络对字符进行二分类,根据随机森林分类文本行特征以及文本行的一致性属性对文本进行编组实现。

如图14为论文提出的方法框架。

图14论文方法实现框架

CNN网络的输入为输入图像的部分区域,CNN网络输出文本行信息作为随机森林分类器的输入,进而实现不同文本不同尺度的文字编组。

在CNN网络基础上,论文增加了候选字符的笔画特征,对于不同语言的文本是普适的。

该方法的一个依据在于统一的文本基本具有统一的笔画宽度,实质上就是对于每个可能属于文字部分的像素点和它最有可能所属的笔画建立联系,如果他们属于同一笔画,进一步形成了文字区域。

由于自然场景中存在干扰,如电线杆、线化背景和区域干扰等,通过设置阈值控制区域笔画的宽度,将不符合要求的剔除掉,同时单独的字符通常不出现在图像中,也被剔除掉。

如图15为论文实现的部分结果,从左到右依次为输入图像、字符特征提取、字符区域扩展和文本行编组结果。

图15算法实现部分结果

如图16为论文的实现结果,从图中可以看到,在复杂的自然场景中,论文提出的方法获得了较为理想的效果,论文的算法在ICDAR数据集上的优势也较为明显,该方法主要的创新为利用了随机森林和字符的笔画特征对CNN分类结果进行了编组,充分利用了CNN的特征提取和字符的笔画特征和文本行的属性特征。

图16论文结果

深度学习用于文字识别

论文HandwrittenDigitsRecognitionBaseonImprovedLeNet5主要采用CNN和SVM结合的方法实现手写字符识别,在LeNet5卷积神经网络的基础上,将最后的输出层和卷积层用SVM替换。

主要思想为,采用CNN来提取特征向量,然后利用SVM对特征向量进行分类。

论文中还采用了最优化算法中的Levenberg-Marquardt算法来加速CNN的训练过程,改进的LeNet5网络如下图17所示。

LeNet5共有七个网络层:

三个卷积层,两个下采样层,一个全连接层和一个输出层,输入图像大小为32x32,卷积核心大小为5。

图17改进的LeNet5网络结构

论文中指出,采用单一的SVM方法对MNIST手写数据库进行测试,错误率为1.4%,采用单一的CNN对MNIST数据库进行测试,错误率为0.95%,结合两种方法,即改进的LeNet5错误率为0.85%,如图18所示。

图18改进的LeNet5算法识别结果

论文对网络的迭代次数进行了分析,随着迭代次数的增加,网络的错误率逐渐下降,如图19所示。

这与Caffe平台的下的MNIST训练结果基本一致。

图19迭代次数与错误率变化图

论文AVeryHighAccuracyHandwrittenCharacterRecognitionSystemforFarsiArabicDigitsUsingConvolutionalNeuralNetworks采用的卷积神经网络来对手写阿拉伯数字进行识别,采用的卷积神经网络与MNIST网络模型基本一致,如下图20所示。

图20卷积神经网络模型

如图20所示,该网络模型与标准的MNIST网络模型基本一致,包括一个卷积、两个下采样层、两个全连接层和一个输出层。

该论文采用的是IFH-CDB数据库,采用了两个预处理方法来优化网络训练的结果,首先提取字符的边框,然后采用线型动态归一化图像大小的方法,如图21所示。

注意到,该图像数据库为二值图像,所以扩充的时候直接将背景赋值为0,得到了保持图像内容不变形的训练样本。

图21样本预处理方法

论文针对部分容易错分的样本,论文中采用了对错分样本进行充分的方法,即增加错误样本在训练样本的比重,重复出现的样本有利于提高错分样本的区分度,进而提高训练结果。

同时,为了结合多个分类器(卷积神经网络)构成一个连接的分类器,即采用同一个数据集,不同的网络模型,对各个分类器的输出进行运算,得到一个鲁棒性更好的训练结果。

如图22为论文中采取的运算方法和实验结果。

实验中注意到,相对于取最值和阶乘的方法,对各个分类器的输出向量取均值的方法,取得了较好的实验结果。

图22不同分类器连接方法的实验结果图

论文ConvolutionalNeuralNetworkCommitteesForHandwrittenCharacterClassification采用的卷积神经网络组来对手写字母进行识别,所谓的卷积神经网络组是指7个GPU显卡同时训练不同的数据集。

论文中指出,由于单个字符的特性较为复杂,为了适应样本的多变性,将训练样本集进行形变,得到不同的数据集。

如图23所示为论文的主要实现方法。

图23论文的主要思路

对于一般的训练,我们需要将样本集归一化到统一的大小。

如a)所示,字符‘4’归一化图像宽度至10,然后放入训练网络中进行训练。

而论文中采用了7个不同尺度的数据集,如图b)即原始的图像数据集宽度调整为10、12、14、16、18、20的数据集。

将7个不同的数据集(同一个数据集的不同尺度)放在7个并行的GPU中进行训练,对7个网络的输出取平均得到分类结果,即最终的分类器。

该方法的理论依据为:

多尺度样本集参与训练得到的分类结果鲁棒性更强,进而分类结果更好。

在实验中保持网络参数不变,不进行任何的微调操作,得到的结果如图24所示

图24结果对比

从图24中可以看到,采用对七个数据集进行训练对输出结果取平均的方法,得到的错误率低于任何一个单一数据集的卷积神经网络结果,即使是错误率最大值仍然低于单一数据集网络的识别结果。

论文后期还对样本集进行了改进,分别应用在NISTSD19数据集与MNIST数据集,甚至是中文数据集,这种对样本进行形变,采用卷积网络组取平均的方法比单一的卷积神经网络都更有优势。

总结

基于以上对于深度学习文字识别论文的学习,可以认识到以下几点:

利用CNN进行文字编组可以采用论文ThaiTextLocalizationinNaturalSceneImagesusingConvolutionalNeuralNetwork提出的典型方法,即利用CNN进行二分类(文本和非文本),对分类结果进行二次整合,论文ThaiTextLocalizationinNaturalSceneImagesusingConvolutionalNeuralNetwork采用了泰字自身的特点,泰字一般的最高不超过中心线的50%,进而对文本行进行编组实现。

论文ReadingNumbersinNaturalSceneImageswithConvolutionalNeuralNetwork也是采用CNN方法对原始的数字图像进行特征提取,然后将提取的结果输入至HMM模型进而得到数字的识别结果,进而实现数字的编组和识别。

论文ARobustHierarchicalDetectionMethodforSceneTextBasedonConv