spark搭建手册.docx

《spark搭建手册.docx》由会员分享,可在线阅读,更多相关《spark搭建手册.docx(9页珍藏版)》请在冰豆网上搜索。

spark搭建手册

Hadoop+Spark大数据集群环境

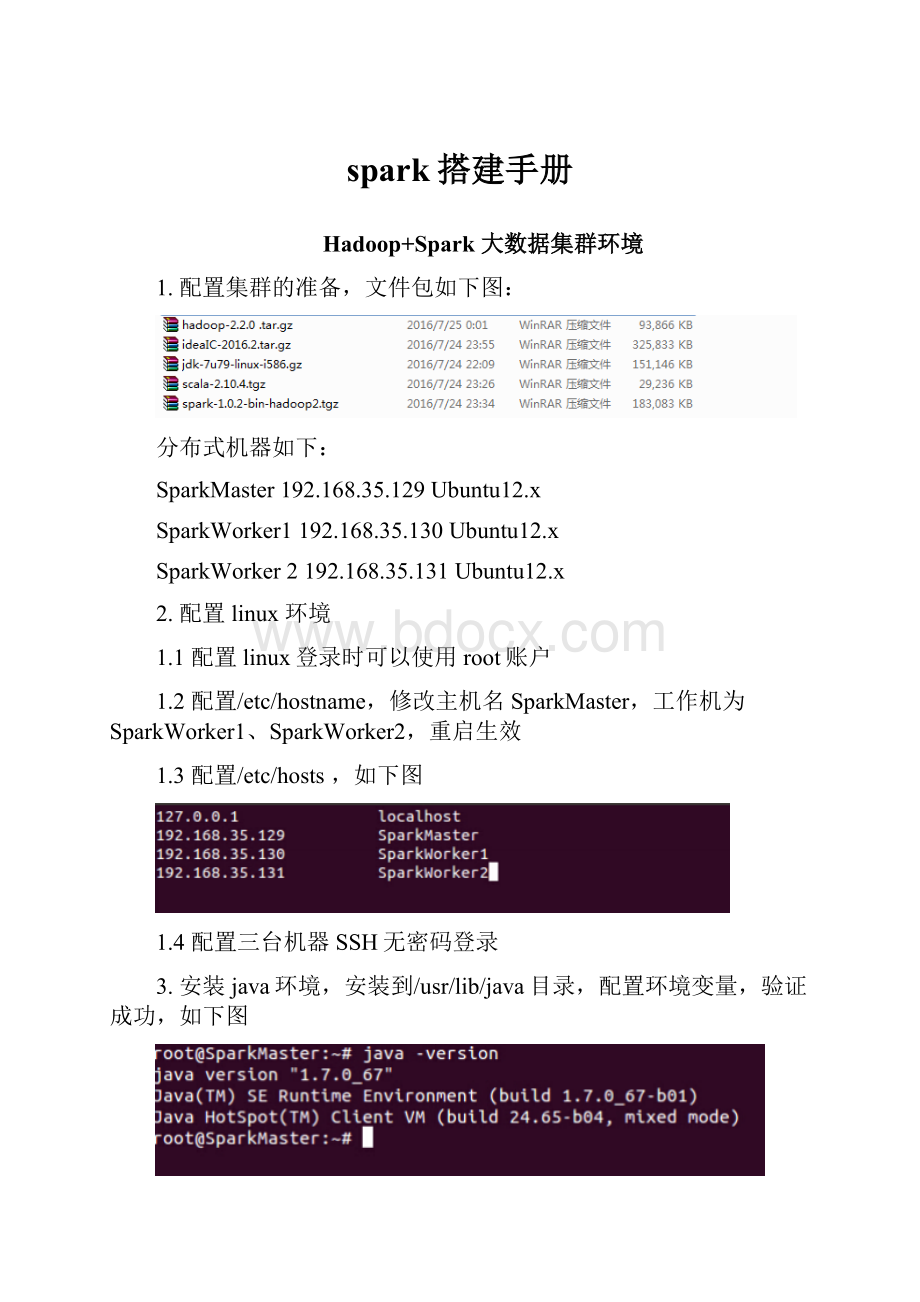

1.配置集群的准备,文件包如下图:

分布式机器如下:

SparkMaster192.168.35.129Ubuntu12.x

SparkWorker1192.168.35.130Ubuntu12.x

SparkWorker2192.168.35.131Ubuntu12.x

2.配置linux环境

1.1配置linux登录时可以使用root账户

1.2配置/etc/hostname,修改主机名SparkMaster,工作机为SparkWorker1、SparkWorker2,重启生效

1.3配置/etc/hosts,如下图

1.4配置三台机器SSH无密码登录

3.安装java环境,安装到/usr/lib/java目录,配置环境变量,验证成功,如下图

4.安装hadoop

1.1将hadoop安装到/usr/local/hadoop目录,配置环境变量

1.2在$HADOOP_HOME下,按照下图操作创建目录,如下图

1.3进入$HADOOP_HOME目录,对配置文件进行如下图配置,如下图

首先,修改hadoop-env.sh,JAVA_HOME=我们java安装目录,如下图

然后,修改yarn-env.sh,JAVA_HOME=我们java安装目录,如下图

然后,修改mapred-env.sh,JAVA_HOME=我们java安装目录,如下图

然后,修改slaves文件,将客户机填写到文件中,如下图

然后,修改core-site.xml,填写如图配置,如下图

然后,修改hdfs-site.xml,填写如图配置,如下图

然后,复制一份mapred-site.xml.template为mapred-site.xml,如下图

然后,修改yarn-site.xml,填写如图配置,如下图

最后,将SparkMaster操作,同步到SparkWorker1和SparkWorker2上

1.4启动hadoop

首先,收入hadoopnamenode–format,如下图

然后,启动hdfs文件系统,如下图

可以验证是否成功,使用jps命令,master有3个进程,worker2有两个进程,如下图

同时登录hdfs文件系统web界面查看配置情况,如下图

然后,启动yarn集群,如下图

进行验证,使用jps命令,如下图

最后,验证hadoop分布式集群

在hdfs上,创建两个文件夹,如下图

登录,hdfs的web界面,进行查看,如下图

5.安装scala

安装到/usr/lib/scala目录下,配置环境变量,验证如下图

所有分布式集群都需要安装。

6.安装spark

1.1安装到/usr/local/spark目录,配置环境变量

1.2修改spark配置文件,进入$SPARK_HOME/conf目录

1.3修改slaves文件,如下图

1.4复制spark-env.sh.template到spark-env.sh,并对其进行修改,如下图

1.5启动spark集群,进入sbin目录,启动start-all.sh如下图

启动后,jps命令,进程列表中会多出一个master进程,同样工作机,如下图

1.6到这里spark集群已经启动,我们可以登录web,进行验证

1.7进入bin目录,启动spark-shell,如下图

测试验证,spark集群这里不多做介绍,能成功启动spark-shell,基本可以认为集群配置成功。