遗传算法 2精品毕业设计完整版.docx

《遗传算法 2精品毕业设计完整版.docx》由会员分享,可在线阅读,更多相关《遗传算法 2精品毕业设计完整版.docx(27页珍藏版)》请在冰豆网上搜索。

遗传算法2精品毕业设计完整版

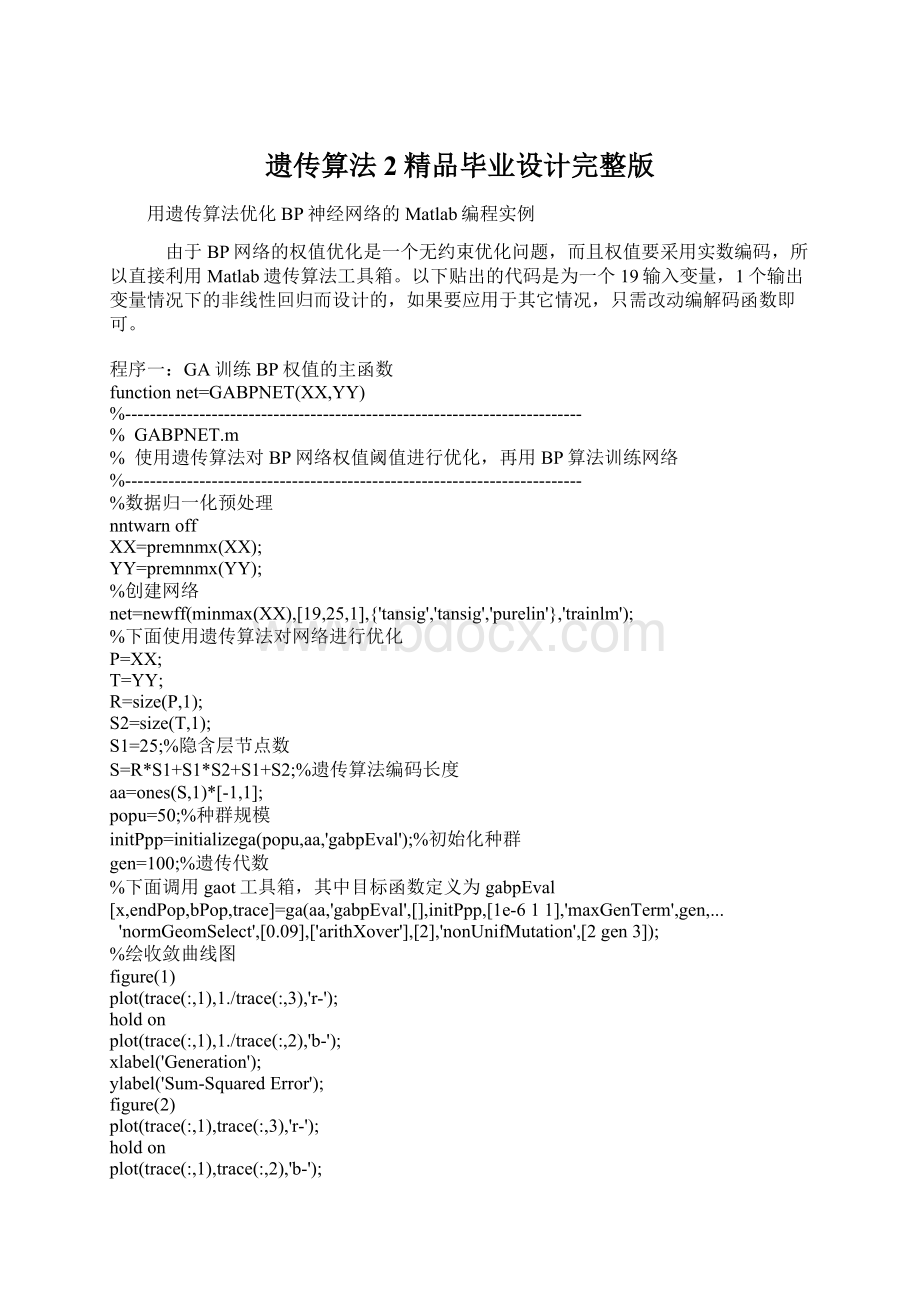

用遗传算法优化BP神经网络的Matlab编程实例

由于BP网络的权值优化是一个无约束优化问题,而且权值要采用实数编码,所以直接利用Matlab遗传算法工具箱。

以下贴出的代码是为一个19输入变量,1个输出变量情况下的非线性回归而设计的,如果要应用于其它情况,只需改动编解码函数即可。

程序一:

GA训练BP权值的主函数

functionnet=GABPNET(XX,YY)

%--------------------------------------------------------------------------

% GABPNET.m

% 使用遗传算法对BP网络权值阈值进行优化,再用BP算法训练网络

%--------------------------------------------------------------------------

%数据归一化预处理

nntwarnoff

XX=premnmx(XX);

YY=premnmx(YY);

%创建网络

net=newff(minmax(XX),[19,25,1],{'tansig','tansig','purelin'},'trainlm');

%下面使用遗传算法对网络进行优化

P=XX;

T=YY;

R=size(P,1);

S2=size(T,1);

S1=25;%隐含层节点数

S=R*S1+S1*S2+S1+S2;%遗传算法编码长度

aa=ones(S,1)*[-1,1];

popu=50;%种群规模

initPpp=initializega(popu,aa,'gabpEval');%初始化种群

gen=100;%遗传代数

%下面调用gaot工具箱,其中目标函数定义为gabpEval

[x,endPop,bPop,trace]=ga(aa,'gabpEval',[],initPpp,[1e-611],'maxGenTerm',gen,...

'normGeomSelect',[0.09],['arithXover'],[2],'nonUnifMutation',[2gen3]);

%绘收敛曲线图

figure

(1)

plot(trace(:

1),1./trace(:

3),'r-');

holdon

plot(trace(:

1),1./trace(:

2),'b-');

xlabel('Generation');

ylabel('Sum-SquaredError');

figure

(2)

plot(trace(:

1),trace(:

3),'r-');

holdon

plot(trace(:

1),trace(:

2),'b-');

xlabel('Generation');

ylabel('Fittness');

%下面将初步得到的权值矩阵赋给尚未开始训练的BP网络

[W1,B1,W2,B2,P,T,A1,A2,SE,val]=gadecod(x);

net.LW{2,1}=W1;

net.LW{3,2}=W2;

net.b{2,1}=B1;

net.b{3,1}=B2;

XX=P;

YY=T;

%设置训练参数

net.trainParam.show=1;

net.trainParam.lr=1;

net.trainParam.epochs=50;

net.trainParam.goal=0.001;

%训练网络

net=train(net,XX,YY);

程序二:

适应值函数

function[sol,val]=gabpEval(sol,options)

%val-thefittnessofthisindividual

%sol-theindividual,returnedtoallowforLamarckianevolution

%options-[current_generation]

loaddata2

nntwarnoff

XX=premnmx(XX);

YY=premnmx(YY);

P=XX;

T=YY;

R=size(P,1);

S2=size(T,1);

S1=25;%隐含层节点数

S=R*S1+S1*S2+S1+S2;%遗传算法编码长度

fori=1:

S,

x(i)=sol(i);

end;

[W1,B1,W2,B2,P,T,A1,A2,SE,val]=gadecod(x);

程序三:

编解码函数

function[W1,B1,W2,B2,P,T,A1,A2,SE,val]=gadecod(x)

loaddata2

nntwarnoff

XX=premnmx(XX);

YY=premnmx(YY);

P=XX;

T=YY;

R=size(P,1);

S2=size(T,1);

S1=25;%隐含层节点数

S=R*S1+S1*S2+S1+S2;%遗传算法编码长度

%前R*S1个编码为W1

fori=1:

S1,

fork=1:

R,

W1(i,k)=x(R*(i-1)+k);

end

end

%接着的S1*S2个编码(即第R*S1个后的编码)为W2

fori=1:

S2,

fork=1:

S1,

W2(i,k)=x(S1*(i-1)+k+R*S1);

end

end

%接着的S1个编码(即第R*S1+S1*S2个后的编码)为B1

fori=1:

S1,

B1(i,1)=x((R*S1+S1*S2)+i);

end

%接着的S2个编码(即第R*S1+S1*S2+S1个后的编码)为B2

fori=1:

S2,

B2(i,1)=x((R*S1+S1*S2+S1)+i);

end

%计算S1与S2层的输出

A1=tansig(W1*P,B1);

A2=purelin(W2*A1,B2);

%计算误差平方和

SE=sumsqr(T-A2);

val=1/SE;%遗传算法的适应值

上述程序需要调用gaot工具箱,请从附件里下载!

原创】蚁群算法最短路径通用Matlab程序(附图)

下面的程序是蚁群算法在最短路中的应用,稍加扩展即可应用于机器人路径规划

function[ROUTES,PL,Tau]=ACASP(G,Tau,K,M,S,E,Alpha,Beta,Rho,Q)

%%---------------------------------------------------------------

% ACASP.m

% 蚁群算法动态寻路算法

% ChengAihua,PLAInformationEngineeringUniversity,ZhengZhou,China

% Email:

aihuacheng@

% Allrightsreserved

%%---------------------------------------------------------------

% 输入参数列表

% G 地形图为01矩阵,如果为1表示障碍物

% Tau 初始信息素矩阵(认为前面的觅食活动中有残留的信息素)

% K 迭代次数(指蚂蚁出动多少波)

% M 蚂蚁个数(每一波蚂蚁有多少个)

% S 起始点(最短路径的起始点)

% E 终止点(最短路径的目的点)

% Alpha 表征信息素重要程度的参数

% Beta 表征启发式因子重要程度的参数

% Rho 信息素蒸发系数

% Q 信息素增加强度系数

%

% 输出参数列表

% ROUTES 每一代的每一只蚂蚁的爬行路线

% PL 每一代的每一只蚂蚁的爬行路线长度

% Tau 输出动态修正过的信息素

%%--------------------变量初始化----------------------------------

%load

D=G2D(G);

N=size(D,1);%N表示问题的规模(象素个数)

MM=size(G,1);

a=1;%小方格象素的边长

Ex=a*(mod(E,MM)-0.5);%终止点横坐标

ifEx==-0.5

Ex=MM-0.5;

end

Ey=a*(MM+0.5-ceil(E/MM));%终止点纵坐标

Eta=zeros(1,N);%启发式信息,取为至目标点的直线距离的倒数

%下面构造启发式信息矩阵

fori=1:

N

ifix==-0.5

ix=MM-0.5;

end

iy=a*(MM+0.5-ceil(i/MM));

ifi~=E

Eta(1,i)=1/((ix-Ex)^2+(iy-Ey)^2)^0.5;

else

Eta(1,i)=100;

end

end

ROUTES=cell(K,M);%用细胞结构存储每一代的每一只蚂蚁的爬行路线

PL=zeros(K,M);%用矩阵存储每一代的每一只蚂蚁的爬行路线长度

%%-----------启动K轮蚂蚁觅食活动,每轮派出M只蚂蚁--------------------

fork=1:

K

disp(k);

form=1:

M

%% 第一步:

状态初始化

W=S;%当前节点初始化为起始点

Path=S;%爬行路线初始化

PLkm=0;%爬行路线长度初始化

TABUkm=ones(1,N);%禁忌表初始化

TABUkm(S)=0;%已经在初始点了,因此要排除

DD=D;%邻接矩阵初始化

%% 第二步:

下一步可以前往的节点

DW=DD(W,:

);

DW1=find(DW

forj=1:

length(DW1)

ifTABUkm(DW1(j))==0

DW(j)=inf;

end

end

LJD=find(DW

Len_LJD=length(LJD);%可选节点的个数

%% 觅食停止条件:

蚂蚁未遇到食物或者陷入死胡同

whileW~=E&&Len_LJD>=1

%% 第三步:

转轮赌法选择下一步怎么走

PP=zeros(1,Len_LJD);

fori=1:

Len_LJD

PP(i)=(Tau(W,LJD(i))^Alpha)*(Eta(LJD(i))^Beta);

end

PP=PP/(sum(PP));%建立概率分布

Pcum=cumsum(PP);

Select=find(Pcum>=rand);

%% 第四步:

状态更新和记录

Path=[Path,to_visit];%路径增加

PLkm=PLkm+DD(W,to_visit);%路径长度增加

W=to_visit;%蚂蚁移到下一个节点

forkk=1:

N

ifTABUkm(kk)==0

DD(W,kk)=inf;

DD(kk,W)=inf;

end

end

TABUkm(W)=0;%已访问过的节点从禁忌表中删除

forj=1:

length(DW1)

ifTABUkm(DW1(j))==0

DW(j)=inf;

end

end

LJD=find(DW

Len_LJD=length(LJD);%可选节点的个数

end

%% 第五步:

记下每一代每一只蚂蚁的觅食路线和路线长度

ROUTES{k,m}=Path;

ifPath(end)==E

PL(k,m)=PLkm;

else

PL(k,m)=inf;

end

end

%%第六步:

更新信息素

Delta_Tau=zeros(N,N);%更新量初始化

form=1:

M

ifPL(k,m) ROUT=ROUTES{k,m};

TS=length(ROUT)-1;%跳数

PL_km=PL(k,m);

fors=1:

TS

x=ROUT(s);

Delta_Tau(x,y)=Delta_Tau(x,y)+Q/PL_km;

Delta_Tau(y,x)=Delta_Tau(y,x)+Q/PL_km;

end

end

end

Tau=(1-Rho).*Tau+Delta_Tau;%信息素挥发一部分,新增加一部分

end

%%---------------------------绘图--------------------------------

plotif=1;%是否绘图的控制参数

ifplotif==1

%绘收敛曲线

meanPL=zeros(1,K);

minPL=zeros(1,K);

fori=1:

K

PLK=PL(i,:

);

Nonzero=find(PLK

PLKPLK=PLK(Nonzero);

meanPL(i)=mean(PLKPLK);

minPL(i)=min(PLKPLK);

end

figure

(1)

plot(minPL);

holdon

plot(meanPL);

gridon

title('收敛曲线(平均路径长度和最小路径长度)');

xlabel('迭代次数');

ylabel('路径长度');

%绘爬行图

figure

(2)

axis([0,MM,0,MM])

fori=1:

MM

forj=1:

MM

ifG(i,j)==1

x1=j-1;y1=MM-i;

x2=j;y2=MM-i;

x3=j;y3=MM-i+1;

x4=j-1;y4=MM-i+1;

fill([x1,x2,x3,x4],[y1,y2,y3,y4],[0.2,0.2,0.2]);

holdon

else

x1=j-1;y1=MM-i;

x2=j;y2=MM-i;

x3=j;y3=MM-i+1;

x4=j-1;y4=MM-i+1;

fill([x1,x2,x3,x4],[y1,y2,y3,y4],[1,1,1]);

holdon

end

end

end

holdon

ROUT=ROUTES{K,M};

LENROUT=length(ROUT);

Rx=ROUT;

Ry=ROUT;

forii=1:

LENROUT

Rx(ii)=a*(mod(ROUT(ii),MM)-0.5);

ifRx(ii)==-0.5

Rx(ii)=MM-0.5;

end

Ry(ii)=a*(MM+0.5-ceil(ROUT(ii)/MM));

end

plot(Rx,Ry)

end

plotif2=1;%绘各代蚂蚁爬行图

ifplotif2==1

figure(3)

axis([0,MM,0,MM])

fori=1:

MM

forj=1:

MM

ifG(i,j)==1

x1=j-1;y1=MM-i;

x2=j;y2=MM-i;

x3=j;y3=MM-i+1;

x4=j-1;y4=MM-i+1;

fill([x1,x2,x3,x4],[y1,y2,y3,y4],[0.2,0.2,0.2]);

holdon

else

x1=j-1;y1=MM-i;

x2=j;y2=MM-i;

x3=j;y3=MM-i+1;

x4=j-1;y4=MM-i+1;

fill([x1,x2,x3,x4],[y1,y2,y3,y4],[1,1,1]);

holdon

end

end

end

fork=1:

K

PLK=PL(k,:

);

minPLK=min(PLK);

pos=find(PLK==minPLK);

m=pos

(1);

ROUT=ROUTES{k,m};

LENROUT=length(ROUT);

Rx=ROUT;

Ry=ROUT;

forii=1:

LENROUT

Rx(ii)=a*(mod(ROUT(ii),MM)-0.5);

ifRx(ii)==-0.5

Rx(ii)=MM-0.5;

end

Ry(ii)=a*(MM+0.5-ceil(ROUT(ii)/MM));

end

plot(Rx,Ry)

holdon

end

end

将上述算法应用于机器人路径规划,优化效果如下图所示

原创】支持向量机和BP神经网络非线性回归之比较研究

支持向量机和BP神经网络虽然都可以用来做非线性回归,但它们所基于的理论基础不同,回归的机理也不相同。

支持向量机基于结构风险最小化理论,普遍认为其泛化能力要比神经网络的强。

为了验证这种观点,本文编写了支持向量机非线性回归的通用Matlab程序和基于神经网络工具箱的BP神经网络仿真模块,仿真结果证实,支持向量机做非线性回归不仅泛化能力强于BP网络,而且能避免神经网络的固有缺陷——训练结果不稳定。

我们编写的支持向量机非线性回归通用Matlab程序的主体部分如下

(声明:

此程序可当作工具箱使用,程序中的一些关键行被删掉了,一般人是难以将其补充完整的。

此程序定价200元一份,请勿再还价,如果有意购买,请与我们联系,Email:

greensim@)

function[Alpha1,Alpha2,Alpha,Flag,B]=SVMNR(X,Y,Epsilon,C,TKF)

%%

% SVMNR.m

% SupportVectorMachineforNonlinearRegression

% ChengAihua,PLAInformationEngineeringUniversity,ZhengZhou,China

% Email:

aihuacheng@

% Allrightsreserved

%%

% 支持向量机非线性回归通用程序

% 程序功能:

% 使用支持向量机进行非线性回归,得到非线性函数y=f(x1,x2,…,xn)的支持向量解析式,

% 求解二次规划时调用了优化工具箱的quadprog函数。

本函数在程序入口处对数据进行了

% [-1,1]的归一化处理,所以计算得到的回归解析式的系数是针对归一化数据的,仿真测

% 试需使用与本函数配套的Regression函数。

% 主要参考文献:

% 朱国强,刘士荣等.支持向量机及其在函数逼近中的应用.华东理工大学学报

% 输入参数列表

% X 输入样本原始数据,n×l的矩阵,n为变量个数,l为样本个数

% Y 输出样本原始数据,1×l的矩阵,l为样本个数

% Epsilon ε不敏感损失函数的参数,Epsilon越大,支持向量越少

% C 惩罚系数,C过大或过小,泛化能力变差

% TKF TypeofKernelFunction核函数类型

% TKF=1 线性核函数,注意:

使用线性核函数,将进行支持向量机的线性回归

% TKF=2 多项式核函数

% TKF=3 径向基核函数

% TKF=4 指数核函数

% TKF=5 Sigmoid核函数

% TKF=任意其它值,自定义核函数

% 输出参数列表

% Alpha1 α系数

% Alpha2 α*系数

% Alpha 支持向量的加权系数(α-α*)向量

% Flag 1×l标记,0对应非支持向量,1对应边界支持向量,2对