第十一章多元线形回归分析报告报告材料.docx

《第十一章多元线形回归分析报告报告材料.docx》由会员分享,可在线阅读,更多相关《第十一章多元线形回归分析报告报告材料.docx(10页珍藏版)》请在冰豆网上搜索。

第十一章多元线形回归分析报告报告材料

第十一章多元相关与回归分析

第一节多元线性回归模型

多元线性回归即多个自变量对一个因变量的线性回归。

一、多元线性回归模型概念

以两个自变量的二元回归为例,如X1、X2和Y的关系存在关系式:

E(Y)=α+β1X1+β2X2,则Y与X1和X2之间存在多元线性相关关系,这一方程即多元线性回归模型。

多元线性回归是多维空间中的超平面,如二元回归是三维空间中的一个平面。

对于任意的(X1,X2),Y的期望值就是该平面上正对(X1,X2)的那个点的Y轴值,其与实际观测点之间存在随机误差,实际观测点Yi=α+β1X1+β2X2+εi。

二、模型的建立

总体未知情况下,以样本构造出一个平面来估计总体真实平面,即以平面ŷ=a+b1x1+b2x2去拟合原始观测数据。

拟合的准则是最小二乘法原理,使各观测值距离拟合值的偏差平方和最小,即∑(yi-ŷ)2最小。

由此计算出的a,b1,b2是对α,β1,β2的最佳估计。

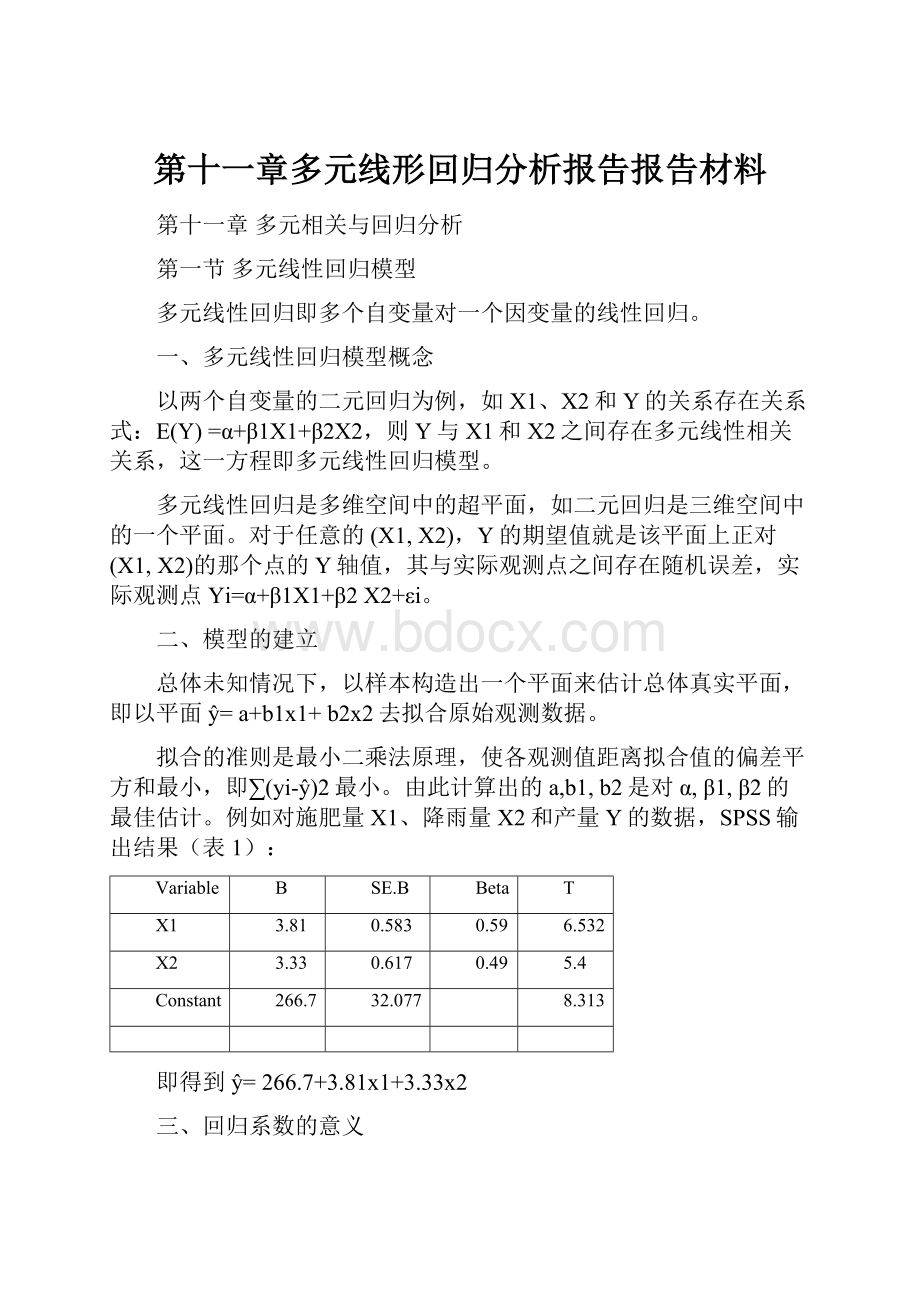

例如对施肥量X1、降雨量X2和产量Y的数据,SPSS输出结果(表1):

Variable

B

SE.B

Beta

T

X1

3.81

0.583

0.59

6.532

X2

3.33

0.617

0.49

5.4

Constant

266.7

32.077

8.313

即得到ŷ=266.7+3.81x1+3.33x2

三、回归系数的意义

对于模型ŷ=a+b1x1+b2x2,b1可以解释为:

当X2不变的情况下,X1每变化一个单位,Y将平均发生b1个单位的变化。

如果所有自变量都同时变化,那么ΔY=b1ΔX1+b2ΔX2+….biΔXi。

例题:

如果对产量、施肥量、降雨量做出了简单回归和多元回归模型:

A模型:

产量=287+5.9施肥量;B模型:

产量=400+6.0降雨量;

C模型:

产量=267+3.81施肥量+3.33降雨量;

请计算:

(1)如果在每亩土地上多施10斤肥料,可以期望产量增加多少?

(2)如果在每亩土地上多灌溉5厘米的水,可以期望产量增加多少?

(3)如果同时在每亩土地上多施10斤肥料,并且多灌溉5厘米的水,可以期望产量增加多少?

(4)由原始数据发现较高的施肥量和较高的降雨量是有联系的,如果照这样的趋势下去,那么在每亩土地上多灌溉5厘米的水,可以期望产量增加多少?

解:

(1)ΔY=3.81(10)=38.1斤。

(2)ΔY=3.33(5)=16.65斤。

(3)ΔY=3.81(10)+3.33(5)=38.1+16.65=54.75斤

(4)ΔY=6.0(5)=30斤。

采用B模型中的简单回归系数6.0,它表示当施肥量也变化时,产量怎样随着降雨量的变化而变化。

比较题2和题4,30斤的增产不只归功于降雨量,也包含施肥量的影响;而16.65斤的增产则是在施肥量不变的情况下,伴随着降雨量的增加而产生的。

四、自变量为定类变量时回归系数的解释

线形回归要求自变量和因变量都是定距变量,但当自变量为二项变量或定类变量时,可以将其转化为0-1变量/虚拟变量后再进行回归。

1、自变量为二项变量时:

如研究存款额Y(百元)和年龄X1、性别X2之间的关系,令男性=1,女性=0(对照组)。

如果得到如下多元回归方程:

ŷ=33+12x1-9.1x2,则x2的回归系数-9.1表示,对于同年龄的人来说,男性的存款额比女性平均减少910元。

2、自变量为定类变量时:

如研究收入Y(百元)和文化程度X之间的关系,假设文化程度包括小学、中学、大学,可将文化程度转化为两个虚拟变量,

D1=D2=,D1=D2=0代表小学程度(对照组),D1=1,D2=0表示中学文化程度;D1=0,D2=1表示大学文化程度。

假如得到回归方程ŷ=33+12D1+30D2,D1的回归系数表示中学文化程度的人比小学文化程度的人收入平均多1200元;D2的回归系数表示大学文化程度的人比小学文化程度的人收入平均多3000元。

3、如果自变量为连续变量,但其与因变量的关系并不是线形关系,例如年龄X和身高Y的关系,可以把年龄划分成年龄段做为定类变量。

对于有个水平的定类变量,需要设计n-1个虚拟变量来描述。

第二节多元线性回归模型检验

一、回归系数的估计和检验

在多元回归中,各个回归系数的估计值b1,b2…都围绕总体回归系数β1,β2…近似正态波动,所以可以用样本回归系数的标准误差来构造总体回归系数的置信区间。

标准误差为表1中的第二列输出结果SE.B。

总体回归系数置信区间公式:

βi=bi±tα/2SEi,

其中,i=1,2,….k;查t分布表时的自由度为n-k-1。

例题:

以表1为例,计算每个回归系数的95%的置信区间(k=1,2),已知n=7:

解:

df=7-2-1=4;查表得t0.025=2.776;

β1=3.81±2.776(0.583)=3.81±1.618;

β2=3.33±2.776(0.617)=3.33±1.713

对回归系数进行检验即检验H0:

βi=0;H1:

βi≠0,即检验自变量和因变量之间是否存在线形相关关系。

检验方法:

计算检验统计量为t=bi-0/SEi,计算出相应概值。

SPSS可以输出t值和概值P。

二、回归模型的检验

即检验H0:

β1=β2=……=βi=0。

对多元回归做方差分析及显著性检验:

将总偏差平方和

分解为

ŷi)2(不能由回归解释的偏差)和

ŷi-

)2(可以由对X1,X2…Xk的回归解释的偏差)。

计算F值=可以由回归解释的方差/不能解释的方差,然后对F值与临界值进行比较,也可计算F值的概值。

表2:

对改革时间Y与公司规模X1和公司类型X2的二元回归作出方差分析表,包括求出概值和进行95%置信水平下的检验。

SS

df

MS

F

概值

回归误差

1504.41

2

752.20

72.47

<0.001

残差

176.39

17

10.38

总误差

1680.80

19

在95%的置信水平下可以拒绝原假设,说明回归效果是显著的,即回归模型有意义。

第三节相关系数和决定系数

一、复相关系数和决定系数

决定系数R22=可以由回归解释的偏差/总偏差=Σ(ŷi-

)2/Σ

;R2的平方根R为复相关系数,取值范围0-1。

R2=1时,说明Y的全部偏差都可以用回归方程解释,以二元回归为例,表明全部观测点正好落在拟合的回归平面上。

R2越大,能用回归来解释的部分就越大,表示Y和X1,X2,…,Xi的线形关系越强,回归效果越好,R2也具有消减误差比例的意义。

例如根据表2计算出:

R2=1504.41/1680.80=0.8950559;R=0.9460739

解释:

应用二元回归可以解释总偏差中的89.5%,以改革时间对公司规模和公司类型作二元回归,效果是很好的。

二、偏相关系数和偏决定系数

决定系数反映了一组自变量对回归模型的贡献。

如果想知道某一个自变量的贡献,需计算引进这个变量后,所减少的残差的相对比例。

以二元回归为例,设ŷ=a+b1x1+b2x2,用RSS(X1,X2)表示残差;如果只对自变量X2做简单回归模型ŷ=a+b2x2,用RSS(X2)表示残差。

则RSS(X2)肯定大于RSS(X1,X2),在已有X2的模型中再引入X1变量后,所减少的残差为RSS(X2)-RSS(X1,X2)。

减少的相对残差R2Y1.2=(RSS(X2)-RSS(X1,X2))/RSS(X2)就是偏决定系数,表示X2已在模型当中时,再引入变量X1后,能够减少百分之多少的残差。

偏决定系数的平方根为偏相关系数,其符号与拟合回归函数中相应的回归系数符号一致。

偏相关系数可以看作是消除了X2的影响效应后,对Y和X1之间的关联程度的度量,也称净相关。

三、标准化回归系数

将所有变量Y,X1,X2…Xi标准化,然后对标准化后的Y*,Xi*进行回归拟合得:

Y*=a*+b1*X1*+...+bi*Xi*

b1*,b2*…bi*就是标准回归系数,其大小说明了各自对应的自变量对Y的影响大小,标准回归系数绝对值越大,该自变量的影响就越大。

例如表1第四列的标准回归系数Beta,施肥量(0.59)对产量的影响比降雨量(0.49)更大。

但注意:

这种方法只有当自变量之间的相关性较小时才正确。

第四节非线性相关与回归分析

对于变量之间会的非线性的关系,可将其变换为线性关系再处理。

一、幂函数

幂函数基本形式为:

Yi=β1Xiβ2eui,ui为随机误差项,和β1为β2参数。

参数β2度量了变量Y对变量X的弹性,即X的单位百分比变动引起Y变动的百分比,β2=

=

。

由于Y和X之间是非线性关系,为了将其变为线形形式,可以对方程两边取对数,转换为双对数函数形式,即InYi=Inβ1+β2InXi+ui,把InYi和InXi视为新的变量,则新变量之间成为线形关系,可以按照线形回归的方式估计参数。

也可拓展到多元的情况,如InYi=Inβ1+β2InX1i+β3InX2i…+ui。

例如:

根据天津市1980-1996年的经济统计资料,想研究天津市国内生产总值GDP和资金投入量及从业人员数量之间的关系,可运用柯柏—道格拉斯生产函数建立理论回归方程:

Yi=AKiαLiβeui,Y是GDP,K是资金投入量,L是从业人数,ui是随机误差项。

为了便于估计参数,将该方程转换为线性方程:

InYi=InA+αInKi+βInLi+ui,设Yi*=InYi,Ki*=InKi,Li*=InLi,β1=InA,β2=α,β3=β,则上式变为Yi*=β1+β2Ki*+β3Li*+ui,用线形回归分析得出结果:

ŷi*=-10.4639+1.021124Ki+1.471943Li*

因为β1=InA=-10.4639,所以A=0.0000285,这样所估计的生产函数为:

ŷi*=0.0000285Ki1.021124Li1.471943

二、对数函数

对数函数关系包括自变量为对数和因变量为对数两种情况。

自变量为对数时,方程为Yi=α+βInXi+ui,参数β表示自变量X每变动一个百分点时,会引起因变量Y绝对值的变动量。

若把InXi视为新变量,可以作为线形回归去处理。

当因变量为对数时,方程为InYi=α+βXi+ui,参数β表示自变量X每变动一个单位时,会引起因变量Y发生几个百分比的变动。

如把InYi视为新变量,可以作为线形回归去处理。

例如:

美国联邦储备管理委员会要研究GDP和货币供应量X的关系,建立对数方程Yi=β1+β2InXi+ui,可先将货币供应量数据Xi转变为InXi,再按照线性回归方法作GDP对InXi的回归,得到ŷi=-16329+2584.79InXi,表明货币供应量每增加一个百分点,GDP的绝对量将增加2584.79亿美元。

三、指数函数

指数函数的形式为Yi=abXieui。

指数函数通常用于描述产量、成本等现象的变动趋势。

对方程两边取对数可转化为线性函数:

InYi=Ina+XiInb+ui,这时的变量为InYi和Xi,参数为Ina和Inb。

可以设Yi*=InYi,β1=Ina,β2=Inb,得到Yi*=β1+β2Xi+ui。

对于非线性关系,用相关指数度量其相关程度,相关指数就是非线性回归的决定系数R2或者决定系数的平方根R。

R2和R越大,表明变量间的非线性相关程度越高,反之越低。

R取值范围0-1。

四、logistic回归(因变量为二项变量时的回归)

当因变量为二项变量时,可将其转化为定距变量。

其他定类变量也可以转化为二项变量来研究。

用虚拟变量的形式来表示因变量Y,即Y=,并设成功的概率P(Y=1)=π,失败的概率P(Y=0)=1-π,根据二项分布特征,可知Y的期望值E(Y)=π,Y的方差D(Y)=π(1-π)。

设Y(二项变量)对自变量的回归模型为:

E(Y)=α+β1X1+…+βiXi

如果拟合的方程为:

ŷ=a+b1x1+…+bixi

那么,拟合值ŷ就表示成功概率π即E(Y)的估计值。

所以自变量对Y的影响就转化为了自变量对成功概率的影响。

然而,对于二项变量来说,其E(Y)的取值范围只能是0-1,这样就不能很好适应线形回归模型(线形回归要求因变量连续取值),所以考虑对E(Y)进行数值变换,可以将其转化为P*=ln(

),P即π

ln(

)=Logit(P)=α+β1X1+…+βiXi就是logistic回归模型。

当P趋于0时,Logit(P)趋于-∞,当P趋于1时,Logit(P)趋于+∞。

通过这样的变换,使得因变量原本在(0,1)的取值范围变成了(-∞,+∞)。

logistic回归最常用于流行病学研究,用来探讨某种疾病的危险因素,或者根据危险因素来预测患病概率。

根据模型得P=e(α+β1X1+…+βiXi)/[1+e(α+β1X1+…+βiXi)],可预测发生概率。

对于logistic回归,用OddsRatio发生比来解释回归系数,OR:

发生概率与不发生概率的比值。

OR=eβ;lnOR=β。

β表示自变量每增加一个单位,其相对危险度为eβ。

例如:

研究吸烟年数X与是否患肺癌Y的关系,若根据β=1计算出OR=2.72,则表明吸烟年数每增加一年,患肺癌的危险性是之前的2.72倍。

如果研究是否吸烟与肺癌的关系,令X=1吸烟,X=0不吸烟;Y=1患肺癌,Y=0不患肺癌,若求得OR=2.72,则表明吸烟的人患肺癌症的危险性是不吸烟的2.72倍。

如果令X=1不吸烟,X=0吸烟;Y=1患肺癌Y=0,不患肺癌,若求得OR=0.3637,则表明不吸烟的人患肺癌症的危险性是吸烟的36.37%,或不吸烟的人患肺癌的危险性比吸烟者降低了63.63%。

注意区分X变量的赋值。

第五节自变量的选择

SPSS提供的5种选择变量的方法:

1、向前加入变量法(FORWARD)。

将自变量逐个引入方程,每次增加一个。

第一步是从所有K个自变量中引入一个,使它与Y组成的一元方程比其他更好(即可用回归解释的偏差比例更大);第二步是从未引入的K-1个自变量中再选一个,使它和已进入的自变量与Y组成的二元回归方程比其他更好,以此类推,每一步都要对引入的变量做显著性检验,直至最新引入的变量不再显著为止。

2、自后淘汰变量法(BACKWARD)。

先将全部K各自变量引入回归方程,然后对每个自变量做显著性检验,剔除不显著变量中最不重要的;接着用剩下的自变量与Y重新拟合回归方程,再剔除不重要的变量,以此类推,直至方程中所有变量都显著为止。

3、逐步回归法(STEPWISE)。

前两种方法的结合,先按自变量重要性程度从一个自变量开始逐步引入方程,类似向前加入变量法;每引进一个新变量时,要重新对方程中的全部自变量再做显著性检验,剔除其中不显著的,直至既无显著变量从方程中剔除,有无显著变量引入方程为止。

4、强迫进入变量法(ENTER)。

按照研究目的和已有的知识经验选择自变量,强迫这些自变量与Y建立回归方程。

5、强迫变量退出法(REMOVE)。

与前法相反,强迫某个或某些变量退出方程。

第二、三、四种更为常用一些。

引入和剔除变量的标准:

自变量对Y的作用的显著程度。

当引入或剔除一个自变量时,对回归的方差分析中“可用回归解释的偏差”将会增大或减小,这个变化量称作偏回归平方和,其与残差的F比值就反映了该自变量的重要性程度。

对这个比值进行F检验就是对该自变量的显著性检验,将Fin(进入方程所需的最小F值)和Fout(剔除变量时不能超过的最大F值)作为引入和剔除变量的标准,这个标准可自行设定,如果没有规定,程序会自动采取默认值Fin=0.05,Fout=0.10。