模式识别练习题Word下载.doc

《模式识别练习题Word下载.doc》由会员分享,可在线阅读,更多相关《模式识别练习题Word下载.doc(24页珍藏版)》请在冰豆网上搜索。

当wi类模式与wj类模式的分布相同时,Jij=0。

二、选择题

1、影响聚类算法结果的主要因素有(B、C、D)。

A.已知类别的样本质量;

B.分类准则;

C.特征选取;

D.模式相似性测度

2、模式识别中,马式距离较之于欧式距离的优点是(C、D)。

A.平移不变性;

B.旋转不变性;

C尺度不变性;

D.考虑了模式的分布

3、影响基本K-均值算法的主要因素有(ABD)。

A.样本输入顺序;

B.模式相似性测度;

C.聚类准则;

D.初始类中心的选取

4、位势函数法的积累势函数K(x)的作用相当于Bayes判决中的(BD)。

A.先验概率;

B.后验概率;

C.类概率密度;

D.类概率密度与先验概率的乘积

5、在统计模式分类问题中,当先验概率未知时,可以使用(BD)。

A.最小损失准则;

B.最小最大损失准则;

C.最小误判概率准则;

D.N-P判决

6、散度JD是根据(C)构造的可分性判据。

D.信息熵;

E.几何距离

7、似然函数的概型已知且为单峰,则可用(ABCDE)估计该似然函数。

A.矩估计;

B.最大似然估计;

C.Bayes估计;

D.Bayes学习;

E.Parzen窗法

8、KN近邻元法较之Parzen窗法的优点是(B)。

A.所需样本数较少;

B.稳定性较好;

C.分辨率较高;

D.连续性较好

9、从分类的角度讲,用DKLT做特征提取主要利用了DKLT的性质:

(AC)。

A.变换产生的新分量正交或不相关;

B.以部分新的分量表示原矢量均方误差最小;

C.使变换后的矢量能量更集中

10、如果以特征向量的相关系数作为模式相似性测度,则影响聚类算法结果的主要因素有(BC)。

A.已知类别样本质量;

B.分类准则;

C.特征选取;

D.量纲

11、欧式距离具有(AB);

马式距离具有(ABCD)。

A.平移不变性;

B.旋转不变性;

C.尺度缩放不变性;

D.不受量纲影响的特性

12、聚类分析算法属于(A);

判别域代数界面方程法属于(C)。

A.无监督分类;

B.有监督分类;

C.统计模式识别方法;

D.句法模式识别方法

13、若描述模式的特征量为0-1二值特征量,则一般采用(D)进行相似性度量。

A.距离测度;

B.模糊测度;

C.相似测度;

D.匹配测度

14、下列函数可以作为聚类分析中的准则函数的有(ACD)。

A.;

B.;

C.;

D.

15、Fisher线性判别函数的求解过程是将N维特征矢量投影在(B)中进行。

A.二维空间;

B.一维空间;

C.N-1维空间

16、用parzen窗法估计类概率密度函数时,窗宽过窄导致波动过大的原因是(BC)。

A.窗函数幅度过小;

B.窗函数幅度过大;

C.窗口中落入的样本数过少;

D.窗口中落入的样本数过多。

17、如下聚类算法中,属于静态聚类算法的是(AB)。

A.最大最小距离聚类;

B.层次聚类;

C.c-均值聚类。

18、一般,k-NN最近邻方法在(B)的情况下效果较好。

A.样本较多但典型性不好;

B.样本较少但典型性好;

C.样本呈团状分布;

D.样本呈链状分布

19、影响c均值聚类算法效果的主要因素之一是初始类心的选取,相比较而言,(C)c个样本作为初始类心较好。

A.按输入顺序选前;

B.选相距最远的;

C.选分布密度最高处的;

D.随机挑选。

20、类域界面方程法中,能求线性不可分情况下分类问题近似或精确解的方法是(BCD)。

A.感知器算法;

B.伪逆法;

C.基于二次准则的H-K算法;

D.势函数法。

三、简答题

1、试说明Mahalanobis距离平方的定义,到某点的Mahalanobis距离平方为常数的轨迹的几何意义,它与欧氏距离的区别与联系。

答:

Mahalanobis距离的平方定义为:

其中x,u为两个数据,是一个正定对称矩阵(一般为协方差矩阵)。

根据定义,距某一点的Mahalanobis距离相等点的轨迹是超椭球,如果是单位矩阵Σ,则Mahalanobis距离就是通常的欧氏距离。

2、试说明用监督学习与非监督学习两种方法对道路图像中道路区域的划分的基本做法,以说明这两种学习方法的定义与它们间的区别。

监督学习方法用来对数据实现分类,分类规则通过训练获得。

该训练集由带分类号的数据集组成,因此监督学习方法的训练过程是离线的。

非监督学习方法不需要单独的离线训练过程,也没有带分类号(标号)的训练数据集,一般用来对数据集进行分析,如聚类,确定其分布的主分量等。

就道路图像的分割而言,监督学习方法则先在训练用图像中获取道路象素与非道路象素集,进行分类器设计,然后用所设计的分类器对道路图像进行分割。

使用非监督学习方法,则依据道路路面象素与非道路象素之间的聚类分析进行聚类运算,以实现道路图像的分割。

3、已知一组数据的协方差矩阵为,试问

(1)协方差矩阵中各元素的含义。

(2)求该数组的两个主分量。

(3)主分量分析或称K-L变换,它的最佳准则是什么?

(4)为什么说经主分量分析后,消除了各分量之间的相关性。

答:

协方差矩阵为,则

(1)对角元素是各分量的方差,非对角元素是各分量之间的协方差。

(2)主分量,通过求协方差矩阵的特征值,用=0得,则

,相应地:

,对应特征向量为,,对应。

这两个特征向量,即为主分量。

(3)K-L变换的最佳准则为:

对一组数据进行按一组正交基分解,在只取相同数量分量的条件下,以均方误差计算截尾误差最小。

(4)在经主分量分解后,协方差矩阵成为对角矩阵,因而各主分量间相关性消除。

4、试说明以下问题求解是基于监督学习或是非监督学习:

(1)求数据集的主分量

(2)汉字识别

(3)自组织特征映射

(4)CT图像的分割

(1)求数据集的主分量是非监督学习方法;

(2)汉字识别:

对待识别字符加上相应类别号—有监督学习方法;

(3)自组织特征映射—将高维数组按保留近似度向低维映射—非监督学习;

(4)CT图像分割—按数据自然分布聚类—非监督学习方法;

5、试列举线性分类器中最著名的三种最佳准则以及它们各自的原理。

线性分类器三种最优准则:

Fisher准则:

根据两类样本一般类内密集,类间分离的特点,寻找线性分类器最佳的法线向量方向,使两类样本在该方向上的投影满足类内尽可能密集,类间尽可能分开。

这种度量通过类内离散矩阵Sw和类间离散矩阵Sb实现。

感知准则函数:

准则函数以使错分类样本到分界面距离之和最小为原则。

其优点是通过错分类样本提供的信息对分类器函数进行修正,这种准则是人工神经元网络多层感知器的基础。

支持向量机:

基本思想是在两类线性可分条件下,所设计的分类器界面使两类之间的间隔为最大,它的基本出发点是使期望泛化风险尽可能小。

6、试分析五种常用决策规则思想方法的异同。

答、五种常用决策是:

1.基于最小错误率的贝叶斯决策,利用概率论中的贝叶斯公式,得出使得错误率最小的分类规则。

2.基于最小风险的贝叶斯决策,引入了损失函数,得出使决策风险最小的分类。

当在0-1损失函数条件下,基于最小风险的贝叶斯决策变成基于最小错误率的贝叶斯决策。

3.在限定一类错误率条件下使另一类错误率最小的两类别决策。

4.最大最小决策:

类先验概率未知,考察先验概率变化对错误率的影响,找出使最小贝叶斯奉献最大的先验概率,以这种最坏情况设计分类器。

5.序贯分类方法,除了考虑分类造成的损失外,还考虑特征获取造成的代价,先用一部分特征分类,然后逐步加入性特征以减少分类损失,同时平衡总的损失,以求得最有效益。

7、1.什么是特征选择?

2.什么是Fisher线性判别?

1.特征选择就是从一组特征中挑选出一些最有效的特征以达到降低特征空间维数的目的。

2.Fisher线性判别:

可以考虑把d维空间的样本投影到一条直线上,形成一维空间,即把维数压缩到一维,这在数学上容易办到,然而,即使样本在d维空间里形成若干紧凑的互相分得开的集群,如果把它们投影到一条任意的直线上,也可能使得几类样本混在一起而变得无法识别。

但是在一般情况下,总可以找到某个方向,使得在这个方向的直线上,样本的投影能分开得最好。

问题是如何根据实际情况找到这条最好的、最易于分类的投影线,这就是Fisher算法所要解决的基本问题。

8、写出两类和多类情况下最小风险贝叶斯决策判别函数和决策面方程。

两类问题:

判别函数

决策面方程:

C类问题:

判别函数,

,,,

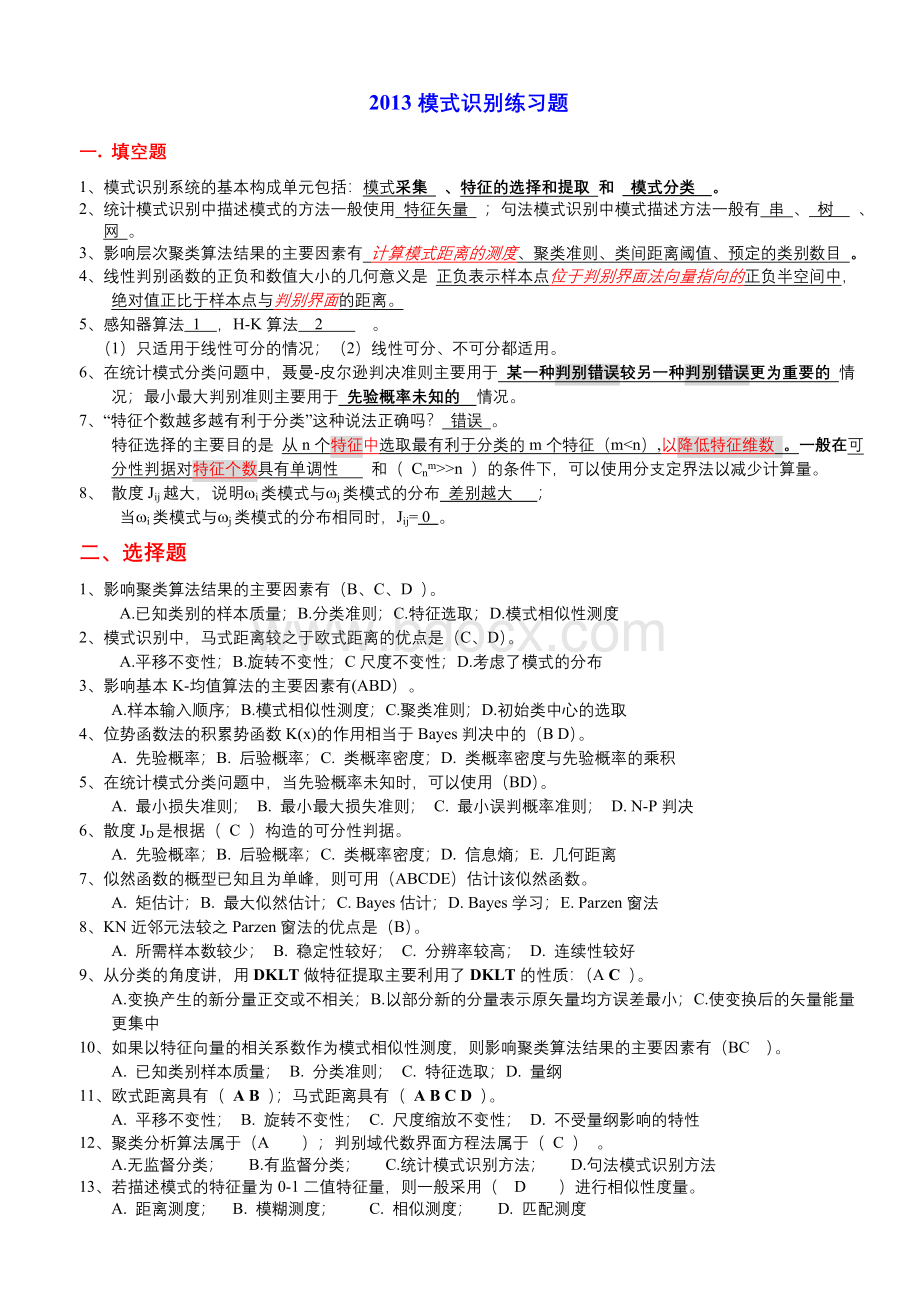

数据获取

预处理

特征提取与选择

分类决策

分类器设计

信号空间

特征空间

9、请论述模式识别系统的主要组成部分及其设计流程,并简述各组成部分中常用方法的主要思想。

信息获取:

通过测量、采样和量化,可以用矩阵或向量表示二维图像或波形。

预处理:

去除噪声,加强有用的信息,并对输入测量仪器或其他因素造成的退化现象进行复原。

特征选择和提取:

为了有效地实现分类识别,就要对原始数据进行变换,得到最能反映分类本质的特征。

分类决策:

在特征空间中用统计方法把识别对象归为某一类。

10、简述支持向量机的基本思想。

SVM从线性可分情况下的最优分类面发展而来。

最优分类面就是要求分类线不但能将两类正确分开(训练错误率为0),且使分类间隔最大。

SVM考虑寻找一个满足分类要求的超平面,并且使训练集中的点距离分类面尽可能的远,也就是寻找一个分类面使它两侧的空白区域(margin)最大。

过两类样本中离分类面最近的点,且平行于最优分类面的超平面上H1,H2的训练样本就叫支持向量。

四、计算题

1、设两类样本的类内散布矩阵分别为,两类的类心分别为m1=(2,0)T,m2=(2,2)T,试用fisher准则求其决策面方程。

解:

,

或写出决策面方程

2、已知两个一维模式类别的类概率密度函数为:

先验概率P(w1)=0.6,P(w2)=0.4,