完整版Hadoop安装教程伪分布式配置CentOS64Hadoop260.docx

《完整版Hadoop安装教程伪分布式配置CentOS64Hadoop260.docx》由会员分享,可在线阅读,更多相关《完整版Hadoop安装教程伪分布式配置CentOS64Hadoop260.docx(17页珍藏版)》请在冰豆网上搜索。

完整版Hadoop安装教程伪分布式配置CentOS64Hadoop260

Hadoop安装教程_伪分布式配置_CentOS6.4/Hadoop2.6.0

都能顺利在CentOS中安装并运行Hadoop。

环境

本教程使用CentOS6.432位作为系统环境,请自行安装系统(可参考使用VirtualBox安装CentOS)。

如果用的是Ubuntu系统,请查看相应的Ubuntu安装Hadoop教程。

本教程基于原生Hadoop2,在Hadoop2.6.0(stable)版本下验证通过,可适合任何Hadoop2.x.y版本,例如Hadoop2.7.1,Hadoop2.4.1等。

Hadoop版本

Hadoop有两个主要版本,Hadoop1.x.y和Hadoop2.x.y系列,比较老的教材上用的可能是0.20这样的版本。

Hadoop2.x版本在不断更新,本教程均可适用。

如果需安装0.20,1.2.1这样的版本,本教程也可以作为参考,主要差别在于配置项,配置请参考官网教程或其他教程。

新版是兼容旧版的,书上旧版本的代码应该能够正常运行(我自己没验证,欢迎验证反馈)。

装好了CentOS系统之后,在安装Hadoop前还需要做一些必备工作。

创建hadoop用户

如果你安装CentOS的时候不是用的“hadoop”用户,那么需要增加一个名为hadoop的用户。

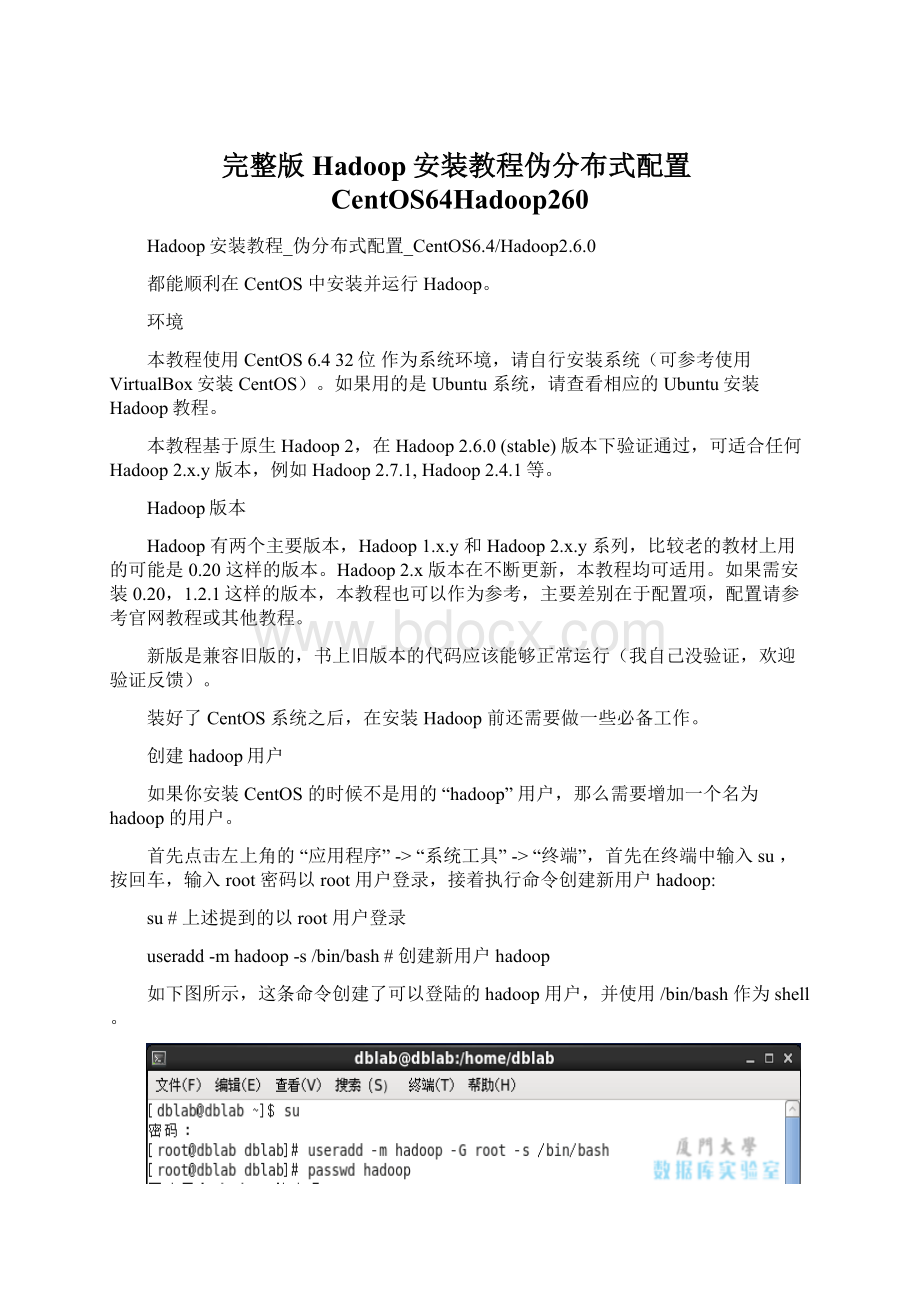

首先点击左上角的“应用程序”->“系统工具”->“终端”,首先在终端中输入su,按回车,输入root密码以root用户登录,接着执行命令创建新用户hadoop:

su#上述提到的以root用户登录

useradd-mhadoop-s/bin/bash#创建新用户hadoop

如下图所示,这条命令创建了可以登陆的hadoop用户,并使用/bin/bash作为shell。

CentOS创建hadoop用户

接着使用如下命令修改密码,按提示输入两次密码,可简单的设为“hadoop”(密码随意指定,若提示“无效的密码,过于简单”则再次输入确认就行):

passwdhadoop

可为hadoop用户增加管理员权限,方便部署,避免一些对新手来说比较棘手的权限问题,执行:

visudo

如下图,找到rootALL=(ALL)ALL这行(应该在第98行,可以先按一下键盘上的ESC键,然后输入:

98(按一下冒号,接着输入98,再按回车键),可以直接跳到第98行),然后在这行下面增加一行内容:

hadoopALL=(ALL)ALL(当中的间隔为tab),如下图所示:

为hadoop增加sudo权限

添加上一行内容后,先按一下键盘上的ESC键,然后输入:

wq(输入冒号还有wq,这是vi/vim编辑器的保存方法),再按回车键保存退出就可以了。

最后注销当前用户(点击屏幕右上角的用户名,选择退出->注销),在登陆界面使用刚创建的hadoop用户进行登陆。

(如果已经是hadoop用户,且在终端中使用su登录了root用户,那么需要执行exit退出root用户状态)

准备工作

使用hadoop用户登录后,还需要安装几个软件才能安装Hadoop。

CentOS使用yum来安装软件,需要联网环境,首先应检查一下是否连上了网络。

如下图所示,桌面右上角的网络图标若显示红叉,则表明还未联网,应点击选择可用网络。

检查是否联网

连接网络后,需要安装SSH和Java。

安装SSH、配置SSH无密码登陆

集群、单节点模式都需要用到SSH登陆(类似于远程登陆,你可以登录某台Linux主机,并且在上面运行命令),一般情况下,CentOS默认已安装了SSHclient、SSHserver,打开终端执行如下命令进行检验:

rpm-qa|grepssh

如果返回的结果如下图所示,包含了SSHclient跟SSHserver,则不需要再安装。

检查是否安装了SSH

若需要安装,则可以通过yum进行安装(安装过程中会让你输入[y/N],输入y即可):

sudoyuminstallopenssh-clients

sudoyuminstallopenssh-server

接着执行如下命令测试一下SSH是否可用:

sshlocalhost

此时会有如下提示(SSH首次登陆提示),输入yes。

然后按提示输入密码hadoop,这样就登陆到本机了。

测试SSH是否可用

但这样登陆是需要每次输入密码的,我们需要配置成SSH无密码登陆比较方便。

首先输入exit退出刚才的ssh,就回到了我们原先的终端窗口,然后利用ssh-keygen生成密钥,并将密钥加入到授权中:

exit#退出刚才的sshlocalhost

cd~/.ssh/#若没有该目录,请先执行一次sshlocalhost

ssh-keygen-trsa#会有提示,都按回车就可以

catid_rsa.pub>>authorized_keys#加入授权

chmod600./authorized_keys#修改文件权限

~的含义

在Linux系统中,~代表的是用户的主文件夹,即“/home/用户名”这个目录,如你的用户名为hadoop,则~就代表“/home/hadoop/”。

此外,命令中的#后面的文字是注释。

此时再用sshlocalhost命令,无需输入密码就可以直接登陆了,如下图所示。

SSH无密码登录

安装Java环境

Java环境可选择Oracle的JDK,或是OpenJDK,现在一般Linux系统默认安装的基本是OpenJDK,如CentOS6.4就默认安装了OpenJDK1.7。

按http:

//wiki.apache.org/hadoop/HadoopJavaVersions中说的,Hadoop在OpenJDK1.7下运行是没问题的。

需要注意的是,CentOS6.4中默认安装的只是JavaJRE,而不是JDK,为了开发方便,我们还是需要通过yum进行安装JDK,安装过程中会让输入[y/N],输入y即可:

sudoyuminstalljava-1.7.0-openjdkjava-1.7.0-openjdk-devel

通过上述命令安装OpenJDK,默认安装位置为/usr/lib/jvm/java-1.7.0-openjdk(该路径可以通过执行rpm-qljava-1.7.0-openjdk-devel|grep'/bin/javac'命令确定,执行后会输出一个路径,除去路径末尾的“/bin/javac”,剩下的就是正确的路径了)。

OpenJDK安装后就可以直接使用java、javac等命令了。

接着需要配置一下JAVA_HOME环境变量,为方便,我们在~/.bashrc中进行设置(扩展阅读:

设置Linux环境变量的方法和区别):

vim~/.bashrc

在文件最后面添加如下单独一行(指向JDK的安装位置),并保存:

exportJAVA_HOME=/usr/lib/jvm/java-1.7.0-openjdk

如下图所示:

设置JAVA_HOME环境变量

接着还需要让该环境变量生效,执行如下代码:

source~/.bashrc#使变量设置生效

设置好后我们来检验一下是否设置正确:

echo$JAVA_HOME#检验变量值

java-version

$JAVA_HOME/bin/java-version#与直接执行java-version一样

如果设置正确的话,$JAVA_HOME/bin/java-version会输出java的版本信息,且和java-version的输出结果一样,如下图所示:

成功设置JAVA_HOME环境变量

这样,Hadoop所需的Java运行环境就安装好了。

安装Hadoop2

Hadoop2可以通过或者下载,本教程选择的是2.6.0版本,下载时请下载hadoop-2.x.y.tar.gz这个格式的文件,这是编译好的,另一个包含src的则是Hadoop源代码,需要进行编译才可使用。

下载时强烈建议也下载hadoop-2.x.y.tar.gz.mds这个文件,该文件包含了检验值可用于检查hadoop-2.x.y.tar.gz的完整性,否则若文件发生了损坏或下载不完整,Hadoop将无法正常运行。

本文涉及的文件均通过浏览器下载,默认保存在“下载”目录中(若不是请自行更改tar命令的相应目录)。

另外,如果你用的不是2.6.0版本,则将所有命令中出现的2.6.0更改为你所使用的版本。

cat~/下载/hadoop-2.6.0.tar.gz.mds|grep'MD5'#列出md5检验值

#head-n6~/下载/hadoop-2.7.1.tar.gz.mds#2.7.1版本格式变了,可以用这种方式输出

md5sum~/下载/hadoop-2.6.0.tar.gz|tr"a-z""A-Z"#计算md5值,并转化为大写,方便比较

若文件不完整则这两个值一般差别很大,可以简单对比下前几个字符跟后几个字符是否相等即可,如下图所示,如果两个值不一样,请务必重新下载。

检验文件完整性

我们选择将Hadoop安装至/usr/local/中:

sudotar-zxf~/下载/hadoop-2.6.0.tar.gz-C/usr/local#解压到/usr/local中

cd/usr/local/

sudomv./hadoop-2.6.0/./hadoop#将文件夹名改为hadoop

sudochown-Rhadoop:

hadoop./hadoop#修改文件权限

Hadoop解压后即可使用。

输入如下命令来检查Hadoop是否可用,成功则会显示Hadoop版本信息:

cd/usr/local/hadoop

./bin/hadoopversion

相对路径与绝对路径

请务必注意命令中的相对路径与绝对路径,本文后续出现的./bin/...,./etc/...等包含./的路径,均为相对路径,以/usr/local/hadoop为当前目录。

例如在/usr/local/hadoop目录中执行./bin/hadoopversion等同于执行/usr/local/hadoop/bin/hadoopversion。

可以将相对路径改成绝对路径来执行,但如果你是在主文件夹~中执行./bin/hadoopversion,执行的会是/home/hadoop/bin/hadoopversion,就不是我们所想要的了。

Hadoop单机配置(非分布式)

Hadoop默认模式为非分布式模式,无需进行其他配置即可运行。

非分布式即单Java进程,方便进行调试。

现在我们可以执行例子来感受下Hadoop的运行。

Hadoop附带了丰富的例子(运行./bin/hadoopjar./share/hadoop/mapreduce/hadoop-mapreduce-examples-2.6.0.jar可以看到所有例子),包括wordcount、terasort、join、grep等。

在此我们选择运行grep例子,我们将input文件夹中的所有文件作为输入,筛选当中符合正则表达式dfs[a-z.]+的单词并统计出现的次数,最后输出结果到output文件夹中。

cd/usr/local/hadoop

mkdir./input

cp./etc/hadoop/*.xml./input#将配置文件作为输入文件

./bin/hadoopjar./share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jargrep./input./output'dfs[a-z.]+'

cat./output/*#查看运行结果

若运行出错,如出现如下图提示:

运行Hadoop实例时可能会报错

若出现提示“WARNutil.NativeCodeLoader:

Unabletoloadnative-hadooplibraryforyourplatform…usingbuiltin-javaclasseswhereapplicable”,该WARN提示可以忽略,不会影响Hadoop正常运行(可通过编译Hadoop源码解决,解决方法请自行搜索)。

若出现提示“INFOmetrics.MetricsUtil:

UnabletoobtainhostName.UnknowHostException”,这需要执行如下命令修改hosts文件,为你的主机名增加IP映射:

sudovim/etc/hosts

主机名在终端窗口标题里可以看到,或执行命令hostname查看,如下图所示,在最后面增加一行“127.0.0.1dblab”:

设置主机名的IP映射

保存文件后,重新运行hadoop实例,若执行成功的话会输出很多作业的相关信息,最后的输出信息如下图所示。

作业的结果会输出在指定的output文件夹中,通过命令cat./output/*查看结果,符合正则的单词dfsadmin出现了1次:

Hadoop例子输出结果

注意,Hadoop默认不会覆盖结果文件,因此再次运行上面实例会提示出错,需要先将./output删除。

rm-r./output

Hadoop伪分布式配置

Hadoop可以在单节点上以伪分布式的方式运行,Hadoop进程以分离的Java进程来运行,节点既作为NameNode也作为DataNode,同时,读取的是HDFS中的文件。

在设置Hadoop伪分布式配置前,我们还需要设置HADOOP环境变量,执行如下命令在~/.bashrc中设置:

gedit~/.bashrc

这次我们选择用gedit而不是vim来编辑。

gedit是文本编辑器,类似于Windows中的记事本,会比较方便。

保存后记得关掉整个gedit程序,否则会占用终端。

在文件最后面增加如下内容:

#HadoopEnvironmentVariables

exportHADOOP_HOME=/usr/local/hadoop

exportHADOOP_INSTALL=$HADOOP_HOME

exportHADOOP_MAPRED_HOME=$HADOOP_HOME

exportHADOOP_COMMON_HOME=$HADOOP_HOME

exportHADOOP_HDFS_HOME=$HADOOP_HOME

exportYARN_HOME=$HADOOP_HOME

exportHADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

exportPATH=$PATH:

$HADOOP_HOME/sbin:

$HADOOP_HOME/bin

保存后,不要忘记执行如下命令使配置生效:

source~/.bashrc

这些变量在启动Hadoop进程时需要用到,不设置的话可能会报错(这些变量也可以通过修改./etc/hadoop/hadoop-env.sh实现)。

Hadoop的配置文件位于/usr/local/hadoop/etc/hadoop/中,伪分布式需要修改2个配置文件core-site.xml和hdfs-site.xml。

Hadoop的配置文件是xml格式,每个配置以声明property的name和value的方式来实现。

修改配置文件core-site.xml(通过gedit编辑会比较方便:

gedit./etc/hadoop/core-site.xml),将当中的

修改为下面配置:

hadoop.tmp.dir

file:

/usr/local/hadoop/tmp

Abaseforothertemporarydirectories.

fs.defaultFS

hdfs:

//localhost:

9000

同样的,修改配置文件hdfs-site.xml:

dfs.replication

1

dfs.namenode.name.dir

file:

/usr/local/hadoop/tmp/dfs/name

dfs.datanode.data.dir

file:

/usr/local/hadoop/tmp/dfs/data

配置完成后,执行NameNode的格式化:

./bin/hdfsnamenode-format

成功的话,会看到“successfullyformatted”和“Exittingwithstatus0”的提示,若为“Exittingwithstatus1”则是出错。

执行NameNode格式化

接着开启NaneNode和DataNode守护进程:

./sbin/start-dfs.sh

若出现如下SSH的提示“Areyousureyouwanttocontinueconnecting”,输入yes即可。

首次启动Hadoop时的SSH提示

启动时可能会有WARN提示“WARNutil.NativeCodeLoader…”如前面提到的,这个提示不会影响正常使用。

启动完成后,可以通过命令jps来判断是否成功启动,若成功启动则会列出如下进程:

“NameNode”、”DataNode”和SecondaryNameNode(如果SecondaryNameNode没有启动,请运行sbin/stop-dfs.sh关闭进程,然后再次尝试启动尝试)。

如果没有NameNode或DataNode,那就是配置不成功,请仔细检查之前步骤,或通过查看启动日志排查原因。

通过jps查看启动的Hadoop进程

通过查看启动日志分析启动失败原因

有时Hadoop无法正确启动,如NameNode进程没有顺利启动,这时可以查看启动日志来排查原因,注意几点:

∙启动时会提示形如“dblab:

startingnamenode,loggingto/usr/local/hadoop/logs/hadoop-hadoop-namenode-dblab.out”,其中dblab对应你的主机名,但启动的日志信息是记录在/usr/local/hadoop/logs/hadoop-hadoop-namenode-dblab.log中,所以应该查看这个后缀为.log的文件;

∙每一次的启动日志都是追加在日志文件之后,所以得拉到最后面看,看下记录的时间就知道了。

∙一般出错的提示在最后面,也就是写着Fatal、Error或者JavaException的地方。

∙可以在网上搜索一下出错信息,看能否找到一些相关的解决方法。

成功启动后,可以访问Web界面http:

//localhost:

50070查看NameNode和Datanode信息,还可以在线查看HDFS中的文件。

Hadopp的Web界面

运行Hadoop伪分布式实例

上面的单机模式,grep例子读取的是本地数据,伪分布式读取的则是HDFS上的数据。

要使用HDFS,首先需要在HDFS中创建用户目录:

./bin/hdfsdfs-mkdir-p/user/hadoop

接着将./etc/hadoop中的xml文件作为输入文件复制到分布式文件系统中,即将/usr/local/hadoop/etc/hadoop复制到分布式文件系统中的/user/hadoop/input中。

我们使用的是hadoop用户,并且已创建相应的用户目录/user/hadoop,因此在命令中就可以使用相对路径如input,其对应的绝对路径就是/user/hadoop/input:

./bin/hdfsdfs-mkdirinput

./bin/hdfsdfs-put./etc/hadoop/*.xmlinput

复制完成后,可以通过如下命令查看HDFS中的文件列表:

./bin/hdfsdfs-lsinput

伪分布式运行MapReduce作业的方式跟单机模式相同,区别在于伪分布式读取的是HDFS中的文件(可以将单机步骤中创建的本地input文件夹,输出结果output文件夹都删掉来验证这一点)。

./bin/hadoopjar./share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jargrepinputoutput'dfs[a-z.]+'

查看运行结果的命令(查看的是位于HDFS中的输出结果):

./bin/hdfsdfs-catoutput/*

结果如下,注意到刚才我们已经更改了配置文件,所以运行结果不同。

Hadoop伪分布式运行grep的结果

我们也可以将运行结果取回到本地:

rm-r./output#先删除本地的output文件夹(如果存在)

./bin/hdfsdfs-getoutput./output#将HDFS上的output文件夹拷贝到本机

cat./output/*

Hadoop运行程序时,输出目录不能存在,否则会提示错误“org.apache.hadoop.mapred.FileAlreadyExistsException