1011第二学期信息论作业题参考答案.docx

《1011第二学期信息论作业题参考答案.docx》由会员分享,可在线阅读,更多相关《1011第二学期信息论作业题参考答案.docx(16页珍藏版)》请在冰豆网上搜索。

1011第二学期信息论作业题参考答案

第1讲

2、信息论创始人是谁?

香农。

3、信息和消息、信号有什么联系与区别?

从信息理论角度上看,信号是消息的载体,信息含藏在消息之中,有信号有消息不一定有信息。

4、通信系统的主要性能指标是什么?

有效性、可靠性和安全性。

5、举例说明信息论有哪些应用?

为信息传送和处理系统提供数学模型和评估方法,在通信和信息处理领域是一门基础理论,在其它领域如语言学、生物学、医学、神经网络、经济学方面的应用也很成功。

具体应用实例有:

语音、图像和数据信息的压缩,通信信道有效性和可靠性的提高,或信道传输功率指标要求的降低,通信或计算机系统可靠性和安全性的提高,信息处理领域的信号重建和模式识别等。

2.4(求车牌自信息量)

某车牌号的概率是(1/26)3×(1/10)3,24bit/牌,后一种概率为(1/36)6,31bit/牌,

第2讲

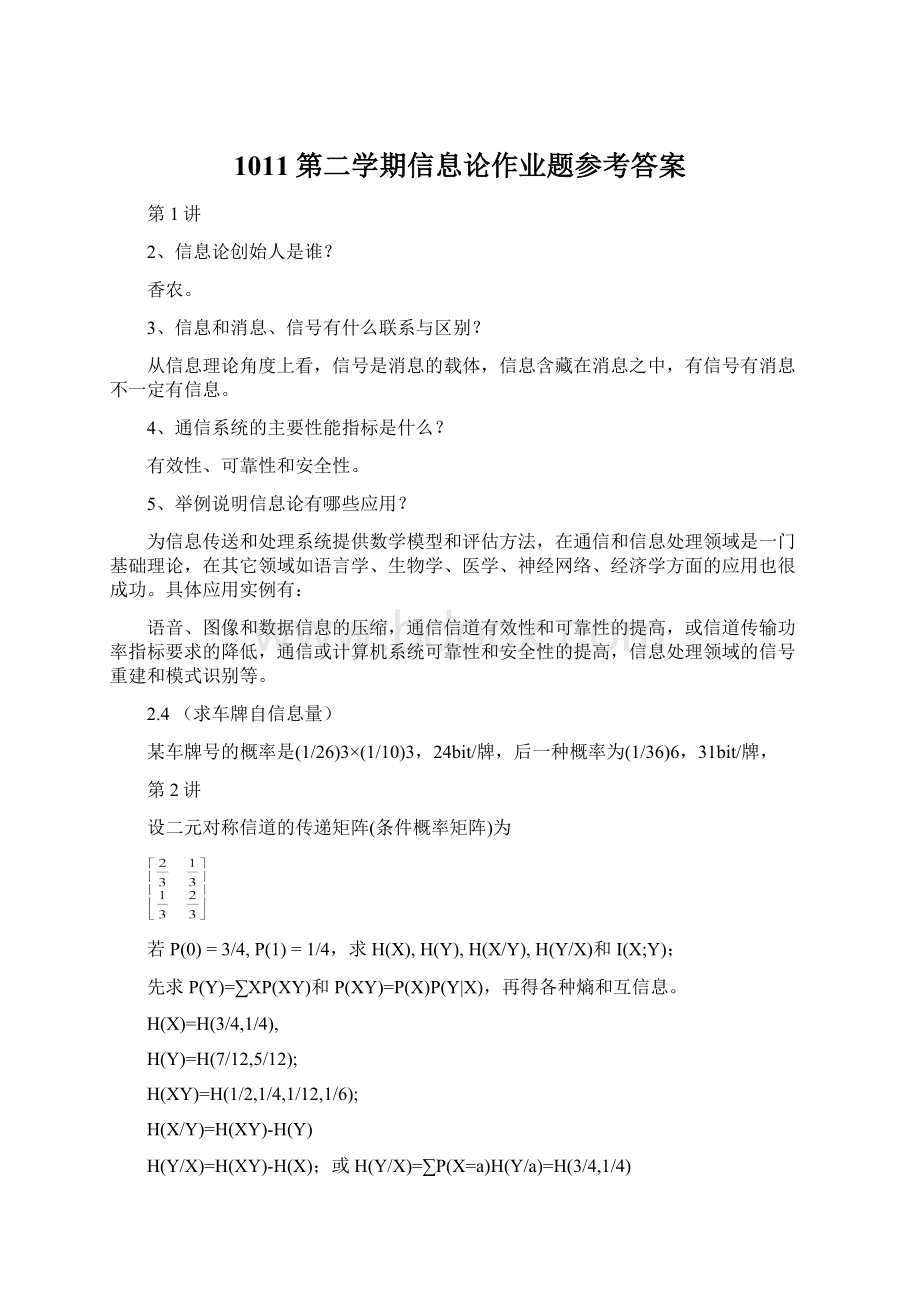

设二元对称信道的传递矩阵(条件概率矩阵)为

若P(0)=3/4,P

(1)=1/4,求H(X),H(Y),H(X/Y),H(Y/X)和I(X;Y);

先求P(Y)=∑XP(XY)和P(XY)=P(X)P(Y|X),再得各种熵和互信息。

H(X)=H(3/4,1/4),

H(Y)=H(7/12,5/12);

H(XY)=H(1/2,1/4,1/12,1/6);

H(X/Y)=H(XY)-H(Y)

H(Y/X)=H(XY)-H(X);或H(Y/X)=∑P(X=a)H(Y/a)=H(3/4,1/4)

I(X;Y)=H(X)-H(X/Y)=H(X)+H(Y)-H(XY);

2.2(求条件信息量)

1.6米以上女孩是条件,某个1.6米以上的女大学生是概率事件,得条件概率为:

P=0.25×0.75/0.5=0.375=3/8,信息量为I=-log0.375=1.42比特。

2.5

2.10

(1)

(2)(由联合概率分布求熵、联合熵和条件熵)

(1)思路:

先求出X、Y、Z、XZ、YZ、XYZ的概率或联合分布,再求其熵。

如:

P(Z=XY=0)=1-P(XY=1)=7/8,P(ZX=1)=P(YX=1)=1/8,..

(2)思路:

通过X、Y、Z及其联合概率分布求X/Y等条件概率分布P(X/Y)=P(XY)/P(Y),再求其熵H(X/Y)=∑P(Y=b)H(X/b)

。

或根据H(X/Y)=H(XY)-H(Y)从联合熵计算条件熵。

P(xyz)联合概率分布如下

Z\XY

00

01

10

11

0

1/8

3/8

3/8

0

1

0

0

0

1/8

P(xz)联合概率分布如下

Z\X

0

1

0

1/2

3/8

1

0

1/8

P(yz)联合概率分布如下

Z\Y

0

1

0

1/2

3/8

1

0

1/8

第3讲

2.10(3)(由联合概率分布求平均互信息和条件互信息)

通过H(X;Y)=H(X)-H(X|Y),H(X;Y|Z)=H(X|Z)-H(X|YZ)和H(X|Y)=H(XY)-H(Y)

关系式求各种互信息量

2.12,X表示天气情况,Y表示天气预报,0表雨,1表无雨。

求1)准确率(提示P(00)+P(11)=12/16),2)从预报得到的信息量I(X;Y)(X(0)=3/16,X

(1)=13/16,Y(0)=11/16,Y

(1)=5/16),3)总是报无雨时的准确率和预报信息量(提示,Y(0)=0,Y

(1)=1;准确度=13/16,I(X;Y)=0)。

2.14(由X概率分布和条件概率分布求互信息和条件互信息)

先求联合概率分布p(xy1y2)=p(x)p(y1y2|x),如p(y1y2|x)=p(00|0)=1,p(10|1)=1,p(11|2)=1/2,p(01|2)=1/2,余为0。

再通过以下公式求各个互信息和条件互信息:

不用H(X;Y)=H(X)-H(X|Y),H(X;Y|Z)=H(X|Z)-H(X|YZ)和H(X|Y)=H(XY)-H(Y)

使用H(X;Y|Z)=H(X;YZ)-H(X;Z)

P(xy1y2)联合概率分布如下

xy1y2

00

01

10

11

0

1/4

0

0

0

1

0

0

1/4

0

2

0

1/4

0

1/4

I(X;Y1)=0.5;I(X;Y2)=1;

I(X;Y1Y2)=H(X)+H(Y1Y2)-H(XY1Y2)=1.5+2-2=1.5

I(X;Y1|Y2)=I(X;Y1Y2)-I(X;Y2)=.0.5,I(X;Y2|Y1)=I(X;Y1Y2)-I(X;Y1)=.1

第4讲

1,某l离散无记忆信源只输出n个符号,则当信源呈(等概)分布情况下,熵为最大值(logn)。

2,某连续信源幅度受限,则当信源呈(均匀)分布情况下,熵为最大值(log(b-a))。

3,如果连续随机变量X的均值为零,平均功率受限于P,则当X服从(高斯)分布时、其微分熵达到最大,最大的微分熵为(log

)。

4,设连续随机变量X的概率密度函数服从均匀分布,求微分熵,并说明大于0的条件。

答案:

第5讲

随机信源如何分类?

从消息变量取值的连续性分:

离散信源和连续信源

从连续信源输出时间上的连续性分:

连续信源和波形信源

从离散信源的消息序列的长度来分:

单符号信源和序列(扩展)信源

从离散信源序列之间的有无相关性分:

无记忆信源(DMS)和有记忆信源

从离散有记忆信源序列的相关程度分:

平稳信源、M阶Markov信源、……

什么是平稳信源、什么是Markov链、齐次Markov链、平稳齐次Markov链、Markov信源?

离散平稳信源:

各维联合概率分布均与时间起点无关的完全平稳信源

Markov链:

马氏链是时间离散状态离散的随机过程,马氏链的当前状态只与前一个状态有关

齐次Markov链:

状态转移概率与时间点无关的Markov链

平稳齐次Markov链:

状态概率分布与时间点无关的Markov链

Markov信源:

1)信源状态由当前输出符号和前一时刻信源状态唯一确定。

2)某一时刻信源符号的输出只与当前的信源状态有关,与以前的状态无关。

M阶Markov信源:

某一时刻信源符号的输出只与此前的M个输出有关。

举例说明M阶马氏源的处理方法和状态数目

m阶马氏源是指其输出某一符号的概率只与此前的m个符号有关。

马氏源可用马氏链来描述。

若是一阶马尔可夫信源,一个符号对应一个状态,若是m阶马尔可夫信源,m个符号对应一个状态。

设马氏源符号种类N种,则M阶马氏源状态数为Nm。

3.3(DMS扩展及熵)

说明DMS扩展方法

如:

二元信源X的符号集为{0,1},求信源的二次扩展模型即是求q2=4个样本的各自的概率分布

熵值算式利用可加性H(XN)=N×1.5bit/符号

第6讲

3.11(提示求1阶马氏源2次扩展的熵,求概率分布)

先求P(X1X2),再求H(X1X2)/2,H(0.3,0.7)=0.88,H(0.63,0.07,0.06,0.24)/2=0.714,

3.13(提示平稳马氏源的熵,先求状态平稳分布)

先求状态矢量Л=Л·P及∑Л=1,得Л=[15/43,12/43,16/43],

H(Л)=1.575,h=[1.585,1.5,1.5],H(XN)=1.575+(N-1)1.53=1.53N+0.045

3.16(提示求1阶马氏源3次扩展的熵,求概率分布,求极限利用遍历链定理3.26)

答:

由矩阵P(X2)=P(X1)·P(X2/X1),得各步状态分布,再根据下式求熵

H(X1X2X3)=H(X1)+H(X2/X1)+H(X3/X1X2)=H(X1)+H(X2/X1)+H(X3/X2)=1.5+1.21+1.26=3.97bit;H(X2/X1)=P(X1)·h=[1/2,1/4,1/4][1.5,0.92,0.92]T=1.21,

H(X3/X2)=P(X2)·h=[7/12,5/24,5/24][1.5,0.92,0.92]T=1.26。

H3(X1X2X3)=1.32bit/符号

求状态矢量Л=Л·P及∑Л=1,得Л=[4/7,3/14,3/14]

H∞(X)=Лh=[4/7,3/14,3/14][1.5,0.92,0.92]T=1.25bit/符号

第7讲

5.1差错率高(DF非唯一可译码)

A、C、E为即时码,A/B/C/E是唯一可译码,根据克拉夫特不等式D/F非唯一可译码。

A码的平均码长为3bit/符号,B、C码的平均码长17/8,E的平均码长为2bit/符号(而F的平均码长为2bit/符号,D的平均码长为31/16bit/符号,都无意义)

5.2(提示:

列出可编码的N长信源序列样本及其概率)差错率高(组合码数量计算方法和码长)

求组合数量:

多个信源“正码”加1个“误码”,

得码长log(1+C3+C2+C1+C0=1+161700+4950+100+1=166752)=17.35,

取码长18。

Pr=0.99597×0.0053×C3+0.99598×0.0052×C2+0.99599×0.0051×C1+0.995100×C0=0.01243+0.07572+0.30441+0.60577=0.99833,

Pe=1-Pr=1.67×10-3

5.4

第8讲

5.7差错率高(码率单位,或方差大)

a0、a1、a2、a3、a4、a5、a6和a7分别编3、3、3、3、3和2、4、4位,编码平均码长L=2.7码元/符号,码长方差

=0.41,信源熵H(X)=2.62,编码效率97.0%,(编码码率R’=Llogr=2.7bit/信源符号,信息传输速率R=H(X)/L=0.97bit/码符号)

最佳码:

异前缀,且平均码长和码长方差最小。

5.9

信源熵H(S)=2.61bit/符号,剩余度

0.07

二进制编码2,2,3,3,3,4,4位,平均码长

=2.72位,编码效率

=0.96

三进制编码1,2,2,2,2,2,2位,平均码长

=1.8位,编码效率

=0.915

利用自信息方差

计算得1.93×104

第9讲

有二元二阶平稳马氏源,已知:

p(0/00)=0.8,p(0/01)=0.5,p(0/10)=0.5,p(0/11)=0.2,p(1/11)=0.8,p(1/01)=0.5,p(1/10)=0.5,p(1/00)=0.2。

用三个符号合成一个消息来构成一个信源,对该信源进行哈夫曼编码并求其平均码长

(提示:

先求平稳分布:

[л][P]=[л],再求p(000)=p(00)×p(0/00)和进行编码)。

,000~111概率分别为2/7、1/14、1/14、1/14、1/14、1/14、1/14和2/7位,分别编2、3、3、4、4、4、4和2位,平均码长等于19/7=2.7

6、某一页传真文件的一行像素分布如下:

85白-7黑-33白-728黑-875白。

试确定该行的MH码和压缩比。

85白=64+21→110110010111(12位),7黑→00011(5位)

33白→00010010(8位),728黑=704+24→000000100101100000010111(24位)

875白=832+43→01101001000101100(17),EOL→000000000001(12位)

MH码长12+5+8+24+17+12=78位;压缩比1728:

78=22:

1。

第10讲

5.14

P1101110011=77/810=0.000767,码长-log20.000767=10.35,取11位。

累积概率P1'=0,P0'=7/8,P110'=P11'+P0'P11=343/512=0.66992

P110111'=P110',P1101110'=P110'+P0'P110111=0.66992+117649/2097152=0.7260194

P11011100'=P1101110'+P0'P1101110=0.7260194+117649/16777216=0.7330318

P1101110011'=P11011100'=0.7330318,0.7330318×211=1501.2=5DDH

得11位码10111011101。

编码效率:

=-log2P1101110011/11log22=10.35/11=94%,

注:

5.15

LZ字典:

b,c,ca,cb,cc,ccc,cccc,ccca,

LZ编为:

(0,b)(0,c)(2,a)(2,b)(2,c)(5,c)(6,c)(6,a)(6,a)。

LZW字典:

a,b,c,bc,cc,ca,ac,cb,bcc,ccc,cccc,ccccc,cca,acc。

LZW编为:

2,3,3,1,3,4,5,10,11,5,7,5,1。

第11讲

6.1

Py=[1/3,2/3]·P=[5/12,7/12]=0.98,H(Y|X)=[1/3,2/3]·h=H[3/4,1/4]=0.81

I(x=0;y=1)=log[p(y=1/x=0)/p(y=1)]=log(1/4)/(7/12)=log3/7=-1.22

I(x=1;Y)=p(0/1)I(x=1;y=0)+p(1/1)I(x=1;y=1)=1/4log3/5+3/4log9/7=0.088

I(X;Y)=H(Y)-H(Y|X)=H[5/12,7/12]-H[3/4,1/4]=0.17

I(X;Y)=H(3/4p0+1/4p1,1/4p0+3/4p1)-(p0+p1)H[3/4,1/4],所以

C=H(3/4p0+1/4p1,1/4p0+3/4p1)MAX-H[3/4,1/4]=1-H[3/4,1/4]=0.19

取p1=p0=0.5

6.2

是准对称信道,H(Y)=H(1/3,1/3,1/3)=log3,C=I(X;Y)=H(Y)-H(Y|X)=2/3

6.13

,非对称或准对称矩阵,它是可逆矩阵。

得:

,

,C=log3/2,

输出概率Py=(1/6,2/3,1/6),输入概率Px=PyP-1=(2/9,5/9,2/9)

第12讲

1,分别说明什么是“级联信道”和“输入并联信道”,它们的容量会增加还是减小,极限值会是多少?

“级联信道”容量减小最低到0,“输入并联信道”容量增加最高到H(X)。

2,6.7

和信道,

,信道容量和输入概率分布如下:

C=log(20+2(log2+

))=log(1+

)

p1=1/(1+

),P2=P3=

/(1+

)

3,计算以下两个信道矩阵代表的信道的容量和概率分布:

解:

1、和信道信道,C1=log3,C2=0,C=log(3+20)=2,

输入概率分布1/4,1/4,1/4,1/8,1/8

输出分布1/8,1/8,1/4,1/12,1/12,1/12,1/8,1/8

2、C是无损信道,C=log3

输入概率分布1/3,1/3,1/3

输出分布1/30,1/15,1/10,2/15,1/10,7/30,2/15,1/15,1/30,1/10

第13讲

3,离散信道时间和幅值(离散),也称(数字)信道。

波形信道时间和幅值(连续),也称(模拟)信道。

时间(离散)而幅值(连续)称为(连续)信道

4,8.11

C=Blog(1+PS/BN0),B=3.1kHz,S/N=1000,C=30.9kbit/S

C=Blog(1+PS/BN0),C=1.44×S/N0=1.44Mbit/S

C=Blog(1+PS/BN0)=36Mbit/Slog(1+500/36)=140.3Mbit/S

5,8.12

C=Blog(1+PS/BN0),C=1.44×S/N0=144Mbit/S

C=Blog(1+PS/BN0),B=3kHz,S/N=108/3K=33333,C=45kbit/S,

R/B=24kbit/3kHz=8bit/Hz,

由C/B=8=log(1+S/N),S/N=255=24dB,S/N0=31.875/Hz

C=100Klog(1+PS/BN0)=45kbit/S,得S/N=0.37=-4.3dB(信号功率为S=0.37×10-8×100k=0.37mW),下降24-(-4.3)=28.3dB。

6,8.13

C=Blog(1+PS/BN0)=3kHzlog(1+100)=19.9kbit/S

19.9kbit/S=Blog(1+3.16)=B×2.06,B=9.66kHz

8.14

B=P1+10-8×3×106+P2+0.5×10-6×2×106/5×106=(10+1.03)/5×106=2.206×10-6

C=3×106×log2.206×10-6/10-8+2×106×log2.206×10-6/50×10-8=27.639Mbit/s

第14讲

7.2

(1)、log4/10ms=200bit/s

(2)、H(0.2,0.25,0.25,0.3)/10ms=198.6bit/s

7.4

(1)比较

,建PX|Y

(2)同上

7.5

同上题方法

7.6

(1)(4)

(2)对称信道C公式C=logm-H(X|y)

对称信道C=log5-H(1/2,1/2)=1.32bit

(3)利用信道编码定理

因为1/2×log5=1.16bit5、什么是最佳译码准则?

什么是最大后验概率准则、最大联合概率准则与最大似然准则?

它们是否都是最佳译码准则?

最大后验概率准则与最大似然准则有何不同?

答:

最佳译码准则:

平均错误概率最小的译码。

收到yj(j=1,2,…m)后,取i(i=1,2,…n)的后验概率取最大的p(x*/yj)≥p(xi/yj)(对一切的i)的那个发送样本x*作为yj的译码结果,这种译码准则称为“最大后验概率准则”。

收到yj(j=1,2,…m)后,取i(i=1,2,…n)的联合概率取最大的p(x*,yj)≥p(xi,yj)(对一切的i)的那个发送样本x*作为yj的译码结果,这种译码准则称为“最大联合概率准则”。

由于p(x*/yj)p(yj)=p(x*,yj),“最大后验概率准则”等价于“最大联合概率准则”。

它们都是最佳译码准则。

取p(yj/x*)是n个信道转移概率p(yj/x1),p(yj/x2),……,p(yj/xn)中的最大者的那个发送样本x*作为yj的译码结果,这种译码方法称为“最大似然译码准则”。

它不是最佳译码准则,但在输入信源等概分布时就是最佳译码准则,这时与“最大后验概率准则”及“最大联合概率准则”等价。

6、有一个二元对称信道,设该信道以1000二元符号/秒的速率传送消息,错误率为p=0.01。

现有一条0、1独立等概、长度为5000二元符号消息序列通过信道传输;问信道能否在10秒内将消息序列无差错传输?

解:

信道容量C=log2-H(p,1-p)=1-H(0.01)=0.92;信道最大速率920bit/s;

信源速率R=H(1/2)×5000/10=500bit/s<920bit/s;能实现无差错传输。

第15讲

1、什么是(7,3)线性分组码,什么是它的校验矩阵,求生成矩阵

(7,3)线性分组码:

信息位3位,监督位4位,监督位通过信息位的线性代数运算产生。

由生成多项式得校验矩阵H。

2、什么是循环码和CRC码?

循环码首先是一种线性分组码(n,k),即任意两个字模2加仍为许用码组。

在循环码中,所有的码多项式c(x)都能够被g(x)整除。

若c(x)是长度为n的循环码中的一个码多项式,则xc(x)按照模xn+1运算的余式必为左移1位的另一循环码多项式。

CRC在(n,k,dmin)循环码的基础上,对前面i位连续为0的信码去掉这些0,得缩短码(n-i,k-i,dmin),其校验长度n-k不变,编译码算法不变,适应了工程中码长可变,纠错能力不变的要求。

3、什么是汉明距离?

它与分组码的检错纠错能力有何关系?

什么是最小汉明距离准则?

它与最大似然准则有何关系?

两个等长码字之间,如果有d个相对应的码元不同,则称d为这两个码字的汉明距离。

分组码能够检测出td≤dmin-1个错误;只用于纠错,能纠正tc≤(dmin-1)/2个错误;用于既纠tc个错,又检td个错:

tc+td≤dmin-1,且须满足:

tc≤(dmin-1)/2。

最小汉明距离准则译码,即计算所有可能的发送x与接收y之间的汉明距离,取最小汉明距离的x作为y的译码输出。

对于二元对称信道(设差错率P≤1/2),采用最大似然译码准则译码,由于输入n个码,输出d个错码的转移概率为(1-P)n-dPd,看出错码数目小的输出概率大。

所以,最大似然准则等价于最小汉明距离准则

第16讲

1、试分别说明分组码(n,k)和卷积码(n,k,m)中各符号的含义?

分组码(n,k):

示当前输入k个信息,当前输出n个信息,其中n-k个监督位。

卷积码表示法(n,k,m):

表示当前输入k个信息,当前输出n个信息,n不仅与当前时刻的k个输入有关,还与此前连续m个时刻的输入信息有关。

如(2,1,2):

输入1位,输出2位,输出与此前2个时刻有关。

2、写出Viterbi译码的步骤?

Viterbi译码有何应用?

Viterbi译码的步骤:

1)在网格图上标出接收序列与编码器输出的汉明距离。

2)存在多条起始某个状态又终止于某个相同状态的路径,计算每一条路径的总的汉明距离。

3)选择一条总距离最短的路径为发送序列。

Viterbi译码应用:

它是一种最佳译码的算法,多用于卷积码译码;它是一种跟踪离散马可夫过程的算法,适用于干扰信道上作最佳解调。

3、某(2,1,2)卷积码编码器的网格图如下(00→

(1)→01→

(1)→11→(0)→10→

(1)→01是状态转移例),接收序列为V=(11,01,01,01,10,11,00),试判定发送序列。

解:

红线为接收输出序列(1,1,0,1,0,0,0),该路径(发送序列应为11,01,01,00,10,11,00)除第四段汉明距离为“1”外,各段距离为零,总汉明距离为“1”,其余路径距离均大于2。

第17讲

1、什么是BCH码和RS码,它们与循环码有何异同

BCH码和RS码是特殊的循环码,它们的生成多项式和纠错能力特别。

RS码特别适宜纠突发性错码

2、什么是TCM编码器?

它有何优点?

TCM译码器的原理是什么?

TCM编码器是将编码和调制作为一个整体的最佳设计(可使发送的信号序列之间的几何(欧氏)距离与汉明距离达到最佳匹配)。

TCM译码器的原理是,在网格图上标出可能路径上接收序列各符号(接收CY)与编码器输出(接收CX)的欧几里德距离Δ=d(CY,Cx),然后选择一条总距离最短的路径为发送序列。

第18讲

9.3(暂不计算R(D),但要列出DMIN和DMAX对应的试验信道)

选择题

以下哪些编码是保熵的?

1)无失真信源编码

2)限失真编码

答:

无失真信源编码

以下哪些编码是降低误码率的?

1)有燥信道编码

2)限失真编码

答:

有燥信道编码

给定信源和失真度d,平均失真度D大时R(D)将会?

1)变大

2)变小

答:

变小

第19讲

9.4(提示:

利用费诺不等式)某二元信源

其失真矩阵为

求这信源的Dmax和Dmin和