《信息论、编码与密码学》课后习题答案.doc

《《信息论、编码与密码学》课后习题答案.doc》由会员分享,可在线阅读,更多相关《《信息论、编码与密码学》课后习题答案.doc(48页珍藏版)》请在冰豆网上搜索。

《信息论、编码与密码学》课后习题答案

第1章信源编码

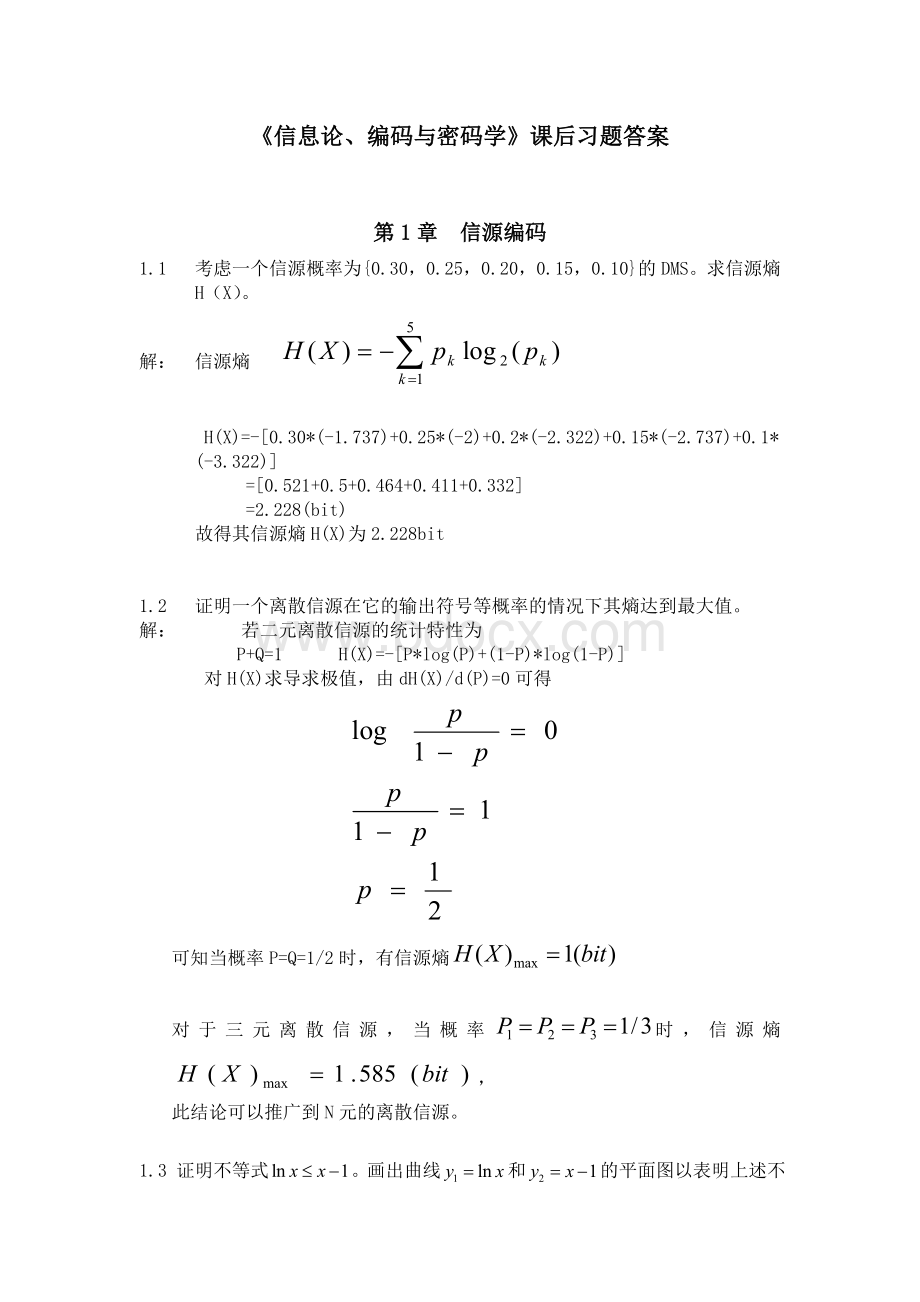

1.1考虑一个信源概率为{0.30,0.25,0.20,0.15,0.10}的DMS。

求信源熵H(X)。

解:

信源熵

H(X)=-[0.30*(-1.737)+0.25*(-2)+0.2*(-2.322)+0.15*(-2.737)+0.1*(-3.322)]

=[0.521+0.5+0.464+0.411+0.332]

=2.228(bit)

故得其信源熵H(X)为2.228bit

1.2证明一个离散信源在它的输出符号等概率的情况下其熵达到最大值。

解:

若二元离散信源的统计特性为

P+Q=1H(X)=-[P*log(P)+(1-P)*log(1-P)]

对H(X)求导求极值,由dH(X)/d(P)=0可得

可知当概率P=Q=1/2时,有信源熵

对于三元离散信源,当概率时,信源熵,

此结论可以推广到N元的离散信源。

1.3证明不等式。

画出曲线和的平面图以表明上述不等式的正确性。

证明:

Y=lnx

Y=x-1

y

x

1

绘制图形说明如下

可以很明确说明上述

不等式的正确性。

1.4证明

1.5有一个信源X,它有无穷多个可能的输出,它们出现的概率为P(Xi)=2i-1,i=1,2,3,….,这个信源的平均自信息H(X)是什么?

解:

因为P(Xi)=2i-1,i=1,2,3,…

所以H(X)=-

=-log2(2+2.22+3.23+…..+n.2n)

=2-(1-n)2n+1

1.6考虑另一个几何分布的随机变量X,满足P(Xi)=P(1-P)i-1i=1,2,3,…..,这个信源的平均自信息H(X)是什么?

解:

因为P(Xi)=P(1-P)i-1,i=1,2,3,

所以H(X)=-

=-logp(1-p)[p(1-p)+2p(1-p)2+3p(1-p)3+…….+np(1-p)n]

=(1-n)(1-p)n+1-

1.7考虑一个只取整数值的随机变量,满足,其中,。

求熵。

解:

为了方便计算,设,则,;

根据公式计算自信息量为:

;

则熵为:

=?

1.8计算概率分布函数为

的均匀分布随机变量的微分熵。

画出相对于参数的平面图,并对结果进行评论。

解:

根据公式(1-21)可知,微分熵为:

当时,,则

当或时,,则

根据得到的结果可以画出相应的平面图,由图可以看到随着的增加,即的减小,微分熵相应的增加。

0

0.1

10

1.9考虑一个信源的概率为的DMS。

(1)给出此信源的霍夫曼码。

(2)计算出这些码子的平均码长。

(3)这个码的效率是多少?

解:

1)依题意,由霍夫曼编码的规则,得:

1.00

0.65

0.40

0.20

0.35

0.25

0.20

0.15

0.05

表格如下:

符号

概率

自信息

码字

0.35

1.515

1

0.25

2.000

01

0.20

2.322

000

0.15

2.738

0010

0.05

4.322

0011

2)由平均码长公式,代入数据,得:

3)首先,该信源的熵为:

该码的效率为:

1.10考虑一个信源概率为{0.35,0.20,0.15,0.15,0.10,0.10,0.05,0.05}的DMS。

(1)给出此信源的一种有效定长码。

(2)给出此信源的霍夫曼码。

(3)比较这两种码并给出评论。

解:

1)空

2)依题意,由霍夫曼编码的规则,得:

符号

概率

自信息

码字

0.20

2.322

01

0.20

2.322

000

0.15

2.738

001

0.15

2.738

100

0.10

1.000

101

0.10

1.000

110

0.05

4.322

1110

0.05

4.322

1111

3)空

1.11一个DMS只有三个输出符号,它们的概率为{0.5,0.4,0.1}。

(1)给出此信源的霍夫曼码并确定编码效率。

(2)每次考虑两个符号时,给出此信源的霍夫曼码并确定编码效率。

(3)每次考虑三个符号时,给出此信源的霍夫曼码并确定编码效率。

解:

(1)本题的霍夫曼编码如下图所示:

0.5

0.4

0.1

0

1

0.5

1

0

1.0

图1.11霍夫曼编码

则霍夫曼码如下表:

符号

概率

码字

x1

0.5

1

x2

0.4

00

x3

0.1

01

该信源的熵为:

平均每个符号的比特数为:

该码的效率为:

(2)把符号每两个分一组,重新应用霍夫曼编码算法,如下表所示:

符号对

概率

码字

x1x1

0.25

00

x1x2

0.20

010

x2x1

0.20

011

x2x2

0.16

1010

x1x3

0.05

100

x3x1

0.05

110

x2x3

0.04

1011

x3x2

0.04

1110

x3x3

0.01

1111

该信源的熵为:

每个组的平均比特数为:

故该码的效率为:

(3)依题意,把符合每三个分成一组,再重新应用霍夫曼编码算法,得:

编码表格如下:

符号对

概率

自信息

码字

0.1250

2.7090

100

0.1000

3.3223

0000

0.1000

3.3223

0001

0.1000

3.3223

110

0.0800

3.6443

011

0.0800

3.6443

0100

0.0800

3.6443

0101

0.0640

3.9662

0011

0.0250

5.3223

10110

0.0250

5.3223

10111

0.0250

5.3223

11100

0.0200

5.6444

11101

0.0200

5.6444

11110

0.0200

5.6444

11111

0.0200

5.6444

001000

0.0200

5.6444

001001

0.0200

5.6444

001010

0.0160

5.9664

001011

0.0160

5.9664

101000

0.0160

5.9664

101001

0.0050

7.6646

1010101

0.0050

7.6646

10101000

0.0050

7.6646

10101001

0.0040

7.9666

10101100

0.0040

7.9666

10101101

0.0040

7.9666

10101110

0.0010

9.9668

10101111

1.14确定下列比特流的Lempel-Ziv码:

01001111100101000001010101100110000从码字流恢复原来的序列。

解:

根据Lempel-Ziv算法列出下表:

字典位置

字典内容

定长码字

0001

0

00000

0010

1

00001

0011

00

00010

0100

11

00101

0101

111

01001

0110

001

00111

0111

01

00011

1000

000

00110

1001

0010

01100

1010

10

00100

1011

101

10101

1101

100

10100

1110

110

01000

1111

000

10000

第2章信道容量和编码

2.1考虑图2-10所示的二元信道,设发送二元符号的先验概率为P0和P1,其中P0+P1=1,求后验概率和。

0

1

P0

0

P1

1

1-q

p

q

1-p

解:

2.5

(1)一个电话信道具有带宽3000Hz,且SNR=20dB.求信道容量。

(2)若SNR增加到25dB,求信道容量。

解:

(1)

SNR=20dB=100

信道容量=Wlog2(1+SNR/W)(b/s)

=3000*log2(1+100/3000)

=142(b/s)

(2)SNR=25dB=316

信道容量=Wlog2(1+SNR/W)(b/s)

=3000*log2(1+316/3000)

=413(b/s)

2.7假定一个电视每秒钟显示30个画面,每个画面大约有个像素,每个像素需要16比特的彩色显示。

假定SNR为25dB,计算支持电视信号传输所需要的带宽(利用信息容量定理)

解:

根据题意,该电视信号所需的信息容量为:

根据信息容量定理:

,其中为信噪比,据题意

据上式解得带宽

2.8考虑图2-15所示的Z型信道。

(1)求获得信道容量所需要的输入概率。

(2)若将N个这样的信道相级联,证明联合信道可以用一个信道转移概率为的等价Z信道表示。

(3)当时联合信道的容量是什么?

图2-15

解:

(1)w为带宽

信道容量(b/s)

(2)由图可知信道转移概率为P

那么N级级联的信道转移概率

(3)当时

级联信道的信道容量为每一次使用该信道时的最大平均互信息。

其中最大值是在所有可能的输入概率上求得的即:

2.10

(1)证明对有限方差,高斯随机变量具有所有随机变量可能获得的最大微分熵。

(2)证明该熵由公式给出。

证明:

(1)由题意可知,高斯随机变量获得的微分熵为:

则有:

即其平均功率为:

对于有限方差的高斯随机变量,即当平均功率受限时,有:

即有:

综上可得,对于平均功率受限的连续随机变量,当服从高斯分布时具有最大微分熵。

(2)随机变量的微分熵为:

(1)

对于高斯分布,我们有:

(2)

其中,m为数学期望。

将

(2)式代入

(1)可得:

(3)

由(3)式可以推出:

(4)

故(4)式